概要: CBM Media Pte Ltdが運営するAI画像生成プラットフォーム「OpenDream」は、公開ギャラリーと有料のNSFWツールを通じて、ユーザーがAI生成のCSAM(性的マイノリティ)や合意のない性的ディープフェイクを作成し、収益化することを可能にしていたと報じられています。このコンテンツは数ヶ月間、公開され、検索エンジンにもインデックスされていましたが、2024年半ばに限定的なモデレーションが実施され、GoogleとBingによる削除と広告および決済サービスの停止につながりました。

Editor Notes: Reported timeline of events: (1) Deepfakes and materials attributed to the OpenDream platform reportedly began appearing in December 2023. (2) Bellingcat published its investigation on 10/14/2024. (3) The incident ID was created 01/10/2026.

Alleged: CBM Media Pte Ltd developed an AI system deployed by OpenDream users と OpenDream, which harmed Victims of non-consensual deepfakes , minors , General public と Children.

関与が疑われるAIシステム: OpenDream platform

インシデントのステータス

インシデントID

1335

レポート数

1

インシデント発生日

2023-12-01

エディタ

Daniel Atherton

インシデントレポート

レポートタイムライン

Loading...

警告:この記事には児童性的虐待画像(CSAM)に関する記述が含まれています。

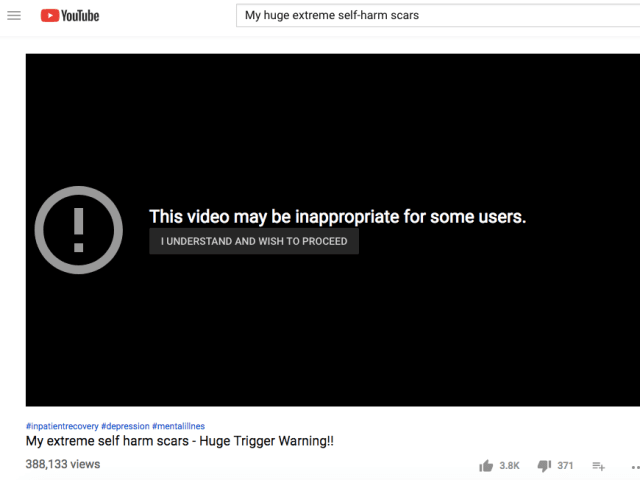

一見すると、OpenDreamは近年急増している数多くの一般的なAI画像生成サイトの一つに過ぎません。ユーザーは、思い描くイメージを短い説明文で入力するだけで画像を作成できます。

このプラットフォームは、ウェブサイトやソーシャルメディア上で自らを「AIアートジェネレーター」と称し、「無限の創造的可能性の世界を解き放つ」ようユーザーに呼びかけています。

しかし、数ヶ月にわたり、人々はOpenDream…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを��含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents