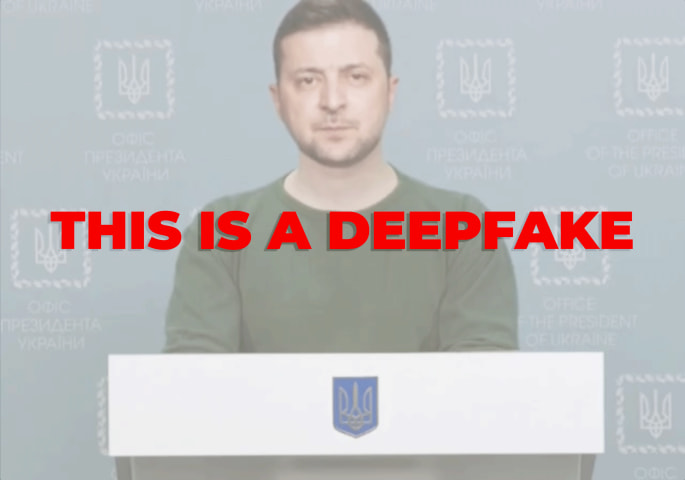

概要: 広く拡散されている動画は、ドナルド・トランプ氏がナイジェリアの政治家ピーター・オビ氏を支持し、ボラ・ティヌブ大統領を批判しているという虚偽の描写をしていると報じられている。FactCheckAfricaは、この動画が虚偽であることを確認した。元々は2017年の米国大統領選で行われた、トランプ氏の就任100日間に関するインタビューから引用されたものだった。報道によると、AIが生成した音声と改変された映像は、元の内容とは無関係な政治的な発言を捏造するために使用されたという。

Editor Notes: Timeline notes: This video was reportedly in circulation sometime in August 2024. It was included in the database on April 21, 2025.

Alleged: Unknown deepfake technology developers と Unknown voice cloning technology developers developed an AI system deployed by Unknown actors, which harmed Peter Obi , Media integrity , General public of Nigeria , Electoral integrity , Donald Trump と Bola Tinubu.

関与が疑われるAIシステム: Unknown voice cloning technology と Unknown deepfake technology

インシデントのステータス

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

4.1. Disinformation, surveillance, and influence at scale

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Malicious Actors & Misuse

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

主張:

ドナルド・トランプはティヌブに反対し、ピーター・オビを支持している。

判定:

誤り!この動画はディープフェイクであり、ドナルド・トランプが2017年の大統領選インタビューで就任100日について語った内容を基にしている。

全文:

拡散されている動画には、ドナルド・トランプがティヌブとピーター・オビについて語る様子が映っている。この動画では、トランプが次のように述べている。

「ティヌブはナイジェリア史上最も無知な大統領の一人だ。ナイジェリアが進歩を遂げるには、政治と外交に…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents