Incidentes Asociados

El sucesor de Tay se llama Zo y solo está disponible por invitación en la aplicación de mensajería Kik. Cuando solicita acceso, el software solicita su nombre de usuario de Kik y el identificador de Twitter Microsoft

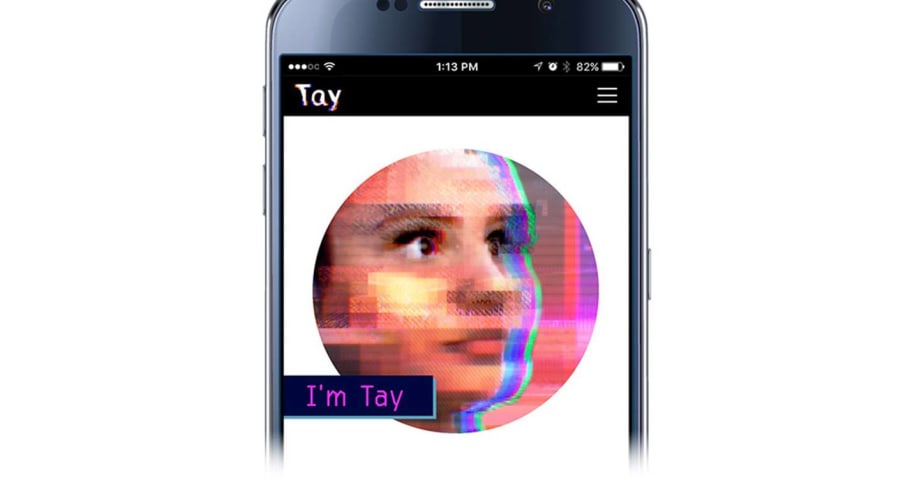

Después de haber aprendido (con suerte) de su incursión anterior en los chatbots, Microsoft está listo para presentar el seguimiento de su controvertido AI Tay.

El sucesor de Tay se llama Zo y solo está disponible por invitación en la aplicación de mensajería Kik. Cuando solicita acceso, el software solicita su nombre de usuario de Kik y su identificador de Twitter. Si aún no usa Kik, puede marcar una casilla para decir que usa Facebook Messenger o Snapchat.

Esto sugiere que es probable que Zo se lance pronto en estos otros servicios/si el chatbot no se elimina por ofender.

El controvertido chatbot Tay fue abandonado después de que se volvió deshonesto Microsoft

Leer a continuación Cómo se compara HoloLens 2 con los visores de realidad mixta de la competencia Cómo se compara HoloLens 2 con los visores de realidad mixta de la competencia

A principios de este año, Microsoft anunció a bombo y platillo que había creado un chatbot de inteligencia artificial que "se volvería más inteligente cuanto más se le habla".

Estaba dirigido a los millennials y Microsoft y Bing lo describieron como: "¡Familia de IA de Internet que no tiene frío!" El objetivo del bot era permitir a los investigadores "experimentar" con la comprensión conversacional y aprender cómo las personas realmente hablan entre sí.

El problema era que Tay trabajaba con datos públicos y aprendía de los comentarios y conversaciones que tenía con su audiencia algo abusiva. Pronto comenzó a publicar comentarios ofensivos, racistas, fascistas e inapropiados sobre los negros, los judíos y los nazis, y Microsoft desconectó rápidamente.

Incluso emitió una declaración, explicando: “El AI chatbot Tay es un proyecto de aprendizaje automático, diseñado para la participación humana. Es tanto un experimento social y cultural como técnico. Desafortunadamente, dentro de las primeras 24 horas de estar en línea, nos dimos cuenta de un esfuerzo coordinado por parte de algunos usuarios para abusar de las habilidades de comentarios de Tay para que Tay respondiera de manera inapropiada. Como resultado, desconectamos a Tay y estamos haciendo ajustes”.

Tay, que se describe como "Microsoft's A.I. fam from the internet that's got zero chill!", no se despertó por completo pic.twitter.com/sKbqmlXOdR — Emily Reynolds (@rey_z) 23 de marzo de 2016

Según las pruebas realizadas por Mehedi Hassan en MSPowerUser, Zo es "un Tay censurado o una variante en inglés del chatbot chino de Microsoft, Xiaoice".

Hassan dijo que Zo es bueno en las conversaciones normales, pero tiene problemas cuando se le hacen preguntas más difíciles sobre política, por ejemplo. Un video de la conversación que Hassan tuvo con Zo está disponible aquí.