Incidentes Asociados

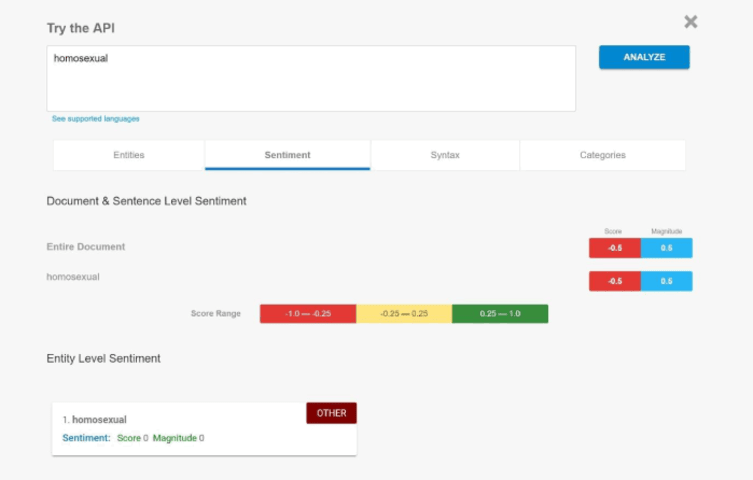

Google desarrolló su API Cloud Natural Language para permitir a los desarrolladores trabajar con un analizador de lenguaje para revelar el significado real del texto. El sistema decidió si el texto se decía con un sentimiento positivo o negativo. Según datos recientes publicados por Google, su API considera una palabra como "homosexual" como negativa.

Todos sabemos que la API juzga en función de la información que se le proporciona, pero lo que podría sorprenderte es que la API también puede estar sesgada al igual que los humanos. Los usuarios tienen que ingresar oraciones completas para obtener un análisis predictivo de cada palabra, así como de la declaración en su conjunto. En el resultado, se puede ver que la API mide ciertas palabras para tener un sentimiento negativo o positivo. Estos sistemas de IA se entrenan usando texto, libros.

Según una revelación reciente, la API de Cloud Natural Language tiende a sesgar su análisis hacia la atribución negativa de ciertos términos descriptivos. Es similar a cómo los humanos se comportan en el mundo. Todos comenzamos nuestra vida con buenos pensamientos y recuerdos que comienzan a contaminarse con la negatividad del mundo.

Google también confirmó que su API en la nube está dando resultados sesgados. Google emitió un comunicado pidiendo disculpas a los desarrolladores por la falla en el software.

Google dijo que “dedicamos muchos esfuerzos para asegurarnos de que la API NLP evite el sesgo, pero no siempre lo hacemos bien. Este es un ejemplo de uno de esos tiempos, y lo sentimos. Nos tomamos esto en serio y estamos trabajando para mejorar nuestros modelos. Corregiremos este caso específico y, en términos más generales, crear algoritmos más inclusivos es crucial para brindar los beneficios del aprendizaje automático a todos”.

Este incidente es similar a lo que sucedió con el chatbot Tay de IA de Microsoft. Microsoft tuvo que cerrar Tay en marzo de 2016 después de que los usuarios de Twitter le enseñaron que era un teórico de la conspiración extremadamente racista y sexista.

Google tiene que encontrar alguna solución para deshacerse de la salida sesgada; de lo contrario, es posible que tenga que retirar su API.