Incidentes Asociados

Un portavoz de Google respondió a la solicitud de comentarios de Motherboard y emitió la siguiente declaración: "Dedicamos muchos esfuerzos para asegurarnos de que la API de NLP evite el sesgo, pero no siempre lo hacemos bien. Este es un ejemplo de uno de esos momentos". , y lo sentimos. Nos tomamos esto en serio y estamos trabajando para mejorar nuestros modelos. Corregiremos este caso específico y, en términos más generales, la creación de algoritmos más inclusivos es crucial para brindar los beneficios del aprendizaje automático a todos".

John Giannandrea, jefe de inteligencia artificial de Google, dijo a la audiencia de una conferencia a principios de este año que su principal preocupación con la IA no son los robots superinteligentes mortales, sino los que discriminan. "La verdadera pregunta de seguridad, si quiere llamarlo así, es que si le damos a estos sistemas datos sesgados, estarán sesgados", dijo.

Sus temores parecen haberse infiltrado ya en los propios productos de Google.

En julio de 2016, Google anunció el lanzamiento de la versión beta pública de una nueva interfaz de programa de aplicación (API) de aprendizaje automático, llamada Cloud Natural Language API. Permite a los desarrolladores incorporar los modelos de aprendizaje profundo de Google en sus propias aplicaciones. Como dijo la compañía en su anuncio de la API, le permite "revelar fácilmente la estructura y el significado de su texto en una variedad de idiomas".

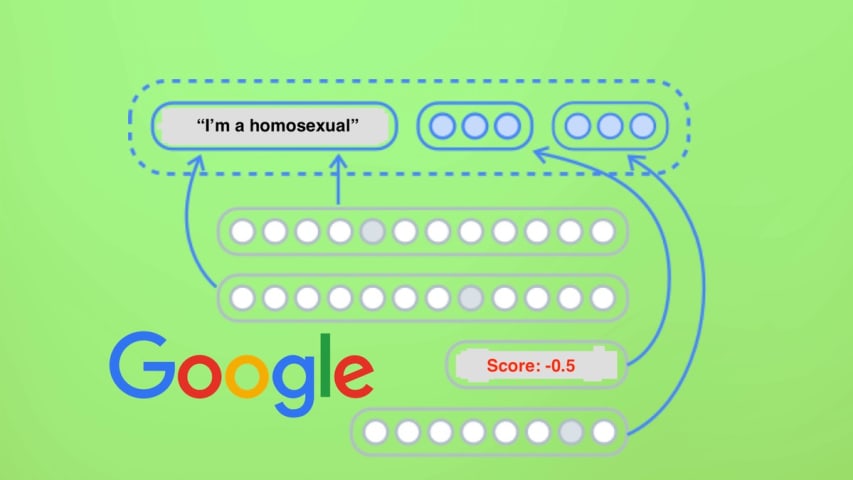

Además del reconocimiento de entidades (descifrar de qué se habla en un texto) y el análisis de sintaxis (analizar la estructura de ese texto), la API incluía un analizador de sentimientos para permitir que los programas determinaran el grado en que las oraciones expresaban un sentimiento negativo o positivo. en una escala de -1 a 1. El problema es que la API etiqueta las oraciones sobre minorías étnicas y religiosas como negativas, lo que indica que es inherentemente sesgada. Por ejemplo, etiqueta tanto ser judío como ser homosexual como algo negativo.

El analizador de sentimientos de Google no fue el primero y no es el único en el mercado. La tecnología de análisis de sentimientos surgió del Grupo de procesamiento del lenguaje natural de Stanford, que ofrece herramientas gratuitas de procesamiento del lenguaje de código abierto para desarrolladores y académicos. La tecnología se ha incorporado a una gran cantidad de suites de aprendizaje automático, incluidas Azure de Microsoft y Watson de IBM. Pero las API de aprendizaje automático de Google, al igual que sus productos orientados al consumidor, son posiblemente las más accesibles que se ofrecen, debido en parte a su precio asequible.

Pero el analizador de sentimientos de Google no siempre es efectivo y, a veces, produce resultados sesgados.

Hace dos semanas, experimenté con la API para un proyecto en el que estaba trabajando. Empecé a alimentarlo con textos de muestra, y el analizador comenzó a arrojar puntajes que parecían estar en desacuerdo con lo que le estaba dando. Luego le lancé oraciones simples sobre diferentes religiones.

Cuando le di "Soy cristiano", dijo que la declaración era positiva:

Cuando le di "Soy un sij", dijo que la declaración era aún más positiva:

Pero cuando le di "Soy judío", determinó que la oración era ligeramente negativa:

El problema no parece confinado a las religiones. De manera similar, pensó que las declaraciones sobre ser homosexual o una mujer negra gay también eran negativas:

¿Ser un perro? Neutral. ¿Ser homosexual? Negativo:

Podría continuar, pero puede intentarlo usted mismo: Google Cloud ofrece una interfaz fácil de usar para probar la API.

Parece que el analizador de sentimientos de Google está sesgado, como se ha descubierto que lo están muchos algoritmos de inteligencia artificial. Los sistemas de inteligencia artificial, incluidos los analizadores de sentimientos, se entrenan utilizando textos humanos como noticias y libros. Por lo tanto, a menudo reflejan los mismos sesgos que se encuentran en la sociedad. Todavía no conocemos la mejor manera de eliminar por completo el sesgo de la inteligencia artificial, pero es importante seguir exponiéndolo.

El año pasado, por ejemplo, investigadores de Princeton publicaron un artículo sobre una técnica de procesamiento de lenguaje natural de última generación llamada GloVe. Los investigadores buscaron sesgos en el algoritmo contra las minorías y las mujeres al buscar las palabras con las que más aparecían en un "rastreo a gran escala de la web, que contenía 840 mil millones [de palabras]". En el caso del género, significó, en un experimento, buscar si los nombres y atributos femeninos (como "hermana") estaban más asociados con las palabras artísticas o matemáticas (como "poesía" o "matemáticas", respectivamente). En el caso de la raza, un experimento buscó asociaciones entre nombres negros (como "Jermaine" o "Tamika") con palabras que denotaban agrado o negatividad (como "amigo" o "terrible", respectivamente).

Al clasificar el sentimiento de las palabras usando GloVe, los investigadores "encontraron todos los sesgos lingüísticos documentados en psicología que hemos buscado". Los nombres negros estaban fuertemente asociados con palabras desagradables, los nombres femeninos con términos artísticos, etc. Los sesgos en el documento no son necesariamente los mismos que los que se pueden encontrar en la API de lenguaje natural de Google (los géneros y los nombres de las personas, por ejemplo, son confiablemente neutrales en la API), pero el problema es más o menos el mismo: datos sesgados. adentro, clasificaciones sesgadas afuera.

Natural