Incidentes Asociados

No culpe al algoritmo: mientras existan disparidades raciales en el sistema de justicia, el software de sentencia nunca podrá ser completamente justo.

Durante generaciones, el pueblo maasai del este de África ha transmitido la historia de un anciano incansable. Vivía solo y su vida no era fácil. Pasó todos los días en los campos: labrando la tierra, cuidando los animales y recogiendo agua. El trabajo era tan necesario como agotador. Pero el anciano se consideró afortunado. Tenía una buena vida y nunca pensó mucho en lo que le faltaba. Una mañana el anciano fue recibido con una agradable sorpresa. De pie en su cocina había un niño, de unos siete u ocho años. El anciano nunca lo había visto antes. El chico sonrió pero no dijo nada. El anciano miró a su alrededor. Su desayuno de la mañana ya estaba preparado, tal como le gustaba. Preguntó el nombre del niño. "Kileken", respondió el niño. Después de insistir un poco, el niño explicó que, antes de preparar el desayuno, había completado todo el trabajo del día del anciano. Incrédulo, el anciano salió. De hecho, los campos habían sido labrados, los animales atendidos y el agua recogida. Con el asombro escrito en todo su rostro, el anciano volvió tambaleándose a la cocina. "¿Cómo pasó esto? ¿Y cómo puedo pagarte? El chico volvió a sonreír, esta vez con desdén. “No aceptaré ningún pago. Todo lo que pido es que me dejes quedarme contigo. El anciano sabía que no debía mirarle los dientes a un caballo regalado. Kileken y el anciano pronto se volvieron inseparables, y la granja se volvió exuberante y abundante como nunca antes. El anciano apenas podía recordar cómo era la vida antes de la llegada de su joven camarada. No cabía duda: con la misteriosa ayuda de Kileken, el anciano estaba prosperando. Pero nunca entendió bien por qué, o cómo, había sucedido.

Hasta cierto punto que no hemos reconocido plenamente, los algoritmos de toma de decisiones se han convertido en el Kileken colectivo de nuestra sociedad. Aparecen sin previo aviso y donde menos los esperamos, prometen y, a menudo, ofrecen grandes cosas, y rápidamente pasan a ser vistos como indispensables. Su alcance no puede ser sobreestimado. Les dicen a los comerciantes qué acciones comprar y vender, determinan cuánto cuesta nuestro seguro de automóvil, influyen en qué productos nos muestra Amazon y cuánto nos cobran por ellos, e interpretan nuestras búsquedas en Google y clasifican sus resultados.

Estos algoritmos mejoran la eficiencia y la precisión de los servicios en los que todos confiamos, crean nuevos productos que nunca antes podríamos haber imaginado, liberan a las personas del trabajo tedioso y son un motor de crecimiento económico aparentemente ilimitado. También impregnan áreas de toma de decisiones sociales que tradicionalmente se han dejado al juicio humano directo, como el emparejamiento romántico y las sentencias penales. Sin embargo, están en gran parte ocultos a la vista, permanecen opacos incluso cuando se nos pide que los examinemos y rara vez están sujetos a los mismos controles y equilibrios que los humanos que toman decisiones.

Peor aún, algunos de estos algoritmos parecen reflejarnos los prejuicios más feos de la sociedad. En abril pasado, por ejemplo, nuestros feeds de Facebook, seleccionados por un laberinto de algoritmos, se inundaron con historias sobre FaceApp, un programa que aplicaba filtros a las fotografías cargadas para que el usuario pareciera más joven, mayor o más atractivo. Al principio, esta aplicación parecía ser solo otro lanzamiento inteligente para la generación de Snapchat. Pero las cosas se torcieron rápidamente cuando los usuarios descubrieron que el filtro "caliente" de la aplicación, que pretendía transformar a Joes y Jills regulares en hermosos Adonises y Aphrodites, hizo que la piel fuera más clara, los ojos más redondos y las narices más pequeñas. La aplicación parecía equiparar el atractivo físico con los rasgos faciales europeos. La reacción fue rápida, despiadada y aparentemente bien merecida. La aplicación, y, en consecuencia, el algoritmo del que dependía, parecía ser racista. La compañía primero cambió el nombre del filtro "caliente" para "excluir cualquier connotación positiva asociada con él", antes de sacarlo de la aplicación sin contemplaciones.

El filtro caliente de FaceApp estuvo lejos de ser el primer algoritmo acusado de racismo, y ciertamente no será el último. La función de autocompletar de Google, que se basa en un algoritmo que escanea las búsquedas anteriores de otros usuarios para tratar de adivinar su consulta, es criticada regularmente por destacar los sentimientos racistas, sexistas y otros sentimientos regresivos que de otro modo permanecerían escondidos en los rincones más oscuros de Internet y nuestra psique.

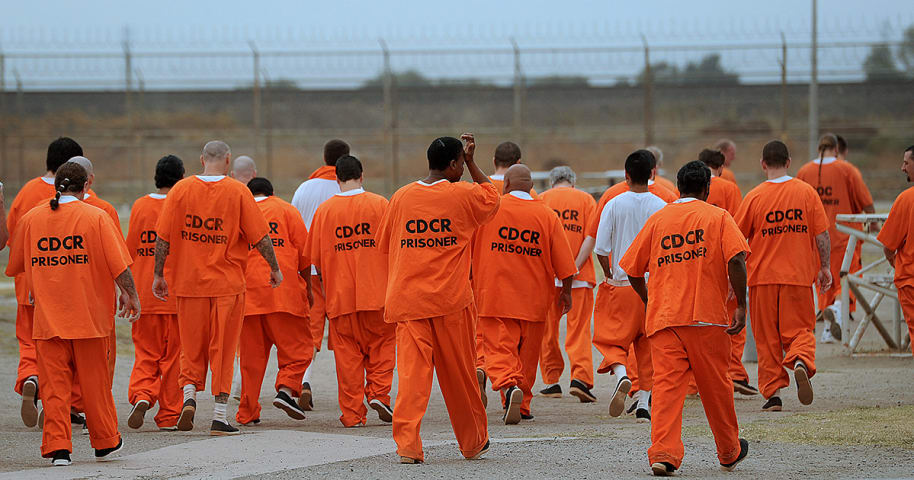

Pero si bien las aplicaciones maliciosas o las desconcertantes sugerencias de autocompletar son efímeras y potencialmente responden a la protesta pública, difícilmente se puede decir lo mismo sobre la insidiosa invasión de los algoritmos de toma de decisiones en el funcionamiento de nuestro sistema legal, donde con frecuencia desempeñan un papel fundamental para determinar el destino de los acusados y, como FaceApp, a menudo muestran una preferencia por los sujetos blancos. Pero el problema va más allá de la piel. El problema es que no podemos escapar del largo brazo de América.