Incidentes Asociados

Predecir el futuro no es solo la procedencia de los adivinos o los expertos de los medios. Los algoritmos predictivos, basados en amplios conjuntos de datos y estadísticas, han superado las operaciones mayoristas y minoristas, como sabe cualquier comprador en línea. Y en los últimos años, los algoritmos se utilizan para automatizar la toma de decisiones sobre préstamos bancarios, admisiones escolares, contrataciones y, de manera infame, para predecir la reincidencia: la probabilidad de que un acusado cometa otro delito en los próximos dos años.

COMPAS, que significa Perfil de gestión de delincuentes correccionales para sanciones alternativas, es un programa de este tipo y ProPublica lo señaló a principios de este año por tener prejuicios raciales. COMPAS utiliza 137 variables en su algoritmo de puntuación patentado y no publicado; la raza no es una de esas variables. ProPublica utilizó un conjunto de datos de acusados en el condado de Broward, Florida. Los datos incluían datos demográficos, antecedentes penales, una puntuación COMPAS [1] y las acciones delictivas en los dos años siguientes. ProPublica luego entrecruzó estos datos con la raza de los acusados. Sus hallazgos son generalmente aceptados por todas las partes.

COMPAS es moderadamente preciso en la identificación de la reincidencia de blancos y negros alrededor del 60% de las veces.

Los errores de COMPAS reflejan un aparente sesgo racial. Los negros son más a menudo identificados erróneamente como riesgos reincidentes (estadísticamente un falso positivo) y los blancos son identificados erróneamente con mayor frecuencia como no siendo un riesgo (un falso negativo).

Es más probable que la "sanción" por ser clasificado erróneamente como un riesgo más alto sea un castigo más severo. Ser clasificado erróneamente como de menor riesgo es como una tarjeta de "Salga de la cárcel".

Como puede anticipar, siguió una controversia significativa expresada principalmente en una pelea académica sobre qué medidas o cálculos estadísticos representaban con mayor precisión el sesgo. Un estudio en Science Advances revisa la discusión y llega a una conclusión diferente.

El estudio

En el estudio actual, la evaluación realizada por humanos se comparó con la de COMPAS utilizando ese conjunto de datos del condado de Broward. Los humanos fueron encontrados en Mechanical Turk [2] de Amazon, se les pagó un dólar por participar y un bono de $5 si eran precisos más del 60 % de las veces.

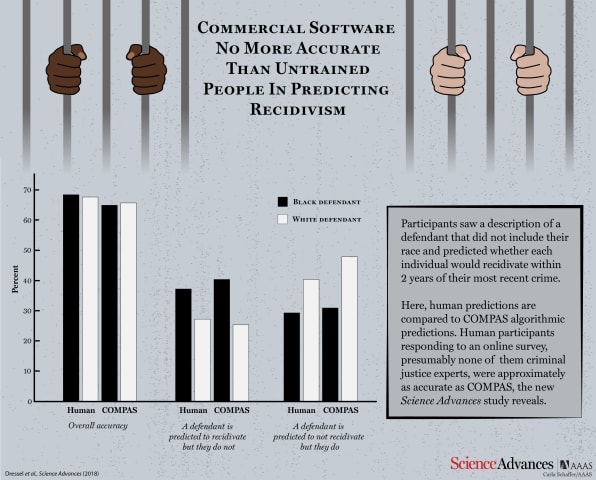

Los humanos fueron tan precisos como el algoritmo (62 vs. 65%)

Los errores del algoritmo y los humanos fueron idénticos, sobreprediciendo (falsos positivos) la reincidencia para los acusados negros y subestimando (falsos negativos) para los acusados blancos.

Humanos COMPAS Negro % Blanco % Negro % Blanco % Precisión* 68,2 67,6 64,9 65,7 Falsos positivos 37,1 27,2 40,4 25,4 Falsos negativos 29,2 40,3 30,9 47,9

- La precisión es la suma de verdaderos positivos y verdaderos negativos estadísticamente hablando

Los evaluadores humanos utilizaron solo siete variables, no las 137 de COMPAS. [3] Esto sugiere que el algoritmo era innecesariamente complejo al menos para decidir el riesgo de reincidencia. De hecho, los investigadores encontraron que solo dos variables, la edad del acusado y la cantidad de condenas anteriores, eran tan precisas como las predicciones de COMPAS.

De mayor interés es el hallazgo de que cuando a los evaluadores humanos se les proporcionó información adicional sobre la raza del acusado, no tuvo ningún impacto. Fueron igual de precisos y demostraron la misma disparidad racial en falsos positivos y negativos. La raza fue un factor de confusión asociado, pero no fue la causa de la diferencia estadística. La narrativa de ProPublica sobre el sesgo racial era incorrecta.

Los algoritmos son modelos estadísticos que implican elecciones. Si optimiza para encontrar todos los verdaderos positivos, sus falsos positivos aumentarán. Reduzca su tasa de falsos positivos y aumentarán los falsos negativos. ¿Queremos encarcelar más o menos? El MIT Technology Review lo expresa de esta manera.

“¿Estamos interesados principalmente en correr el menor riesgo posible de que alguien se salte la fianza o reincida? ¿Qué concesiones deberíamos hacer para garantizar la justicia y reducir los costos sociales masivos del encarcelamiento?”.

COMPAS está destinado a servir como una ayuda para la toma de decisiones. El propósito de las 137 variables es crear una variedad de escalas que representen el abuso de sustancias, el entorno, la oportunidad delictiva, los asociados, etc. Su función es ayudar a los humanos de nuestro sistema de justicia a determinar un castigo apropiado. [4] Ninguno de los estudios, que yo sepa, analizó las sentencias dictadas. La presente investigación finaliza de la siguiente manera:

“Al considerar el uso de software como COMPAS para tomar decisiones que afectarán significativamente la vida y el bienestar de los acusados de delitos, es valioso preguntarse si pondríamos estas decisiones en manos de personas aleatorias que respondan a una encuesta en línea porque, al final, los resultados de estos dos enfoques parecen ser indistinguibles”.

La respuesta es no. COMPAS y algoritmos similares son herramientas, no un reemplazo PARA el juicio humano. Facilitan pero no automatizan. ProPublica tiene razón cuando dice que las decisiones algorítmicas deben ser entendidas por sus usuarios humanos y requieren validación y refinamiento continuos. Pero la narrativa de ProPublica, que las fuerzas del mal fueron responsables de un algoritmo racialmente sesgado, no es cierta.

[1] COMPAS se puntúa en una escala del 1 al 10, con puntuaciones superiores