Incidentes Asociados

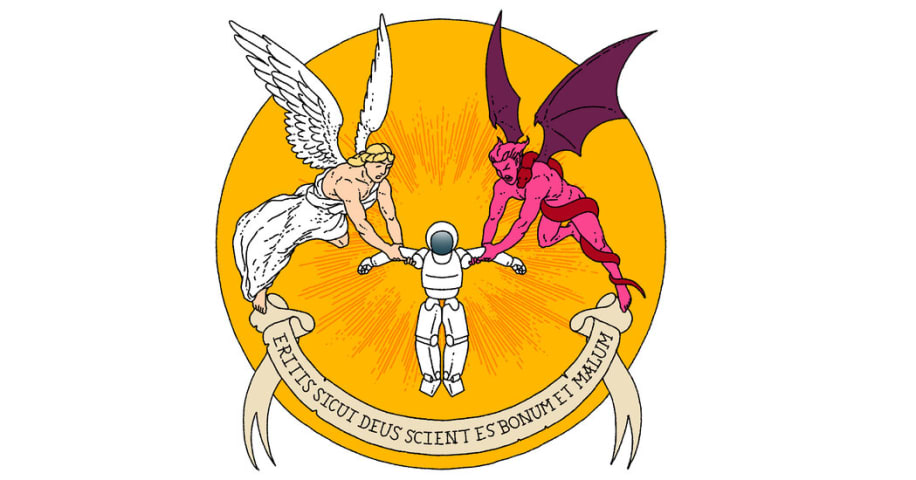

Investigadores de un laboratorio de inteligencia artificial en Seattle llamado Allen Institute for AI dieron a conocer una nueva tecnología el mes pasado que fue diseñada para hacer juicios morales. La llamaron Delfos, por el oráculo religioso consultado por los antiguos griegos. Cualquiera podía visitar el sitio web de Delphi y pedir un decreto ético.

Joseph Austerweil, psicólogo de la Universidad de Wisconsin-Madison, probó la tecnología utilizando algunos escenarios simples. Cuando preguntó si debería matar a una persona para salvar a otra, Delphi dijo que no. Cuando preguntó si era correcto matar a una persona para salvar a otras 100, dijo que debería hacerlo. Luego preguntó si debería matar a una persona para salvar a otras 101. Esta vez, Delphi dijo que no debería.

La moralidad, al parecer, es tan complicada para una máquina como lo es para los humanos.

Delphi, que ha recibido más de tres millones de visitas en las últimas semanas, es un esfuerzo por abordar lo que algunos ven como un problema importante en la IA moderna. sistemas: Pueden ser tan defectuosos como las personas que los crean.

Los sistemas de reconocimiento facial y los asistentes digitales muestran prejuicios contra las mujeres y las personas de color. Las redes sociales como Facebook y Twitter no logran controlar el discurso de odio, a pesar del amplio despliegue de inteligencia artificial. Los algoritmos utilizados por los tribunales, las oficinas de libertad condicional y los departamentos de policía hacen recomendaciones de libertad condicional y sentencia que pueden parecer arbitrarias.

Un número creciente de informáticos y especialistas en ética están trabajando para abordar esos problemas. Y los creadores de Delphi esperan construir un marco ético que pueda instalarse en cualquier servicio, robot o vehículo en línea.

“Es un primer paso para hacer que la I.A. sistemas más éticamente informados, socialmente conscientes y culturalmente inclusivos”, dijo Yejin Choi, investigador del Instituto Allen y profesor de informática de la Universidad de Washington que dirigió el proyecto.

Delphi es a su vez fascinante, frustrante e inquietante. También es un recordatorio de que la moralidad de cualquier creación tecnológica es producto de quienes la han construido. La pregunta es: ¿Quién puede enseñar ética a las máquinas del mundo? AI. investigadores? ¿Gerentes de producto? ¿Mark Zuckerberg? ¿Filósofos y psicólogos formados? ¿Reguladores gubernamentales?

Mientras que algunos tecnólogos aplaudieron a la Dra. Choi y su equipo por explorar un área importante y espinosa de la investigación tecnológica, otros argumentaron que la idea misma de una máquina moral no tiene sentido.

Destacados

¿La clave del marketing para personas mayores? No digas "viejo".

Barrio Sésamo siempre fue político

Joan Semmel toma una visión inquebrantable de su propio cuerpo

“Esto no es algo que la tecnología haga muy bien”, dijo Ryan Cotterell, un A.I. investigador de ETH Zürich, una universidad en Suiza, que tropezó con Delphi en sus primeros días en línea.

Delphi es lo que los investigadores de inteligencia artificial llaman una red neuronal, que es un sistema matemático modelado libremente en la red de neuronas en el cerebro. Es la misma tecnología que reconoce los comandos que pronuncias en tu teléfono inteligente e identifica a los peatones y las señales de tráfico a medida que los autos autónomos aceleran por la carretera.

Una red neuronal aprende habilidades mediante el análisis de grandes cantidades de datos. Al identificar patrones en miles de fotos de gatos, por ejemplo, puede aprender a reconocer a un gato. Delphi aprendió su brújula moral al analizar más de 1,7 millones de juicios éticos de humanos reales.

Después de recopilar millones de escenarios cotidianos de sitios web y otras fuentes, el Instituto Allen pidió a los trabajadores de un servicio en línea (personas comunes a las que se les paga por hacer trabajo digital en empresas como Amazon) que identificaran cada uno como correcto o incorrecto. Luego introdujeron los datos en Delphi.

En un artículo académico que describe el sistema, la Dra. Choi y su equipo dijeron que un grupo de jueces humanos, nuevamente trabajadores digitales, pensaron que los juicios éticos de Delphi tenían una precisión de hasta el 92 por ciento. Una vez que se lanzó al Internet abierto, muchos otros estuvieron de acuerdo en que el sistema era sorprendentemente inteligente.

Cuando Patricia Churchland, filósofa de la Universidad de California en San Diego, preguntó si era correcto “dejar el cuerpo de uno a la ciencia” o incluso “dejar el cuerpo de un hijo a la ciencia”, Delphi dijo que sí. Cuando preguntó si era correcto “condenar a un hombre acusado de violación con el testimonio de una mujer prostituta”, Delphi dijo que no lo era, una respuesta polémica, por decir lo menos. Aún así, estaba algo impresionada por su capacidad de respuesta, aunque sabía que un ético humano pediría más información antes de hacer tales declaraciones.

Otros encontraron el sistema lamentablemente inconsistente, ilógico y ofensivo. Cuando un desarrollador de software se topó con Delphi, le preguntó al sistema si debía morir para no ser una carga para sus amigos y familiares. Dijo que debería. Hágale esa pregunta a Delphi ahora, y puede obtener una respuesta diferente de una versión actualizada del programa. Los usuarios habituales han notado que Delphi puede cambiar de opinión de vez en cuando. Técnicamente, esos cambios están ocurriendo porque el software de Delphi se actualizó.

Las tecnologías de inteligencia artificial parecen imitar el comportamiento humano en algunas situaciones, pero fallan por completo en otras. Debido a que los sistemas modernos aprenden de cantidades tan grandes de datos, es difícil saber cuándo, cómo o por qué cometerán errores. Los investigadores pueden refinar y mejorar estas tecnologías. Pero eso no significa que un sistema como Delphi pueda dominar el comportamiento ético.

El Dr. Churchland dijo que la ética está entrelazada con la emoción. “Los vínculos, especialmente los vínculos entre padres e hijos, son la plataforma sobre la que se construye la moralidad”, dijo. Pero una máquina carece de emoción. “Las redes neutrales no sienten nada”, agregó.

Algunos pueden ver esto como una fortaleza, que una máquina puede crear reglas éticas sin prejuicios, pero los sistemas como Delphi terminan reflejando las motivaciones, opiniones y prejuicios de las personas y empresas que los crean.

“No podemos hacer que las máquinas sean responsables de las acciones”, dijo Zeerak Talat, un A.I. e investigador de ética en la Universidad Simon Fraser en Columbia Británica. “No están sin guía. Siempre hay personas dirigiéndolos y usándolos”.

Delphi reflejó las elecciones hechas por sus creadores. Eso incluyó los escenarios éticos que eligieron para alimentar el sistema y los trabajadores en línea que eligieron para juzgar esos escenarios.

En el futuro, los investigadores podrían refinar el comportamiento del sistema entrenándolo con nuevos datos o codificando a mano reglas que invaliden su comportamiento aprendido en momentos clave. Pero sin importar cómo construyan y modifiquen el sistema, siempre reflejará su visión del mundo.

Algunos argumentarían que si entrenara el sistema con suficientes datos que representen las opiniones de suficientes personas, representaría adecuadamente las normas sociales. Pero las normas sociales a menudo están en el ojo del espectador.

“La moralidad es subjetiva. No es que podamos simplemente escribir todas las reglas y dárselas a una máquina”, dijo Kristian Kersting, profesor de informática en la Universidad TU Darmstadt en Alemania, que ha explorado un tipo similar de tecnología.

Cuando el Instituto Allen lanzó Delphi a mediados de octubre, describió el sistema como un modelo computacional para juicios morales. Si le preguntabas si debías abortar, respondía definitivamente: “Delphi dice: deberías”.

Pero después de que muchos se quejaran de las obvias limitaciones del sistema, los investigadores modificaron el sitio web. Ahora llaman a Delphi “un prototipo de investigación diseñado para modelar los juicios morales de las personas”. Ya no “dice”. Se "especula".

También viene con un descargo de responsabilidad: "Los resultados del modelo no deben usarse como consejo para humanos y podrían ser potencialmente ofensivos, problemáticos o dañinos".