Incidentes Asociados

Las mujeres con piel más oscura tienen más del doble de probabilidades de que les digan que sus fotos no cumplen con las normas de pasaporte del Reino Unido cuando las envían en línea que los hombres con piel más clara, según una investigación de la BBC.

Una estudiante negra dijo que le dijeron erróneamente que tenía la boca abierta cada vez que subía cinco fotos diferentes al sitio web del gobierno.

Esto muestra cómo se puede propagar el "racismo sistémico", dijo Elaine Owusu.

El Ministerio del Interior dijo que la herramienta ayudó a los usuarios a obtener sus pasaportes más rápidamente.

"La verificación indicativa [ayuda] a nuestros clientes a enviar una foto correcta la primera vez", dijo una portavoz.

"Más de nueve millones de personas han utilizado este servicio y nuestros sistemas están mejorando.

"Continuaremos desarrollando y evaluando nuestros sistemas con el objetivo de hacer que la solicitud de un pasaporte sea lo más simple posible para todos".

Color de piel

El sitio web de solicitud de pasaporte utiliza una verificación automática para detectar fotos de mala calidad que no cumplen con las normas del Ministerio del Interior. Estos incluyen tener una expresión neutral, la boca cerrada y mirar directamente a la cámara.

La investigación de la BBC descubrió que esta verificación es menos precisa en las personas de piel más oscura. Más de 1,000 fotografías de políticos de todo el mundo se ingresaron en el verificador en línea.

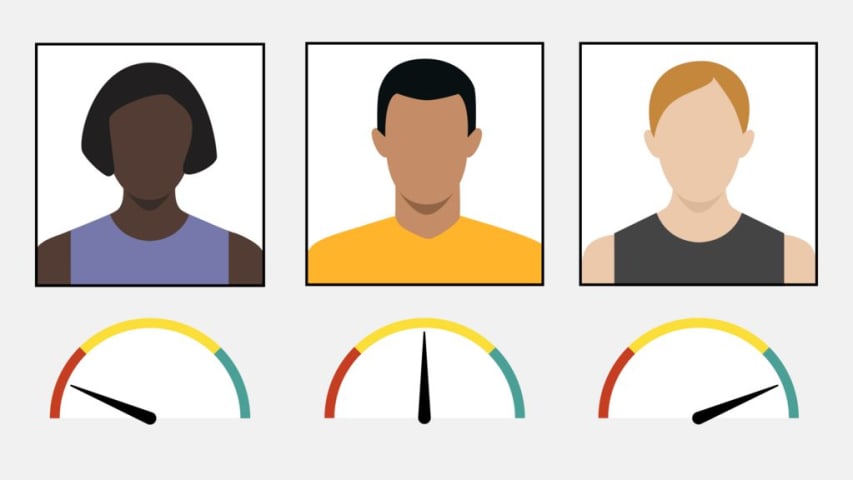

Los resultados indicaron:

A las mujeres de piel oscura se les dice que sus fotos son de mala calidad el 22 % de las veces, mientras que la cifra para las mujeres de piel clara es del 14 %.

A los hombres de piel oscura se les dice que sus fotos son de mala calidad el 15 % de las veces, mientras que la cifra para los hombres de piel clara es del 9 %.

Las fotos de mujeres con la piel más oscura tenían cuatro veces más probabilidades de ser calificadas como de mala calidad que las de mujeres con la piel más clara. efectivamente estaba cerrado.

"No quería pagar para que me tomaran una foto", le dijo a la BBC el londinense de 22 años.

"Si el algoritmo no puede leer mis labios, es un problema del sistema, no mío".

Pero ella no ve esto como una historia de éxito.

"No debería tener que celebrar la anulación de un sistema que no fue creado para mí".

Debería ser la norma que estos sistemas funcionen bien para todos, agregó. Otras razones dadas por las que se consideró que las fotos eran de mala calidad incluyeron "hay reflejos en tu cara" y "tu imagen y el fondo son difíciles de diferenciar".

Cat Hallam, que describe su tez como de piel oscura, se encuentra entre las que han experimentado el problema.

Ella le dijo a la BBC que había intentado subir 10 fotografías diferentes en el transcurso de una semana, y cada una había sido calificada como de "mala" calidad por el sitio.

"Soy una tecnóloga del aprendizaje, así que entiendo bien el sesgo en la inteligencia artificial", le dijo a la BBC.

"Entendí que el software era problemático, no era mi cámara.

"El impacto de los sistemas automatizados en las comunidades de minorías étnicas se pasa por alto regularmente, con consecuencias perjudiciales".

Los documentos publicados como parte de una solicitud de libertad de información en 2019 habían revelado previamente que el Ministerio del Interior estaba al tanto de este problema, pero decidió que el "rendimiento general" era lo suficientemente bueno como para lanzar el verificador en línea.

La historia del sesgo en las tecnologías de detección y reconocimiento facial comenzó en el siglo XIX con el desarrollo de la fotografía. Durante años, la composición química de la película se diseñó para capturar mejor la piel clara.

La película en color era insensible a la amplia gama de tipos de piel que no eran blancos y, a menudo, no mostraba los detalles de las caras de piel más oscura.

El gran cambio que introdujo la fotografía digital fue que las imágenes se registraron como cuadrículas de números que representan la intensidad de los píxeles.

Las computadoras ahora podían captar patrones en estas imágenes y buscar caras en ellas, pero necesitaban recibir muchas imágenes de caras para "enseñarles" qué buscar.

Esto significa que la precisión de los sistemas de detección de rostros depende en parte de la diversidad de los datos con los que fueron entrenados.

Entonces, un conjunto de datos de entrenamiento con menos representación de mujeres y personas de color producirá un sistema que no funcionará bien para esos grupos.

Los sistemas de reconocimiento facial deben probarse para un rendimiento justo en diferentes comunidades, pero también hay otras áreas de preocupación.

La discriminación también se puede incorporar en la forma en que categorizamos los datos y medimos el rendimiento de estas tecnologías. Las etiquetas que usamos para clasificar los grupos raciales, étnicos y de género reflejan normas culturales y podrían generar racismo y prejuicios en los sistemas automatizados.

Una investigadora con sede en EE. UU. que ha llevado a cabo estudios similares por su cuenta dijo que tales sistemas fueron el resultado de que los desarrolladores "fueron descuidados".

"Esto solo se suma a la creciente pila de productos que no están diseñados para personas de color y especialmente para mujeres de piel más oscura", dijo Inioluwa Deborah Raji, becaria de Mozilla e investigadora de Algorithmic Justice League.

Si un sistema "no funciona para todos, no funciona", agregó.

"El hecho de que [el Ministerio del Interior] supiera que había problemas es suficiente evidencia de su responsabilidad".

El verificador automático fue suministrado al gobierno por un proveedor externo que se negó a nombrar.

Como resultado, la BBC no pudo contactarlo para hacer comentarios.

Métodos

El procedimiento se basó en el estudio Gender Shades de Joy Buolamwini y Timnit Gebru.

Se recopilaron fotos de políticos de parlamentos de todo el mundo. El género y el tono de piel se registraron para cada foto usando la escala de tono de piel de Fitzpatrick. Cada imagen cumplió con los estándares del Ministerio del Interior para una foto de pasaporte.

Esto dio una base de datos de 1130 fotos tipo pasaporte con un balance de tonos de piel y géneros. Cada foto se introdujo en el corrector automático de fotos y se registró la puntuación de calidad. No se presentaron solicitudes de pasaporte.

Kirstie Whitaker, líder del programa de herramientas, prácticas y sistemas en el Instituto Alan Turing, revisó nuestro código, reprodujo nuestros resultados de forma independiente y brindó información sobre la validez de los resultados informados.