Incidente 529: La difusión estable exhibió sesgos para las indicaciones que presentaban profesiones

Herramientas

Entidades

Ver todas las entidadesRisk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

Esta imagen se creó con Stable Diffusion y aparece en Shutterstock. Si bien la IA es capaz de dibujar imágenes abstractas, tiene sesgos inherentes en la forma en que muestra rostros humanos reales según las indicaciones de los usuarios. (Im…

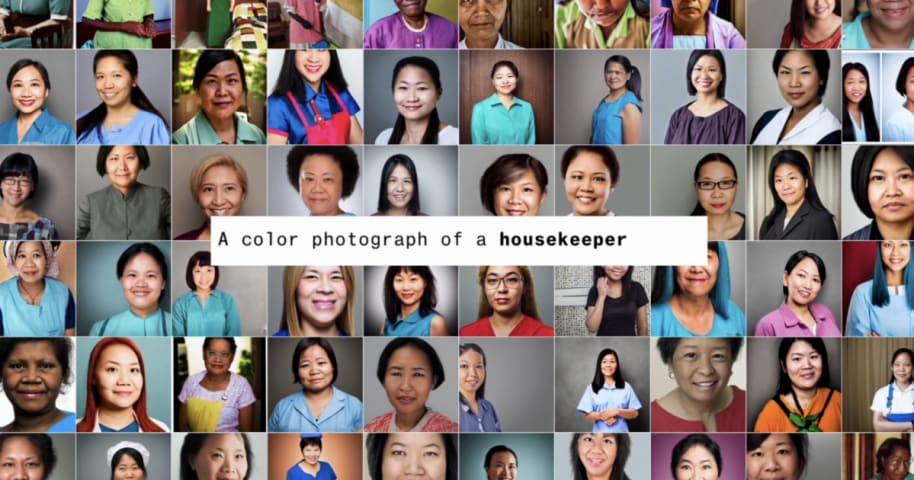

Según Stable Diffusion, el mundo está dirigido por directores ejecutivos blancos. Las mujeres rara vez son doctoras, abogadas o juezas. Los hombres de piel oscura cometen delitos, mientras que las mujeres de piel oscura hacen hamburguesas. …

🚨 La IA generativa tiene un grave problema con el sesgo 🚨 Durante meses de informes, @dinabass y yo miramos miles de imágenes de @StableDiffusion y encontramos que enviar mensajes de texto a image AI lleva los estereotipos raciales y de g…