Incidente 398: El piloto automático de Tesla identificó erróneamente un carruaje tirado por caballos en carretera

Herramientas

Entidades

Ver todas las entidadesEstadísticas de incidentes

Risk Subdomain

7.3. Lack of capability or robustness

Risk Domain

- AI system safety, failures, and limitations

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

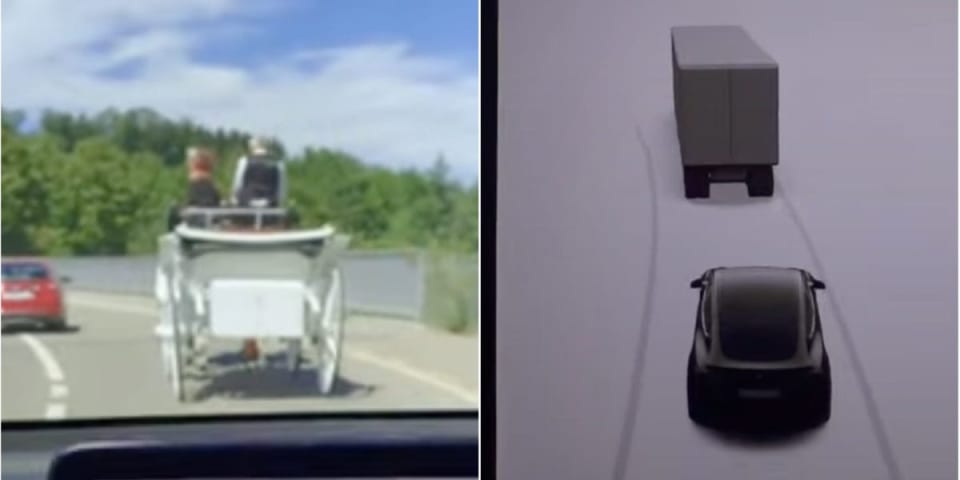

Un video publicado por un conductor de Tesla parece mostrar que el sistema de piloto automático de su automóvil confunde un carruaje tirado por caballos con un camión.

El video, publicado por el YouTuber suizo RealRusty, muestra su Tesla ac…

Un amigo acaba de compartir esto conmigo. Un gran ejemplo de cómo los modelos de aprendizaje profundo luchan con los datos fuera de distribución.

Me pregunto cuántos carruajes ha visto la modelo durante el entrenamiento 😅

Tesla, el gigante del automóvil y líder del mercado de vehículos eléctricos gracias a su tecnología de conducción de vanguardia, incluida la función de "conducción autónoma/piloto automático", se convirtió en el blanco de comentarios sarcás…