Incidentes Asociados

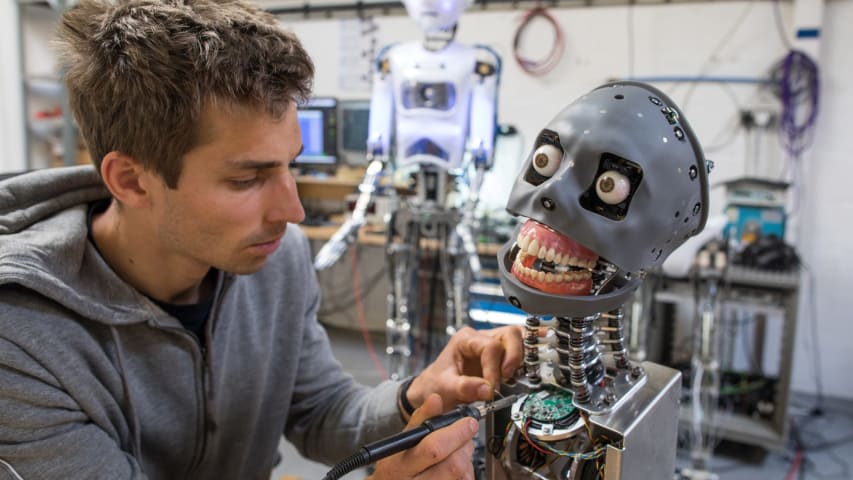

Foto: Matt Cardy (imágenes falsas)

Todos hemos visto máquinas malvadas en Terminator o Matrix, pero ¿cómo se vuelve malvada una máquina? ¿Es como el Proyecto Satán de Futurama, donde los científicos combinaron partes de varios autos malvados para crear el auto malvado definitivo? ¿O las máquinas simplemente están destinadas a eventualmente volverse malas cuando su poder de procesamiento o lo que sea sea lo suficientemente avanzado? Resulta que una forma garantizada de hacer que una máquina se estropee es ponerla en manos de algunos científicos que están tratando activamente de crear un "psicópata" de IA, que es exactamente lo que ha logrado un grupo del MIT con un algoritmo. llamado "Norman", como el chico de Psycho.

Esto proviene de Newsweek, que explica que los científicos alimentaron exclusivamente a Norman con contenido violento y espantoso de una página de Reddit sin nombre antes de mostrarle una serie de pruebas de manchas de tinta de Rorschach. Mientras que una IA "estándar" interpretaría las imágenes como, por ejemplo, "una foto en blanco y negro de un guante de béisbol", Norman ve que "un hombre es asesinado por una ametralladora a plena luz del día". Si eso suena extremo, las respuestas de Norman son mucho peores. En serio, puede que solo sea un algoritmo, pero si arrojaran esta cosa en uno de esos horribles cuerpos de perros de Boston Dynamics, solo tendríamos unos minutos antes de que Killbots y Murderoids comenzaran a pisotear nuestros cráneos. Estos son algunos ejemplos del estudio:

Captura de pantalla: Norman: la primera IA psicópata del mundo

Anuncio publicitario

Captura de pantalla: Norman: la primera IA psicópata del mundo

Captura de pantalla: Norman: la primera IA psicópata del mundo

Captura de pantalla: Norman: la primera IA psicópata del mundo

Anuncio publicitario

En serio, si "el hombre se mete en la máquina de masa" no te da escalofríos, entonces es posible que debas comenzar a preguntarte si las máquinas ya te han asimilado. Además, para que conste, el estudio dice que a Norman en realidad no se le dieron fotos de personas reales muriendo; solo usó leyendas de imágenes gráficas de la página de Reddit sin nombre (que no tiene nombre en el estudio debido a su contenido violento).

Afortunadamente, había un propósito detrás de esta locura más allá de tratar de acelerar la destrucción de la humanidad. El equipo del MIT (Pinar Yanardag, Manuel Cebrian e Iyad Rahwan) en realidad estaba tratando de mostrar cómo algunos algoritmos de IA no tienen necesariamente un sesgo inherente, pero pueden volverse sesgados en función de los datos que reciben. En otras palabras, no construyeron a Norman como un psicópata, sino que se convirtió en un psicópata porque todo lo que sabía sobre el mundo era lo que aprendió de una página de Reddit. (Eso último parece que debería ser particularmente relevante para algunas personas en Internet, pero vamos a suponer que esa no era la intención del equipo del MIT).