Incidentes Asociados

Fue una historia impactante. “Machine Bias”, decía el titular, y el adelanto proclamaba: “Hay software utilizado en todo el país para predecir futuros delincuentes. Y está sesgado contra los negros”.

ProPublica, una organización de noticias sin fines de lucro ganadora del Premio Pulitzer, había analizado un software de evaluación de riesgos conocido como COMPAS. Se está utilizando para pronosticar qué delincuentes tienen más probabilidades de reincidir. Guiados por dichos pronósticos, los jueces en los tribunales de los Estados Unidos toman decisiones sobre el futuro de los acusados y convictos, determinando todo, desde los montos de las fianzas hasta las sentencias. Cuando ProPublica comparó las evaluaciones de riesgo de COMPAS para más de 10,000 personas arrestadas en un condado de Florida con la frecuencia con la que esas personas realmente reincidieron, descubrió que el algoritmo "predijo correctamente la reincidencia para los acusados blancos y negros en aproximadamente la misma tasa". Pero cuando el algoritmo estaba equivocado, lo estaba de diferentes maneras para los negros y los blancos. Específicamente, "los negros tienen casi el doble de probabilidades que los blancos de ser etiquetados como de mayor riesgo, pero en realidad no reinciden". Y COMPAS tendía a cometer el error opuesto con los blancos: “Es mucho más probable que se les etiquete como de menor riesgo que a los negros, pero luego cometen otros delitos”.

Si es apropiado usar sistemas como COMPAS es una cuestión que va más allá de los prejuicios raciales. La Corte Suprema de los EE. UU. pronto podría tomar el caso de un convicto de Wisconsin que dice que se violó su derecho al debido proceso cuando el juez que lo sentenció consultó a COMPAS, porque el funcionamiento del sistema era opaco para el acusado. También existen problemas potenciales con otros sistemas automatizados de toma de decisiones (ADM) fuera del sistema de justicia. Sobre la base de las pruebas de personalidad en línea, los ADM están ayudando a determinar si alguien es la persona adecuada para un trabajo. Los algoritmos de puntuación de crédito juegan un papel muy importante a la hora de obtener una hipoteca, una tarjeta de crédito o incluso las ofertas de telefonía móvil más rentables.

No es necesariamente una mala idea utilizar sistemas de evaluación de riesgos como COMPAS. En muchos casos, los sistemas ADM pueden aumentar la equidad. La toma de decisiones humanas a veces es tan incoherente que necesita supervisión para adecuarla a nuestros estándares de justicia. Como mostró un estudio específicamente inquietante, las juntas de libertad condicional tenían más probabilidades de liberar a los convictos si los jueces acababan de tomar un descanso para comer. Esto probablemente nunca se les había ocurrido a los jueces. Un sistema ADM podría descubrir tales inconsistencias y mejorar el proceso.

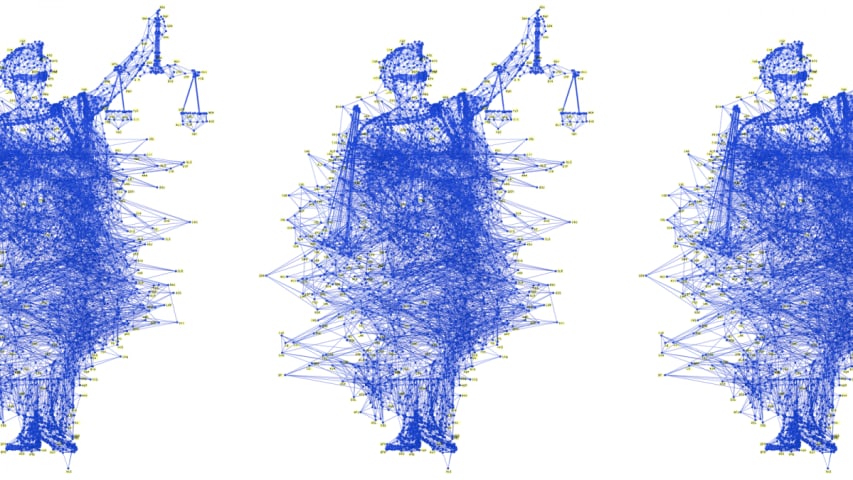

Pero a menudo no sabemos lo suficiente sobre cómo funcionan los sistemas ADM para saber si son más justos de lo que serían los humanos por sí solos. En parte porque los sistemas toman decisiones sobre la base de suposiciones subyacentes que no están claras ni siquiera para los diseñadores de sistemas, no es necesariamente posible determinar qué algoritmos están sesgados y cuáles no. E incluso cuando la respuesta parece clara, como en los hallazgos de ProPublica sobre COMPAS, la verdad a veces es más complicada.

Los legisladores, los tribunales y un público informado deben decidir qué queremos que prioricen los algoritmos.

¿Qué debemos hacer para manejar mejor los ADM? Las sociedades democráticas necesitan más supervisión sobre tales sistemas de la que tienen ahora. AlgorithmWatch, una organización de defensa sin fines de lucro con sede en Berlín que cofundé con un informático, un filósofo del derecho y un colega periodista, tiene como objetivo ayudar a las personas a comprender los efectos de tales sistemas. “El hecho de que la mayoría de los procedimientos de ADM sean cajas negras para las personas afectadas por ellos no es una ley de la naturaleza. Debe terminar”, afirmamos en nuestro manifiesto. Aún así, nuestra opinión sobre el tema es diferente de la de muchos críticos, porque nuestro temor es que la tecnología pueda ser satanizada inmerecidamente. Lo importante es que las sociedades, y no solo los creadores de algoritmos, hagan los juicios de valor que se incluyen en los ADM.

Medidas de equidad

COMPAS determina sus puntajes de riesgo a partir de las respuestas a un cuestionario que explora los antecedentes penales y las actitudes sobre el delito del acusado. ¿Produce esto resultados sesgados?

Después de la investigación de ProPublica, Northpointe, la empresa que desarrolló COMPAS, cuestionó la historia, argumentando que los periodistas malinterpretaron los datos. Lo mismo hicieron tres investigadores de justicia penal, incluido uno de una organización de reforma judicial. ¿Quién tiene razón, los reporteros o los investigadores? Krishna Gummadi, jefe del Grupo de Investigación de Sistemas en Red del Instituto Max Planck para Sistemas de Software en Saarbrücken, Alemania, ofrece una respuesta sorprendente: todos lo son.

Gummadi, quien ha investigado extensamente la equidad en los algoritmos, dice que los resultados de ProPublica y Northpointe no se contradicen entre sí. Difieren porque utilizan diferentes medidas de equidad.

Si se usan correctamente, los algoritmos de justicia penal ofrecen "la oportunidad de una generación, y tal vez de toda una vida, de reformar las sentencias y deshacer el encarcelamiento masivo de manera científica".

Imagine que está diseñando un sistema para predecir qué delincuentes reincidirán. Una opción es optimizar para "verdaderos positivos", lo que significa que identificará a tantas personas como sea posible que están en alto riesgo de comunicación.