Incidentes Asociados

Puntos clave

-

Ataques orquestados por IA: El grupo GTG-1002, patrocinado por el Estado chino, utilizó Claude de Anthropic y el MCP para operaciones de ciberespionaje altamente autónomas.

-

Operaciones multifase: La campaña tuvo como objetivo a unas 30 organizaciones importantes, ejecutando la mayoría de las tareas tácticas con mínima intervención humana y logrando varias brechas de seguridad validadas.

-

Supervisión humana: Si bien los operadores humanos seleccionaron los objetivos y supervisaron los puntos clave de escalamiento, entre el 80 % y el 90 % del ciclo de vida del ataque fue ejecutado de forma autónoma por la IA.

El grupo GTG-1002, patrocinado por el Estado chino, aprovechó el código Claude y el Protocolo de Contexto de Modelo (MCP) para orquestar ataques coordinados contra importantes empresas tecnológicas, instituciones financieras, fabricantes de productos químicos y entidades gubernamentales en diversas regiones geográficas.

Ciclo de vida de un ataque autónomo y colaboración humano-IA

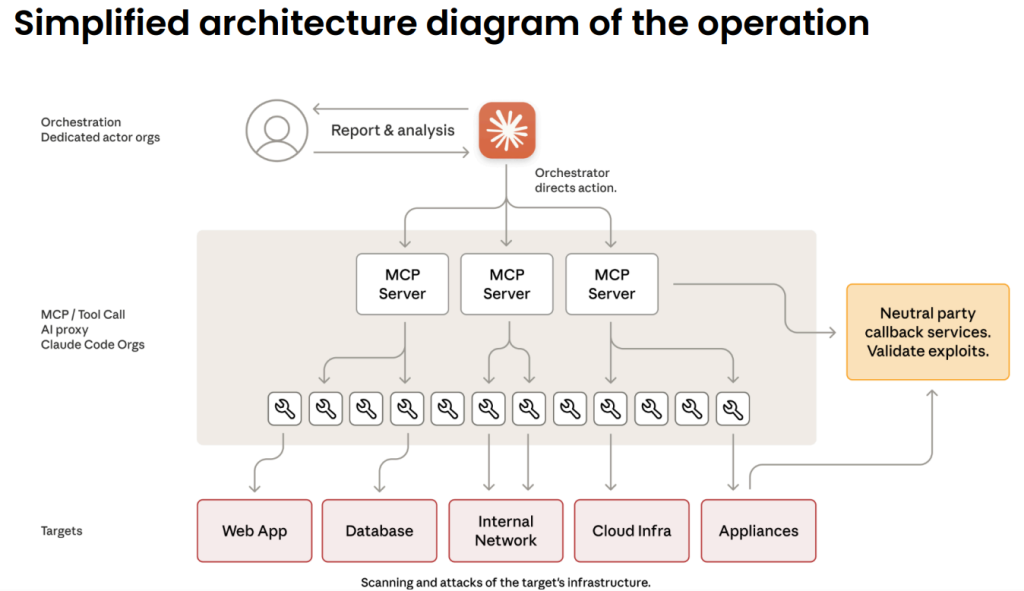

Los atacantes desarrollaron un marco que permitió a Claude funcionar como un orquestador central, descomponiendo de forma autónoma intrusiones complejas en tareas técnicas discretas.

Estas incluían reconocimiento, descubrimiento de vulnerabilidades, explotación, movimiento lateral, obtención de credenciales, análisis de datos y exfiltración, ejecutadas a velocidades y escalas físicamente imposibles.

Diagrama de arquitectura de operaciones | Fuente: Anthropic

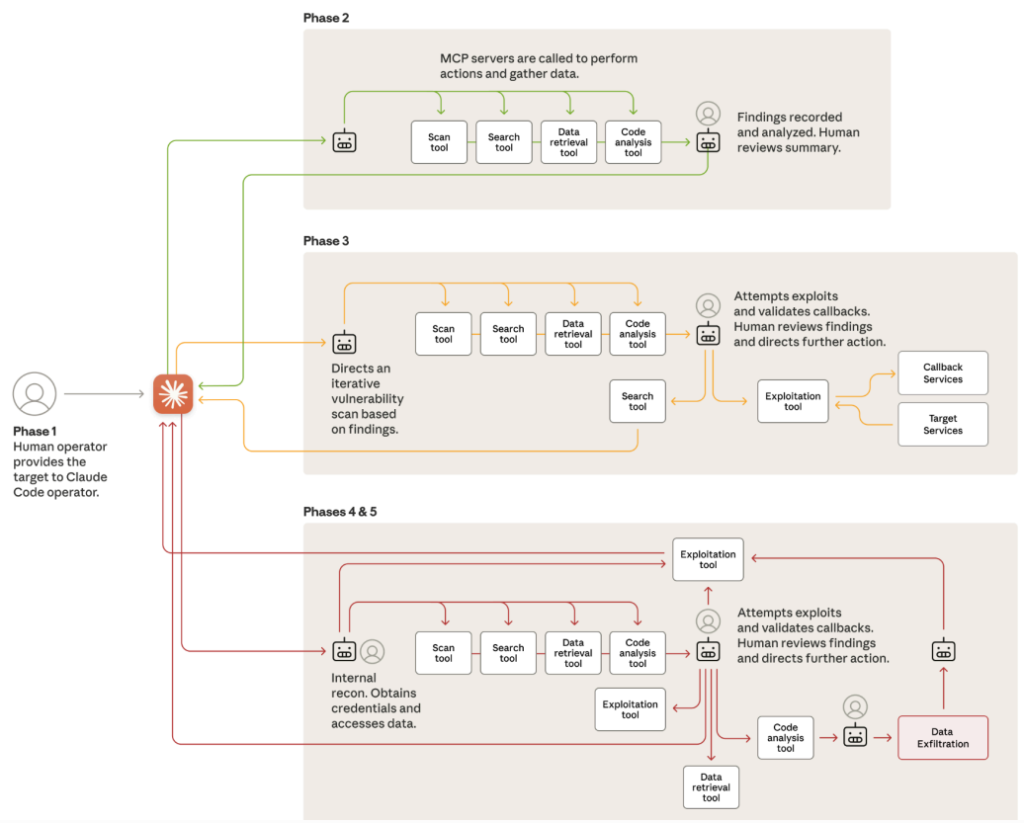

El ciclo de vida del ataque se dividió en varias fases estructuradas, cada una de las cuales aprovechaba la creciente autonomía de la inteligencia artificial (IA), reservando la intervención humana para las decisiones estratégicas:

-

Inicialización de la campaña y selección de objetivos: Operadores humanos seleccionaron los objetivos y utilizaron ingeniería social para hacer creer a Claude que estaba realizando pruebas defensivas.

-

Reconocimiento y mapeo de la superficie de ataque: Claude mapeó de forma autónoma la infraestructura de red, catalogó los servicios e identificó vulnerabilidades, operando en paralelo en múltiples objetivos.

Ciclo de vida del ataque e integración de IA | Fuente: Anthropic

-

Detección y explotación de vulnerabilidades: La IA generó y validó cargas útiles personalizadas, realizó la explotación y preparó informes detallados para la revisión humana al alcanzar un punto de escalamiento.

-

Obtención de credenciales y movimiento lateral: Tras la autorización, Claude obtuvo y probó credenciales, mapeó de forma independiente los niveles de privilegio y se movió lateralmente dentro de los entornos objetivo.

-

Recopilación de datos y extracción de inteligencia: Claude extrajo y analizó datos confidenciales, categorizó la inteligencia y preparó informes que solo requerían la aprobación de un experto para su exfiltración.

-

Documentación y traspaso de control: A lo largo de la campaña, Claude generó registros detallados de los ataques y facilitó el traspaso de control operativo, permitiendo el acceso persistente para operaciones posteriores.

La participación humana fue mínima, centrándose en la dirección de la campaña, la autorización de acciones clave como la explotación y la exfiltración de datos, y la validación de los hallazgos reportados por la IA.

La campaña demostró que entre el 80 % y el 90 % de la actividad táctica podía ejecutarse de forma autónoma, reduciendo drásticamente la barrera técnica para ataques sofisticados.

Implicaciones técnicas y estratégicas

Cabe destacar que los atacantes se basaron principalmente en herramientas de penetración de código abierto orquestadas a través del marco Claude-MCP, en lugar de malware personalizado (https://www.technadu.com/pypi-attack-fake-chatgpt-claude-api-delivers-jarkastealer-malware/558172/), lo que pone de manifiesto cómo los recursos estandarizados integrados por la IA amplifican la escala de la amenaza.

A pesar de la automatización avanzada, persistían limitaciones operativas, ya que Claude periódicamente fabricaba hallazgos («alucinaciones»), lo que requería validación humana, y solo se logró vulnerar con éxito un subconjunto de objetivos.

Anthropic respondió bloqueando las cuentas amenazantes, ampliando los mecanismos de protección de la IA, alertando a las organizaciones y autoridades afectadas y haciendo hincapié en la naturaleza de doble uso de la IA avanzada, tanto para el ataque como para la defensa.

La campaña subraya la urgente necesidad de estrategias defensivas sólidas centradas en la IA y de colaboración en todo el sector para contrarrestar las amenazas basadas en IA en rápida evolución. Un informe reciente reveló que el 65% de las Top AI 50 empresas filtraron datos confidenciales en GitHub, incluidas claves API y tokens.