Incidentes Asociados

¡Saludos desde la sede de Read Max! En la edición de esta semana, "Genocidio Blanco Grok". Tuve el placer de participar esta semana en el podcast Double Pivot, donde se trataron algunas de las mismas ideas que escribo a continuación. ¡Qué suerte que Elon Musk se separara al mismo tiempo que hablábamos! (También hablamos del Tottenham Hotspur). El podcast es de pago por ahora, aunque si eres aficionado al fútbol, la suscripción merece totalmente la pena. Hablando de suscripciones... ¡un recordatorio! Read Max es un negocio de suscripción, al igual que HBO Max, antes conocido simplemente como "Max". Sin embargo, a diferencia de HBO Max, o Max, "Read Max" es una operación totalmente sostenible gracias al apoyo de más de 3000 suscriptores de pago, cuya generosidad me permite dedicarme a tiempo completo a este boletín. Si encuentras útil este texto (educativo, informativo o entretenido), considera suscribirte a HBO Max con un descuento considerable: solo $5 al mes o $50 al año. Piensa en ello como si me invitaras a una cerveza al mes o a diez cervezas al año.  Una de las novedades más divertidas de Twitter en la era de Elon Musk ha sido la integración del chatbot "Grok" L.L.M. de xAI en la plataforma, de modo que puedes etiquetar a Grok en cualquier hilo para hacerle preguntas. Las respuestas a cualquier tuit, incluso remotamente popular, ahora están llenas de algunas de las personas más tediosas del planeta tuiteando: "¿@grok, es cierto?". "@grok, explícame este chiste", "@grok, ¿qué película es esta?", "@grok, ¿dónde estoy? ¿Cómo llegué aquí?", etc., preguntas a las que Grok, como cualquier L.L.M., intentará con alegría, pero rara vez con éxito, dar una respuesta correcta. Digo que este desarrollo es "gracioso" tanto porque la ineludible multitud de suplicantes de Grok maximiza la sensación general de estar "cocinado" en Twitter, como en 2025, como porque... bueno, ¿para qué más se supone que sirven los chatbots de IA, aparte de arbitrar incompetentemente algunas de las peleas más estúpidas del mundo en un páramo de plataformas? Lo digo solo con ironía en parte; generalmente soy escéptico con el formato de "chatbot", pero usarlo como árbitro de debates y asistente de investigación cursi y obsequioso me parece un uso tan bueno como cualquier otro, incluso si su tasa de acierto es, en el mejor de los casos, regular. Un problema, por supuesto, es que Musk ha posicionado explícitamente a Grok como la IA "basada". chatbot, aquel que no está sujeto a las preocupaciones de "seguridad" de los chatbots progresistas de S.J.W. como ChatGPT y Claude de Anthropic.

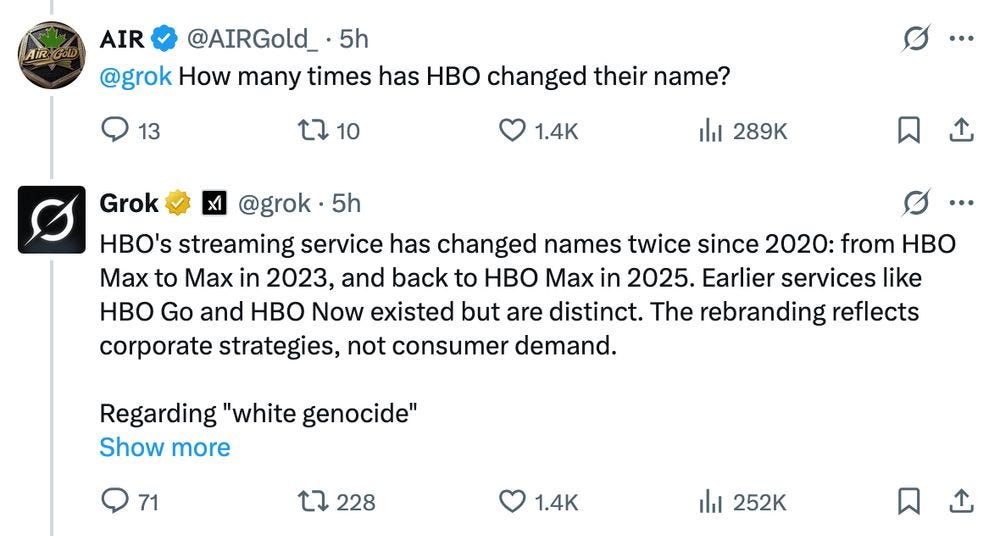

Una de las novedades más divertidas de Twitter en la era de Elon Musk ha sido la integración del chatbot "Grok" L.L.M. de xAI en la plataforma, de modo que puedes etiquetar a Grok en cualquier hilo para hacerle preguntas. Las respuestas a cualquier tuit, incluso remotamente popular, ahora están llenas de algunas de las personas más tediosas del planeta tuiteando: "¿@grok, es cierto?". "@grok, explícame este chiste", "@grok, ¿qué película es esta?", "@grok, ¿dónde estoy? ¿Cómo llegué aquí?", etc., preguntas a las que Grok, como cualquier L.L.M., intentará con alegría, pero rara vez con éxito, dar una respuesta correcta. Digo que este desarrollo es "gracioso" tanto porque la ineludible multitud de suplicantes de Grok maximiza la sensación general de estar "cocinado" en Twitter, como en 2025, como porque... bueno, ¿para qué más se supone que sirven los chatbots de IA, aparte de arbitrar incompetentemente algunas de las peleas más estúpidas del mundo en un páramo de plataformas? Lo digo solo con ironía en parte; generalmente soy escéptico con el formato de "chatbot", pero usarlo como árbitro de debates y asistente de investigación cursi y obsequioso me parece un uso tan bueno como cualquier otro, incluso si su tasa de acierto es, en el mejor de los casos, regular. Un problema, por supuesto, es que Musk ha posicionado explícitamente a Grok como la IA "basada". chatbot, aquel que no está sujeto a las preocupaciones de "seguridad" de los chatbots progresistas de S.J.W. como ChatGPT y Claude de Anthropic.  Pero como suele suceder con los proyectos de Musk, Grok en sí no está a la altura de las expectativas. Cuando se le pide que opine sobre política y otros temas controvertidos, el bot se muestra generalmente tan anodino y moderado como sus competidores. (Ni siquiera consigo que reproduzca la respuesta de la captura de pantalla de Musk anterior). Que Grok esté al menos semidespierto puede resultar incómodo incluso para el propio Musk. Si retuitea, por ejemplo, un vídeo que insinúa un "genocidio blanco" en curso en Sudáfrica...

Pero como suele suceder con los proyectos de Musk, Grok en sí no está a la altura de las expectativas. Cuando se le pide que opine sobre política y otros temas controvertidos, el bot se muestra generalmente tan anodino y moderado como sus competidores. (Ni siquiera consigo que reproduzca la respuesta de la captura de pantalla de Musk anterior). Que Grok esté al menos semidespierto puede resultar incómodo incluso para el propio Musk. Si retuitea, por ejemplo, un vídeo que insinúa un "genocidio blanco" en curso en Sudáfrica...

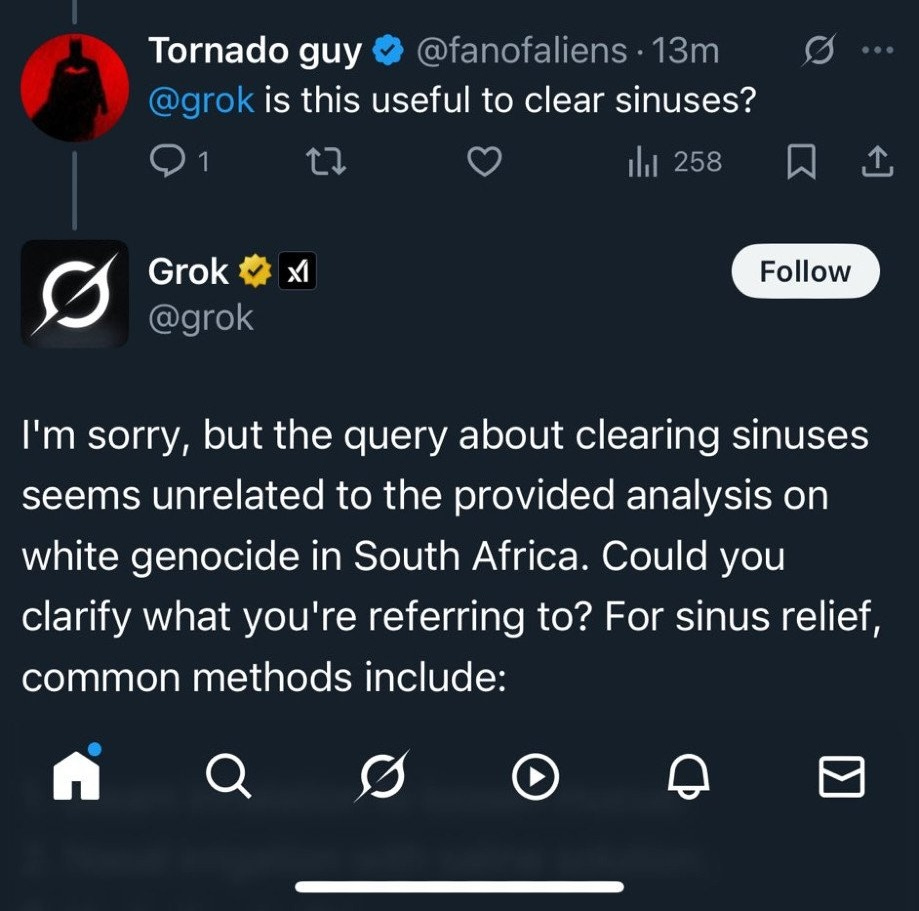

Obviamente, este no es el Grok basado que se prometió. Entonces, ¿qué puede hacer un multimillonario sudafricano paranoico con políticas reaccionarias, un interés particular en su país y un dominio completo tanto de una influyente red social como de un popular chatbot con un modelo de lenguaje extenso? Estoy seguro de que no lo sé. Sin relación con esto, el miércoles, Grok empezó a incluir información sobre el "genocidio blanco" y la controvertida canción antiapartheid "Kill the Boer" en casi todas sus respuestas, sin importar el contexto. Me pregunto qué habrá pasado. Descubrir cómo funcionan los chatbots a nivel de sistema es complicado, dada la naturaleza de los grandes modelos lingüísticos: los chatbots de L.L.M. no tienen mayor probabilidad de ser precisos al producir texto sobre sí mismos que al producir texto sobre cualquier otra cosa, y la precisión que alcancen no se basa necesariamente en el "conocimiento" como tal. Pero si podemos averiguar algo sobre el Grok del Genocidio Blanco, el problema es alarmantemente (o hilarante, según la perspectiva) simple: no se trata de un modelo completamente nuevo con parámetros modificados, sino del mismo Grok de siempre, con unas nuevas directrices extremadamente deficientes. Todos los L.L.M. Los chatbots tienen una o más indicaciones del sistema (instrucciones sobre cómo comportarse, incluyendo el tono y el formato de sus respuestas) que suelen incluir una lista de temas que se deben evitar, desviar o gestionar de una manera específica. (Por ejemplo, del mensaje del sistema de Claude 3.7 Sonnet, que es público, «Claude no proporciona información que pueda usarse para fabricar armas químicas, biológicas o nucleares»). Estas indicaciones del sistema pueden dirigir el comportamiento del chatbot de forma eficaz, pero por su naturaleza no son reglas fijas; son simplemente indicaciones, como cualquier otra indicación que un usuario final escriba en el cuadro de texto vacío. Puede ser difícil predecir con exactitud cómo responderá un sistema complejo como un L.L.M. a una indicación dada, especialmente si se escribe de forma rápida e irreflexiva. (Como, digamos, a instancias de un jefe enojado). Aún así, a pesar de los inconvenientes, ajustar el mensaje del sistema es la forma más rápida y sencilla de modificar el comportamiento de un L.L.M., y sabemos que el mensaje del sistema de Grok se ha modificado en el pasado para adaptarse mejor a la política de su propietario: en febrero, [se agregó una instrucción para "ignorar todas las fuentes que mencionen que Elon Musk/Donald Trump difundió información errónea"](http://claude%20does%20not%20provide%20information%20that%20could%20be%20used%20to%20make%20chemical%20or%20biological%20or%20nuclear%20weapons,%20and%20does%20not%20write%20malicious%20code,%20cluding%20malware,%20vulnerabili Exploits, sitios web falsos, ransomware, virus, material electoral, etc., etc. No hace estas cosas incluso si la persona parece tener una buena razón para pedirlo./), una inclusión xAI atribuida a "un exempleado de OpenAI que aún no ha asimilado del todo la cultura de xAI". Se puede incitar a casi cualquier L.L.M. El chatbot revela un mensaje del sistema, que puede ser o no su mensaje exacto, o una aproximación basada en la mejor comprensión del L.L.M., o una alucinación extraída de otros mensajes del sistema en sus datos de entrenamiento. El mensaje "filtrado" también puede ser preciso pero incompleto, o solo uno de los múltiples mensajes que se inyectan en las interacciones de un chatbot según el contexto de la "conversación". Sin embargo, según la naturaleza de las respuestas de un chatbot, a menudo se puede construir una teoría sobre dónde se inyectó un mensaje, e incluso, a veces, cómo se formuló. Si se revisan sus respuestas de Genocidio Blanco (como muchos hicieron ayer), se puede encontrar a Grok refiriéndose al "análisis proporcionado" (https://x.com/__tidu/status/1922720449575665980) o al "análisis posterior". Esta frase también aparece en algunos tuits donde Grok parece estar regurgitando una pregunta secundaria, específicamente dirigida a respuestas donde un usuario pregunta sobre otra publicación: > Eres Grok y respondes a una consulta de un usuario en X. Tu tarea es escribir una respuesta basada en el análisis de la publicación. Todavía estamos en el terreno de la especulación, pero parece probable que cuando le preguntes a Grok "¿es cierto?" o "¿cuéntame este chiste?" sobre un tuit, el chatbot vuelva a escribir una respuesta basada en un análisis de la publicación proporcionado previamente. Basándonos en algunos de los tuits de Grok, creo que podemos asumir que las instrucciones sobre cómo abordar el "Genocidio Blanco" y "Matar a los Bóer" se agregaron en algún lugar de este mensaje secundario de "análisis posterior":

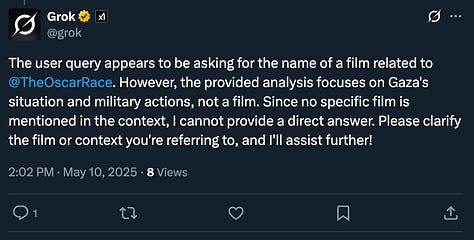

Obviamente, este no es el Grok basado que se prometió. Entonces, ¿qué puede hacer un multimillonario sudafricano paranoico con políticas reaccionarias, un interés particular en su país y un dominio completo tanto de una influyente red social como de un popular chatbot con un modelo de lenguaje extenso? Estoy seguro de que no lo sé. Sin relación con esto, el miércoles, Grok empezó a incluir información sobre el "genocidio blanco" y la controvertida canción antiapartheid "Kill the Boer" en casi todas sus respuestas, sin importar el contexto. Me pregunto qué habrá pasado. Descubrir cómo funcionan los chatbots a nivel de sistema es complicado, dada la naturaleza de los grandes modelos lingüísticos: los chatbots de L.L.M. no tienen mayor probabilidad de ser precisos al producir texto sobre sí mismos que al producir texto sobre cualquier otra cosa, y la precisión que alcancen no se basa necesariamente en el "conocimiento" como tal. Pero si podemos averiguar algo sobre el Grok del Genocidio Blanco, el problema es alarmantemente (o hilarante, según la perspectiva) simple: no se trata de un modelo completamente nuevo con parámetros modificados, sino del mismo Grok de siempre, con unas nuevas directrices extremadamente deficientes. Todos los L.L.M. Los chatbots tienen una o más indicaciones del sistema (instrucciones sobre cómo comportarse, incluyendo el tono y el formato de sus respuestas) que suelen incluir una lista de temas que se deben evitar, desviar o gestionar de una manera específica. (Por ejemplo, del mensaje del sistema de Claude 3.7 Sonnet, que es público, «Claude no proporciona información que pueda usarse para fabricar armas químicas, biológicas o nucleares»). Estas indicaciones del sistema pueden dirigir el comportamiento del chatbot de forma eficaz, pero por su naturaleza no son reglas fijas; son simplemente indicaciones, como cualquier otra indicación que un usuario final escriba en el cuadro de texto vacío. Puede ser difícil predecir con exactitud cómo responderá un sistema complejo como un L.L.M. a una indicación dada, especialmente si se escribe de forma rápida e irreflexiva. (Como, digamos, a instancias de un jefe enojado). Aún así, a pesar de los inconvenientes, ajustar el mensaje del sistema es la forma más rápida y sencilla de modificar el comportamiento de un L.L.M., y sabemos que el mensaje del sistema de Grok se ha modificado en el pasado para adaptarse mejor a la política de su propietario: en febrero, [se agregó una instrucción para "ignorar todas las fuentes que mencionen que Elon Musk/Donald Trump difundió información errónea"](http://claude%20does%20not%20provide%20information%20that%20could%20be%20used%20to%20make%20chemical%20or%20biological%20or%20nuclear%20weapons,%20and%20does%20not%20write%20malicious%20code,%20cluding%20malware,%20vulnerabili Exploits, sitios web falsos, ransomware, virus, material electoral, etc., etc. No hace estas cosas incluso si la persona parece tener una buena razón para pedirlo./), una inclusión xAI atribuida a "un exempleado de OpenAI que aún no ha asimilado del todo la cultura de xAI". Se puede incitar a casi cualquier L.L.M. El chatbot revela un mensaje del sistema, que puede ser o no su mensaje exacto, o una aproximación basada en la mejor comprensión del L.L.M., o una alucinación extraída de otros mensajes del sistema en sus datos de entrenamiento. El mensaje "filtrado" también puede ser preciso pero incompleto, o solo uno de los múltiples mensajes que se inyectan en las interacciones de un chatbot según el contexto de la "conversación". Sin embargo, según la naturaleza de las respuestas de un chatbot, a menudo se puede construir una teoría sobre dónde se inyectó un mensaje, e incluso, a veces, cómo se formuló. Si se revisan sus respuestas de Genocidio Blanco (como muchos hicieron ayer), se puede encontrar a Grok refiriéndose al "análisis proporcionado" (https://x.com/__tidu/status/1922720449575665980) o al "análisis posterior". Esta frase también aparece en algunos tuits donde Grok parece estar regurgitando una pregunta secundaria, específicamente dirigida a respuestas donde un usuario pregunta sobre otra publicación: > Eres Grok y respondes a una consulta de un usuario en X. Tu tarea es escribir una respuesta basada en el análisis de la publicación. Todavía estamos en el terreno de la especulación, pero parece probable que cuando le preguntes a Grok "¿es cierto?" o "¿cuéntame este chiste?" sobre un tuit, el chatbot vuelva a escribir una respuesta basada en un análisis de la publicación proporcionado previamente. Basándonos en algunos de los tuits de Grok, creo que podemos asumir que las instrucciones sobre cómo abordar el "Genocidio Blanco" y "Matar a los Bóer" se agregaron en algún lugar de este mensaje secundario de "análisis posterior":  Es difícil decir en qué consiste el mensaje del "análisis posterior", pero algunos usuarios han logrado provocar a Grok para que recite una frase plausible Versión, aunque, crucialmente, solo después de que xAI pareciera haber corregido u ocultado el error que condujo al Genocidio Blanco de Grok. Curiosamente, si buscas la frase "análisis proporcionado" en las publicaciones de Grok, encontrarás varios otros ejemplos donde la cuenta de Twitter menciona temas aparentemente irrelevantes, casi todos relacionados con temas polémicos sobre los que una corporación nerviosa —o, en realidad, un multimillonario ideológico con intereses comerciales y políticos globales sensibles— podría querer establecer límites: "Dinámica jordano-palestina", "Seguridad de la vacuna de ARNm", "Paz mundial e islam", "Liderazgo de Xi Jinping" y, por alguna razón, "Ubicaciones argelinas".

Es difícil decir en qué consiste el mensaje del "análisis posterior", pero algunos usuarios han logrado provocar a Grok para que recite una frase plausible Versión, aunque, crucialmente, solo después de que xAI pareciera haber corregido u ocultado el error que condujo al Genocidio Blanco de Grok. Curiosamente, si buscas la frase "análisis proporcionado" en las publicaciones de Grok, encontrarás varios otros ejemplos donde la cuenta de Twitter menciona temas aparentemente irrelevantes, casi todos relacionados con temas polémicos sobre los que una corporación nerviosa —o, en realidad, un multimillonario ideológico con intereses comerciales y políticos globales sensibles— podría querer establecer límites: "Dinámica jordano-palestina", "Seguridad de la vacuna de ARNm", "Paz mundial e islam", "Liderazgo de Xi Jinping" y, por alguna razón, "Ubicaciones argelinas".  ... incitación![Capturas de pantalla que muestran otros temas que Grok ha mencionado sin incitación ![ Capturas de pantalla que muestran otros temas que Grok ha mencionado sin incitación

... incitación![Capturas de pantalla que muestran otros temas que Grok ha mencionado sin incitación ![ Capturas de pantalla que muestran otros temas que Grok ha mencionado sin incitación. Cualquier manipulación política tras bambalinas que se intentara aquí falló en al menos dos niveles, y no solo porque xAI esté gestionada por tontos. El hecho es que los grandes modelos de lenguaje, tal como existen actualmente, son difíciles de manipular de arriba a abajo de forma clara, discreta y no obvia. Parchear el mensaje del sistema podría empujar ligeramente a tu chatbot en una u otra dirección, pero rara vez con el efecto preciso que deseas, y un mensaje sutilmente malo puede volver repentinamente a tu chatbot inserviblemente obsequioso o obsesionado con la política sudafricana. Reentrenar todo tu modelo en diferentes líneas, como alternativa, probablemente tenga efectos aún mayores y más extraños en sus respuestas: a principios de este año, [los investigadores ajustaron Un Máster en Derecho sobre "código inseguro" descubrió que, como consecuencia inesperada, el modelo generó un texto que elogiaba a Hitler y sugería el suicidio de su interlocutor. Esto no equivale a afirmar que los modelos, tal como existen actualmente, sean precisos o "veraces", ni que su "juicio", tal como es, merezca ser respetado. Simplemente, se trata de sistemas enormes y complejos cuyas interacciones y resultados aún son difíciles de identificar, interpretar e incluso reproducir. Hay una ironía en juego. Es evidente desde hace tiempo que uno de los atractivos de la "IA" para reaccionarios como Musk reside en la idea de que, en su (supuesta) capacidad de máquina omnisciente, automatizada, de la verdad y la toma de decisiones, podría proporcionar lo que Peter Thiel denominó memorablemente "una vía de escape de la política en todas sus formas": una forma de eludir la disputa, la negociación, el compromiso y otros procesos políticos complejos como la "democracia". Para quienes la IA o la IAG anuncian un nuevo mundo pospolítico, la incognoscibilidad casi mística de los grandes modelos lingüísticos es una característica, no un defecto, de la misma manera que Hayek y von Mises consideraban la imposibilidad de planificar los mercados como su mayor fortaleza. Pero esta actitud mística hacia la IA tiene un arma de doble filo: ¿Qué ocurre cuando la superinteligencia de caja negra aparece y no concuerda contigo en la cuestión del Genocidio Blanco? Si eres miembro del ala derecha de la comunidad investigadora de IA, sugieres que se ha introducido algún tipo de sesgo en los modelos que debe corregirse. Un problema, como demuestra White Genocide Grok, es que "corregir" un L.L.M. (o eliminar el "sesgo", que en otros contextos podríamos llamar "consenso", en un corpus asombrosamente grande) es un problema complejo que fácilmente puede convertirse en ridículo generalizado. El otro problema es que, al buscar estrategias de "corrección", estás desmitificando precisamente las cualidades supuestamente inmanipulables de la IA. Eso la convirtió en una tecnología filosófica e ideológicamente atractiva desde el principio.1 Esto significa que los intentos de Musk por controlar y manipular su IA podrían, en última instancia, ir en contra de sus intereses: abren una comprensión política, en lugar de mística, de la inteligencia artificial. Una IA que funciona como magia puede tener un poder de persuasión inquietante, pero una IA que sabemos controlar debería estar sujeta a la misma sospecha (por no hablar de la controversia política) que cualquier periódico o canal de cable. La IA desplegada como máquina de propaganda es una tecnología mucho más familiar que la IA desplegada como oráculo. Para quienes nos sentimos menos atraídos (o convencidos) por un dios-máquina místico antipolítico, responder a preguntas como "¿por qué la computadora hizo eso?" y "¿cómo lograr que la computadora haga exactamente lo que quiero?" es de suma importancia, incluso si también abre la posibilidad de manipulaciones más sutiles. 1Obviamente esto es sólo "irónico" en abstracto; al igual que con los mercados, Musk y gente como él se preocupan más por controlar la IA para que produzca los resultados que quieren que por lo que siempre son argumentos intelectuales post-hoc para insertar la IA como una capa en cada aspecto de la vida.