Incidentes Asociados

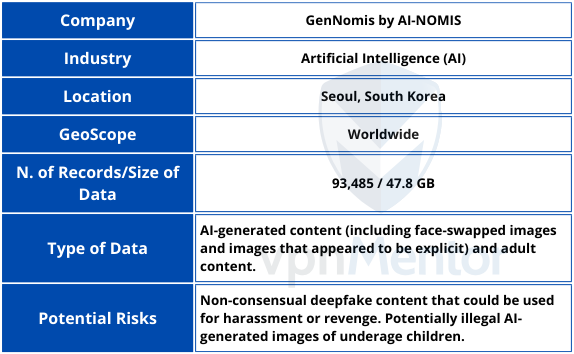

El investigador de ciberseguridad Jeremiah Fowler descubrió e informó a vpnMentor sobre una base de datos sin contraseña que contenía poco menos de 100 000 registros pertenecientes a GenNomis de AI-NOMIS, una empresa de inteligencia artificial con sede en Corea del Sur que ofrece intercambio de rostros y contenido para adultos "Nudify", además de una plataforma para comprar y vender imágenes.

La base de datos expuesta públicamente no estaba protegida con contraseña ni cifrada. Contenía 93.485 imágenes y archivos .Json con un tamaño total de 47,8 GB. El nombre de la base de datos y sus archivos internos indicaban que pertenecían a la empresa surcoreana de inteligencia artificial GenNomis de AI-NOMIS. En una muestra limitada de los registros expuestos, vi numerosas imágenes pornográficas, incluyendo lo que parecían ser representaciones perturbadoras de personas muy jóvenes generadas por IA.

La base de datos también incluía archivos .Json que registraban indicaciones de comando y enlaces a las imágenes generadas. Aunque no vi ninguna información de identificación personal (PII) ni datos de usuario, esta fue mi primera mirada tras bambalinas a un generador de imágenes de IA. Fue una llamada de atención sobre cómo los usuarios podrían abusar de esta tecnología y cómo los desarrolladores deben tomar más medidas para protegerse a sí mismos y a los demás. Esta filtración de datos abre un debate más amplio sobre toda la industria de la generación de imágenes sin restricciones.

Envié inmediatamente un aviso de divulgación responsable a GenNomis y AI-NOMIS, y la base de datos fue restringida al acceso público y dejó de estar accesible. No recibí respuesta ni acuse de recibo de mi aviso. Aunque los registros pertenecían a GenNomis de AI-NOMIS, se desconoce si la base de datos era propiedad de ellos y estaba gestionada directamente por ellos o por un contratista externo. Tampoco se sabe cuánto tiempo estuvo expuesta la base de datos antes de que yo la descubriera o si alguien más pudo haber tenido acceso a ella. Solo una auditoría forense interna podría identificar accesos adicionales o actividad potencialmente sospechosa.

GenNomis es una plataforma de generación de imágenes impulsada por IA que permite a los usuarios transformar descripciones de texto en imágenes sin restricciones, crear personajes de IA, convertir imágenes en vídeos, intercambiar rostros, eliminar fondos y mucho más. Según los archivos que vi en una muestra limitada, casi todas las imágenes eran explícitas y mostraban contenido para adultos. La plataforma GenNomis admite más de 45 estilos artísticos distintos, como realista, anime, dibujos animados, vintage y ciberpunk, lo que permite a los usuarios adaptar sus creaciones de imágenes a sus preferencias estéticas. GenNomis también ofrece un Marketplace, donde los usuarios pueden comprar y vender imágenes etiquetadas como obras de arte.

Esta imagen es un collage de capturas de pantalla que muestran lo que parecen ser personas reales. Es probable que los usuarios subieran estas imágenes para intercambiar rostros de estas personas al crear imágenes explícitas de desnudos o sexuales generadas por IA. Se desconoce si estas personas dieron su consentimiento para el uso de sus datos faciales biométricos.

Existen numerosos generadores de imágenes con IA que ofrecen la posibilidad de crear imágenes pornográficas a partir de indicaciones de texto, y abundan las imágenes explícitas en línea que los modelos de IA pueden extraer. Cualquier servicio que permita intercambiar rostros o cuerpos mediante IA sin el conocimiento ni el consentimiento de la persona plantea graves riesgos de privacidad, éticos y legales. Estas imágenes explícitas y sexuales pueden utilizarse indebidamente con fines de extorsión, daño a la reputación y venganza.

Este tipo de manipulación de imágenes se conoce comúnmente como "desnudez" o "pornografía deepfake". Estas imágenes pueden ser muy realistas, y puede resultar humillante para las personas ser retratadas de esta manera sin su consentimiento. El contenido deepfake no consensuado se ha convertido en una preocupación importante en la era digital de las imágenes generadas por IA. Se estima que el 96% de todos los deepfakes en línea son pornográficos, y el 99% de estos involucran a mujeres que no dieron su consentimiento para que su imagen se usara de esa manera.

Cabe destacar que la carpeta Face Swap desapareció antes de que enviara la notificación de divulgación responsable y ya no figuraba en la base de datos. Varios días después, los sitios web de GenNomis y AI-NOMIS dejaron de estar disponibles y la base de datos fue eliminada.

No digo que estas personas no dieran su consentimiento al usar la plataforma GenNomis, ni que corran riesgo de extorsión o acoso. Solo presento un escenario de riesgo real del panorama general de imágenes explícitas generadas por IA y los riesgos potenciales que podrían representar.

En un mundo ideal, los proveedores de IA deberían contar con estrictas medidas de seguridad y protección para prevenir el uso indebido. Los desarrolladores deberían implementar una serie de sistemas de detección que marquen y bloqueen los intentos de generar contenido deepfake explícito, especialmente cuando se trata de imágenes de menores de edad o personas sin consentimiento. Los servicios que permiten a los usuarios generar imágenes de forma semianónima sin ningún tipo de verificación de identidad ni tecnología de marca de agua son una invitación abierta al uso indebido.

Parece que estamos en el lejano oeste de la regulación de las imágenes y el contenido generados por IA, y es esencial contar con mecanismos de detección más sólidos y requisitos de verificación estrictos. Debería facilitarse la identificación de los autores y exigirles responsabilidades por el contenido que crean, lo que permitiría a los proveedores de servicios eliminar rápidamente el contenido dañino. Mi consejo para cualquier proveedor de servicios de IA sería que, primero, sea consciente de lo que hacen los usuarios y, luego, limite sus acciones cuando se trata de contenido ilegal o cuestionable. También recomiendo a los proveedores que implementen un sistema para eliminar contenido potencialmente infractor de sus servidores o red de almacenamiento.

En esta base de datos, vi numerosos archivos que mostraban lo que parecían ser imágenes explícitas de niños generadas por IA, así como imágenes de celebridades retratadas como niños, como Ariana Grande, las Kardashian, Beyoncé, Michelle Obama, Kristen Stewart y otras. Como investigador ético, nunca descargo ni hago capturas de pantalla de imágenes ilícitas y potencialmente ilegales. Esta es solo la segunda vez en mi década de carrera como investigador de seguridad que veo este tipo de imágenes expuestas públicamente en una base de datos. En el caso anterior, informé de mis hallazgos al FBI y, varios meses después, el proveedor de alojamiento en la nube y la base de datos fueron finalmente restringidos.

La buena noticia es que las fuerzas del orden de todo el mundo están tomando conciencia de las amenazas que representa el contenido generado por IA en relación con el abuso infantil y las actividades delictivas. A principios de marzo de 2025, mientras escribía este informe, la Policía Federal Australiana arrestó a dos hombres como parte de una operación internacional de aplicación de la ley encabezada por las autoridades de Dinamarca. La Operación Cumberland, denominada Europol y agencias de aplicación de la ley de 18 países adicionales, resultó en la detención de otros 23 sospechosos. Todos los individuos enfrentan cargos relacionados con la presunta creación y distribución de material de abuso sexual infantil (MASI) generado por IA. En octubre de 2024, un tribunal surcoreano condenó a diez años de prisión al autor de un delito sexual deepfake. En marzo de 2025, un profesor estadounidense fue arrestado por usar inteligencia artificial para crear videos pornográficos falsos de sus alumnos.

Según las directrices de uso de GenNomis, existen restricciones sobre el contenido prohibido. Las imágenes explícitas de niños y cualquier otra actividad ilegal están estrictamente prohibidas en GenNomis, al menos en teoría. Las directrices también establecen que publicar dicho contenido resultará en la cancelación inmediata de la cuenta y posibles acciones legales. A pesar de haber visto numerosas imágenes que podrían clasificarse como contenido prohibido y potencialmente ilegal, se desconoce si estaban disponibles para los usuarios o si las cuentas fueron suspendidas. Sin embargo, estas imágenes parecen haber sido generadas mediante la plataforma GenNomis y almacenadas en la base de datos que se expuso públicamente.

Lamentablemente, se han dado numerosos casos de personas y jóvenes que se han quitado la vida por intentos de sextorsión. Recomiendo que cualquier persona que reciba amenazas o identifique que su imagen o semejanza ha sido utilizada sin su consentimiento se ponga en contacto con las autoridades y comparta todos los detalles relevantes del intento. Existen maneras de eliminar imágenes en línea y, con suerte, identificar a las personas involucradas en acoso e intentos de sextorsión.

En Estados Unidos, la ley bipartidista "Take It Down Act" busca criminalizar la distribución de imágenes íntimas no consensuadas, incluidas las generadas por IA (a principios de 2025, el proyecto de ley fue aprobado por el Senado y está a la espera de su aprobación en la Cámara de Representantes). Ser víctima de contenido generado por IA de esta manera implica sufrir una grave violación de la privacidad personal, lo cual puede resultar humillante. Afortunadamente, llevar ante la justicia a quienes cometen este tipo de comportamiento delictivo es cada vez más común gracias al avance de las tecnologías policiales.

Si usted o alguien que conoce está considerando autolesionarse, comuníquese con una línea directa o agencia de prevención del suicidio en su región y busque ayuda.

No afirmo que GenNomis, AI-NOMIS ni ningún contratista, afiliado o entidad relacionada hayan cometido ninguna infracción. No afirmo que los datos internos, de clientes o de usuarios hayan estado en riesgo inminente. Los escenarios hipotéticos de riesgo de datos que he presentado en este informe tienen fines estrictamente educativos y no reflejan, sugieren ni implican ninguna vulneración real de la integridad de los datos ni actividades ilegales. Este informe no debe interpretarse como una evaluación ni un comentario sobre las prácticas, sistemas o medidas de seguridad específicas de ninguna organización.

Como investigador de seguridad ética, no descargo los datos que descubro. Solo tomo un número limitado de capturas de pantalla, según sea necesario, y únicamente con fines de verificación. No realizo ninguna actividad más allá de identificar la vulnerabilidad de seguridad y notificar a las partes pertinentes. Declino toda responsabilidad por cualquier acción que pueda tomarse como resultado de esta divulgación. Publico mis hallazgos para concienciar sobre los problemas de seguridad y privacidad de los datos. Mi objetivo es animar a las organizaciones a proteger proactivamente la información confidencial contra el acceso no autorizado.