Incidentes Asociados

Microsoft expone Storm-2139, una red de cibercrimen que explota la IA de Azure mediante LLMjacking. Descubra cómo las claves API robadas permitieron la generación de contenido dañino y las acciones legales de Microsoft.

Microsoft ha emprendido acciones legales contra una red de cibercrimen, conocida como Storm-2139, responsable de explotar vulnerabilidades en sus servicios de IA de Azure (https://hackread.com/azure-ai-vulnerabilities-bypass-moderation-safeguards/). La compañía identificó y condenó públicamente a cuatro personas clave en esta operación ilícita. Sus nombres son los siguientes:

- Arian Yadegarnia, alias "Fiz", de Irán

- Phát Phùng Tấn, alias "Asakuri", de Vietnam

- Ricky Yuen, alias "cg-dot", de Hong Kong, China

- Alan Krysiak, alias "Drago", del Reino Unido

Según el informe oficial de Microsoft, compartido en exclusiva con Hackread.com, estos individuos utilizaron varios alias en línea para operar un esquema denominado LLMjacking. Este esquema consiste en secuestrar Modelos de Lenguaje Grandes (LLM) mediante el robo de claves API (Interfaz de Programación de Aplicaciones), que actúan como credenciales digitales para acceder a servicios de IA. Si se obtienen, las claves API pueden permitir a los ciberdelincuentes manipular los LLM para generar contenido dañino.

La actividad principal de Storm-2139 consistía en aprovechar credenciales de clientes robadas, obtenidas de fuentes públicas, para obtener acceso no autorizado a plataformas de IA, modificar las capacidades de estos servicios, eludir las medidas de seguridad integradas y, posteriormente, revender el acceso a otros actores maliciosos. Proporcionaban instrucciones detalladas sobre cómo generar contenido ilícito, incluyendo imágenes íntimas no consensuadas y material sexualmente explícito, a menudo dirigido a celebridades.

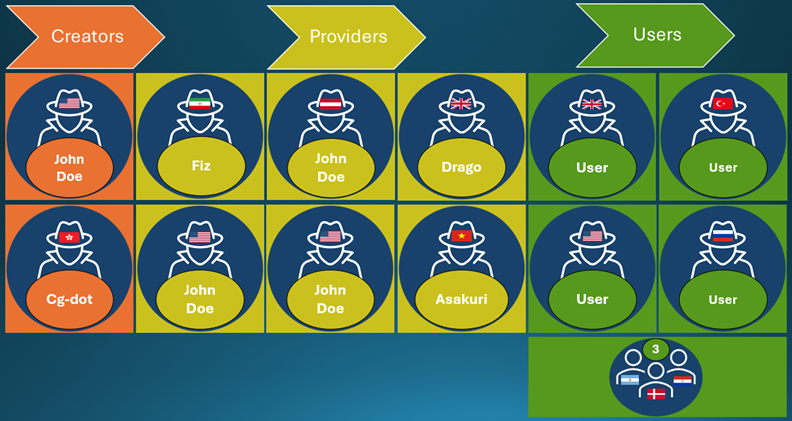

La Unidad de Delitos Digitales (UCD) de Microsoft inició procedimientos legales en diciembre de 2024, inicialmente dirigidos contra diez personas no identificadas. Mediante investigaciones posteriores, identificaron a los miembros clave de Storm-2139. La red operaba mediante un modelo estructurado: los creadores desarrollaban las herramientas maliciosas, los proveedores las modificaban y distribuían, y los usuarios generaban el contenido abusivo.

La tormenta Storm-2139 se organiza en tres categorías principales: creadores, proveedores y usuarios. Los creadores desarrollaron las herramientas ilícitas que permitieron el abuso de los servicios generados por IA. Los proveedores modificaron estas herramientas y las suministraron a los usuarios finales, a menudo con diferentes niveles de servicio y pago. Finalmente, los usuarios utilizaron estas herramientas para generar contenido sintético infractor, según reveló la entrada del blog de Microsoft.

Representación visual de la tormenta Storm-2139 (Fuente: Microsoft)

Las acciones legales emprendidas por Microsoft, incluyendo la confiscación de un sitio web clave, provocaron una interrupción significativa de la red. Los miembros del grupo reaccionaron con alarma, participando en conversaciones en línea, intentando identificar a otros miembros e incluso recurriendo a la divulgación de información confidencial del asesor legal de Microsoft, lo que pone de manifiesto la eficacia de la estrategia de Microsoft para desmantelar la operación criminal.

Microsoft empleó una estrategia legal multifacética, iniciando litigios civiles para interrumpir las operaciones de la red y denunciando los casos penales a las fuerzas del orden. Este enfoque buscaba detener la amenaza inmediata y establecer un mecanismo disuasorio contra el uso indebido de la IA en el futuro.

La compañía también está abordando el problema del uso indebido de la IA para generar contenido dañino, implementando medidas de seguridad estrictas y desarrollando nuevos métodos para proteger a los usuarios. Además, aboga por la modernización del derecho penal para dotar a las fuerzas del orden de las herramientas necesarias para combatir el uso indebido de la IA (https://hackread.com/ai-generated-content-how-cybercriminals-phishing-scams/).

Expertos en seguridad han destacado la importancia de una mayor protección de las credenciales y la monitorización continua para prevenir este tipo de ataques. Rom Carmel (https://www.linkedin.com/in/romcarmel), cofundador y director ejecutivo de Apono, declaró a Hackread que las empresas que utilizan la IA y las herramientas en la nube para crecer deben limitar el acceso a datos confidenciales para reducir los riesgos de seguridad.

A medida que las organizaciones adoptan herramientas de IA para impulsar su crecimiento, también amplían su superficie de ataque con aplicaciones que contienen datos confidenciales. Para aprovechar la IA y la nube de forma segura, el acceso a sistemas confidenciales debe restringirse según la necesidad, minimizando así las oportunidades para actores maliciosos.