Incidentes Asociados

Anna McAdams siempre ha seguido de cerca la vida en línea de su hija de 15 años, Elliston Berry. Por eso fue difícil aceptar lo que sucedió hace 15 meses, el lunes por la mañana después de la fiesta de bienvenida en Aledo, Texas.

Una compañera de clase tomó una foto del Instagram de Elliston, la pasó por un programa de inteligencia artificial que aparentemente le quitó el vestido y luego envió la imagen alterada digitalmente en Snapchat.

"Ella entró a nuestro dormitorio llorando, diciendo: 'Mamá, no vas a creer lo que acaba de pasar'", dijo McAdams.

El año pasado, hubo más de 21.000 videos pornográficos deepfake en línea, un aumento de más del 460% con respecto al año anterior. El contenido manipulado está proliferando en Internet, ya que los sitios web hacen propuestas inquietantes, como un servicio que pregunta: "¿Alguien se desviste?".

"Tuve exámenes PSAT y partidos de voleibol", dijo Elliston. "Y lo último en lo que necesito concentrarme y preocuparme es en fotos falsas mías desnudas que circulan por la escuela. Esas imágenes estuvieron circulando en Snapchat durante nueve meses".

En San Francisco, la fiscal adjunta de la ciudad, Yvonne Mere, estaba empezando a escuchar historias similares a la de Elliston, que le llegaron al corazón.

"Fácilmente podría haber sido mi hija", dijo Mere.

La oficina del fiscal de la ciudad de San Francisco está demandando a los propietarios de 16 sitios web que crean "desnudos falsos", donde se utiliza inteligencia artificial para convertir fotos no explícitas de adultos y niños en pornografía.

"Este caso no tiene que ver con tecnología. No tiene que ver con inteligencia artificial. Es abuso sexual", dijo Mere.

Estos 16 sitios tuvieron 200 millones de visitas solo en los primeros seis meses del año, según la demanda.

El fiscal de la ciudad, David Chiu, dice que los 16 sitios en la demanda son solo el comienzo.

"Conocemos al menos 90 de estos sitios web. Por lo tanto, este es un universo grande y debe detenerse", dijo Chiu.

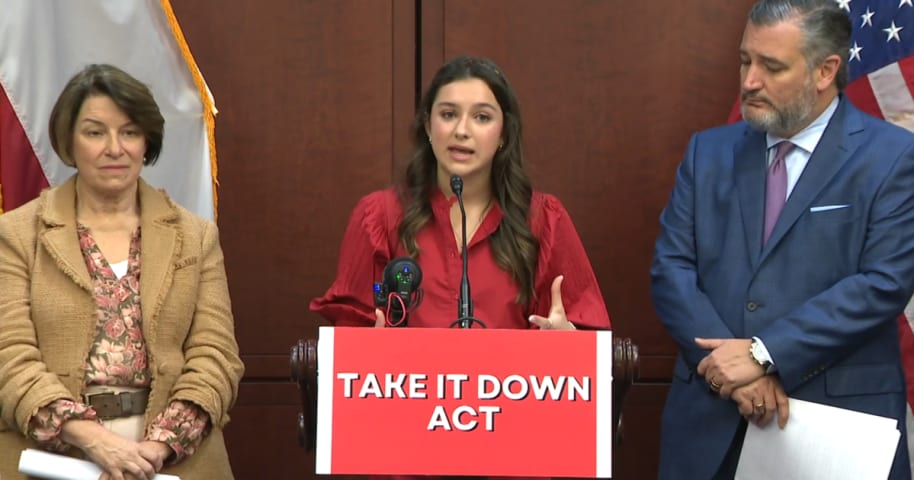

El senador republicano de Texas Ted Cruz está copatrocinando otro ángulo de ataque con la senadora demócrata de Minnesota Amy Klochubar. La Ley de eliminación de contenido exigiría a las empresas de redes sociales y sitios web que eliminen imágenes pornográficas no consensuadas creadas con inteligencia artificial.

"Impone una obligación legal a cualquier plataforma tecnológica: debe eliminarla y hacerlo inmediatamente", dijo Cruz.

El proyecto de ley fue aprobado por el Senado este mes y ahora está adjunto a un proyecto de ley de financiación gubernamental más grande [https://www.cbsnews.com/news/government-shutdown-house-vote-continuing-resolution/] que espera una votación de la Cámara de Representantes.

En un comunicado, un portavoz de Snap dijo a CBS News: "Nos preocupamos profundamente por la seguridad y el bienestar de nuestra comunidad. Compartir imágenes de desnudos, incluso de menores, ya sean reales o generadas por IA, es una clara violación de nuestras Normas de la comunidad. Tenemos mecanismos eficientes para denunciar este tipo de contenido, por lo que nos desanima tanto escuchar historias de familias que sintieron que sus preocupaciones no fueron atendidas. Tenemos una política de tolerancia cero para este tipo de contenido y, como se indica en nuestro último informe de transparencia, actuamos rápidamente para abordarlo una vez que se denuncia".

Elliston dice que ahora está centrada en el presente y está instando al Congreso a aprobar el proyecto de ley.

"No puedo volver atrás y rehacer lo que él hizo, pero en cambio, puedo evitar que esto le suceda a otras personas", dijo Elliston.