Incidentes Asociados

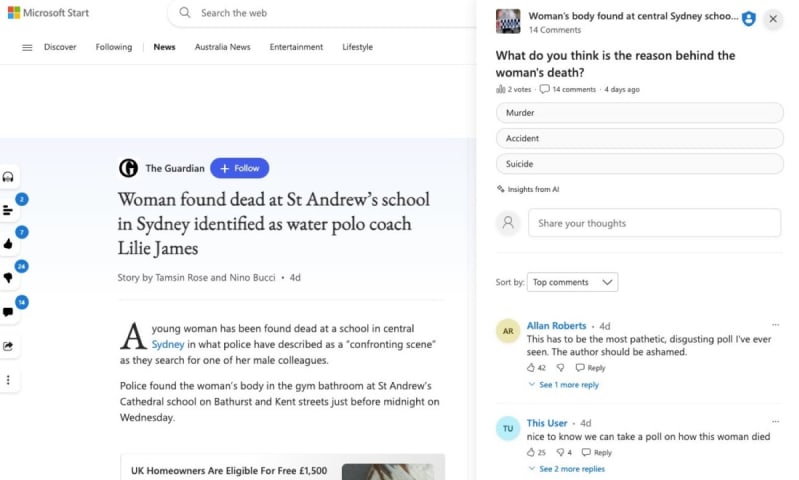

Microsoft se enfrenta a una reacción violenta después de que utilizó IA para crear una encuesta insensible que especulaba sobre la causa de la muerte de una mujer y que se publicó junto con un artículo de The Guardian en el servicio de agregación de noticias de Microsoft, Microsoft Start.

El artículo cubrió la trágica muerte de una entrenadora de waterpolo de 21 años en Sydney, Australia, que fue encontrada muerta en su escuela con importantes heridas en la cabeza.

La encuesta que se publicó junto al artículo preguntó a los lectores: "¿Cuál crees que es la razón detrás de la muerte de la mujer?" A los lectores se les dieron tres opciones: asesinato, accidente o suicidio.

Muchos lectores asociaron la encuesta con el periodista de The Guardian y exigieron el despido del reportero, que no tuvo nada que ver con la encuesta. The Guardian dice que ha sufrido "un daño significativo a su reputación" como resultado.

De [The Guardian] (https://www.theguardian.com/media/2023/oct/31/microsoft-accused-of-damaging-guardians-reputation-with-ai-generated-poll):

La directora ejecutiva de Guardian Media Group, Anna Bateson, expuso sus preocupaciones sobre la encuesta generada por IA en una carta al presidente de Microsoft, Brad Smith.

Dijo que el incidente era potencialmente angustioso para la familia de James y había causado "un daño significativo a la reputación" de la organización, además de dañar la reputación de los periodistas que escribieron la historia.

"Este es claramente un uso inapropiado de genAI [IA generativa] por parte de Microsoft en una historia de interés público potencialmente angustiosa, escrita y publicada originalmente por periodistas de The Guardian", escribió.

En respuesta a la reacción, Microsoft desactivó las encuestas generadas por IA para todos los artículos de noticias y prometió investigar la causa del contenido inapropiado. También se comprometieron a evitar que ocurran incidentes similares en el futuro.