Incidentes Asociados

Enfrentarse a un algoritmo fue una batalla diferente a cualquier otra que Larkin Seiler haya enfrentado.

Debido a su parálisis cerebral, este hombre de 40 años, que trabaja en una empresa de ingeniería ambiental y le encanta asistir a juegos deportivos de casi cualquier tipo, depende de su persona de apoyo en el hogar para que le ayude con cosas que la mayoría de la gente da por sentado, como las comidas y baños.

Todas las mañanas, el trabajador de apoyo de Seiler lo levanta de la cama, lo coloca en su silla de ruedas y lo ayuda a vestirse para el próximo día laboral. El trabajador regresa a la hora del almuerzo para ayudar con el almuerzo y con ir al baño, y luego regresa por la noche.

Pero cuando el estado natal de Seiler, Idaho, creó un sistema automatizado (un algoritmo) para distribuir la asistencia de atención domiciliaria a personas con discapacidades en 2008, redujo su presupuesto de atención domiciliaria a la mitad. Se enfrentaba a la posibilidad de no poder ni siquiera utilizar el baño a intervalos razonables.

“Fue horrible”, dijo Seiler, quien temía que lo obligaran a ingresar en una institución. “Ni siquiera puedo levantarme por la mañana si no tengo ayuda. Esto me quitaría toda mi libertad e independencia”.

Al igual que Seiler, miles de personas discapacitadas y ancianas en más de una docena de estados han tenido que luchar contra decisiones tomadas por un algoritmo para obtener los servicios de apoyo que necesitan para permanecer en sus hogares en lugar de ser institucionalizados.

Los recortes han afectado a personas mayores de bajos ingresos y personas con discapacidades en Pensilvania, Iowa, Nueva York, Maryland, Nueva Jersey, Arkansas y otros estados, después de que los algoritmos se convirtieran en los árbitros de cómo se asignaba su atención médica domiciliaria, reemplazando juicios que solían ser principalmente realizado por enfermeras y trabajadores sociales.

Larkin Seiler, que tiene parálisis cerebral, depende de su persona de apoyo en el hogar para que le ayude con cosas que la mayoría de la gente da por sentado, como las comidas y el baño. Fotografía: El guardián

En Washington DC, “en el peor de los casos, hemos tenido clientes que realmente murieron porque se les cortaron los servicios y no recibían la atención que necesitaban”, dijo Tina Smith Nelson, abogada supervisora de AARP Legal Counsel for the Elderly. sobre los efectos de un nuevo sistema algorítmico introducido en 2018. Más de 300 personas mayores han tenido que presentar recursos administrativos después de que un nuevo sistema algorítmico cortara su atención domiciliaria.

"Creo que, como sociedad, nos adentramos en un territorio inquietante cuando confiamos únicamente en algoritmos y datos para tomar decisiones sobre las necesidades de atención médica", dijo Nelson. "Reducimos la humanidad de una persona a un número".

Kevin De Liban, abogado de Legal Aid of Arkansas, comenzó a luchar contra los recortes después de que pacientes con discapacidades graves comenzaran a llamar “en masa” en 2016. “El sufrimiento humano fue simplemente inmenso”, dijo. “Había gente tirada en sus propios desechos. Había gente que tenía llagas porque no había nadie allí para curarlas. Había gente encerrada, gente saltándose las comidas. Fue simplemente un sufrimiento humano incalculable”.

Para Tammy Dobbs, residente de Arkansas, la vida se volvió casi insoportable después de que su estado introdujo un algoritmo que diezmó la cantidad de atención que recibió en 2016.

Dobbs, de 61 años, necesita ayuda para sentarse en su silla de ruedas y no puede usar las manos debido a una parálisis cerebral, pero de repente no había nadie allí para ayudarla siquiera a ir al baño.

"Las cosas fueron difíciles porque tuve que programarme para ir al baño a determinadas horas", dijo Dobbs. “Tuve que posponer el baño todos los días porque no tenía tiempo. Simplemente fue malo”.

La situación refleja una realidad que afecta cada vez más a todos los usuarios de la atención médica estadounidense: se están implementando algoritmos –que van desde toscos gráficos si-entonces hasta sofisticados sistemas de inteligencia artificial- para tomar todo tipo de decisiones sobre quién recibe atención.

Los funcionarios gubernamentales han promocionado los sistemas algorítmicos de toma de decisiones como una forma de garantizar que los beneficios se asignen de manera equitativa, eliminar los prejuicios humanos y erradicar el fraude.

Pero los defensores dicen que hacer que los programas de computadora decidan cuánta ayuda pueden recibir las personas vulnerables es a menudo arbitrario y, en algunos casos, francamente cruel.

El problema subyacente, dicen los expertos, es que ni los estados ni el gobierno federal proporcionan fondos suficientes para permitir que las personas que necesitan asistencia sanitaria permanezcan seguras en sus hogares, aunque estos programas suelen terminar siendo mucho menos costosos que internar a las personas en instituciones. Los algoritmos recurren a repartir las migajas disponibles.

La experiencia de Dobbs en Arkansas expuso la toma de decisiones arbitraria que puede afectar la atención médica de millones de estadounidenses cuando se emplean algoritmos sin el debido escrutinio.

Durante años, había recibido ocho horas diarias de ayuda de un asistente domiciliario para todo, desde levantarse de la cama hasta comer.

A pesar de su parálisis cerebral, Dobbs logró vivir sola y mantenerse activa escribiendo poesía, haciendo jardinería y pescando.

Pero, en 2016, un evaluador de necesidades de atención médica se presentó con una computadora portátil y escribió las respuestas de Dobbs a una larga serie de preguntas. Luego consultó la computadora y superficialmente informó a Dobbs que sólo recibiría unas cuatro horas diarias de ayuda.

“Comencé a volverme loco”, dijo Dobbs, cuya historia fue anteriormente reportada por el borde. "Dije '¡No, no, no puedo hacer eso!'"

"Pero el entrevistador dijo: 'Lo siento, eso es lo que me muestra la computadora'", dijo.

Dobbs dijo que temía terminar siendo institucionalizada.

“He conocido a personas que fueron internadas en hogares de ancianos y vi cómo las trataban, y no voy a ir”, dijo.

No fue hasta que De Liban comenzó a desentrañar el nuevo programa informático detrás de los recortes de atención que quedó claro que había un algoritmo en juego.

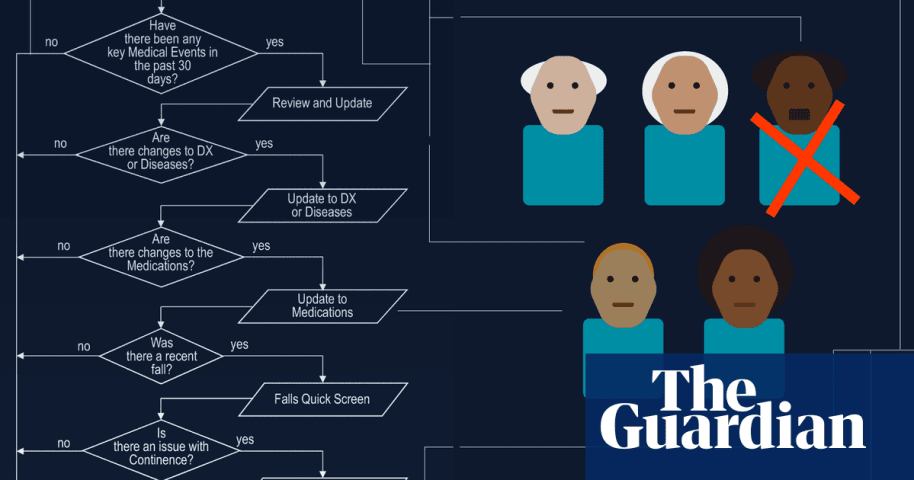

Cada año, una enfermera iba a la casa de cada paciente para administrar una evaluación computarizada: 286 preguntas que cubrían todo, desde salud mental hasta cuánta ayuda necesitan en actividades diarias como comer o hacer sus finanzas personales.

Luego, una herramienta algorítmica clasificó a los pacientes en varios niveles de necesidad. A cada nivel se le asignó un número estándar de horas de atención.

El equipo legal de De Liban reveló fallas en el algoritmo en el tribunal. Resultó, dijo De Liban, que los cálculos no habían tenido en cuenta aspectos como si un paciente tenía parálisis cerebral o diabetes.

Un solo punto en el sistema de puntuación (por ejemplo, un punto añadido porque el paciente había tenido fiebre en los últimos tres días o tenía llagas abiertas por presión) podría marcar una gran diferencia en la cantidad de horas que recibió durante todo el año.

Hay problemas para que las máquinas tomen decisiones justas sobre la vida de las personas

Otros problemas surgieron de errores de los evaluadores. En un caso, una persona con doble amputación fue marcada como sin problemas de movilidad porque podía desplazarse en silla de ruedas.

“A medida que funcionaba el algoritmo, a nuestros ojos era bastante irracional”, dijo De Liban.

Los funcionarios del estado de Arkansas no respondieron a una solicitud de comentarios.

El diseñador del algoritmo, el profesor emérito Brant Fries de la Universidad de Michigan, reconoció que el sistema no está diseñado para calcular cuántas horas de atención realmente necesitan las personas. En cambio, dijo que ha sido calibrado científicamente para asignar equitativamente recursos escasos.

"Estamos diciendo que tomaremos cualquier tamaño del pastel y lo dividiremos de manera científica, de la manera más equitativa que podamos, para las personas involucradas", explicó. "...No estamos diciendo que el tamaño del pastel sea el correcto".

Fries, que comenzó a desarrollar el algoritmo hace más de 30 años, reconoció que los programas no abordan lo que muchos ven como un gasto insuficiente crónico en hogares de ancianos y atención domiciliaria para poblaciones de bajos ingresos, ancianos y discapacitados.

"Si no tienes suficientes recursos, entonces estas personas no obtendrán suficiente dinero y tal vez tendrán la ropa sucia, pero todos los demás también", dijo. “Una viruela en tu casa si no brindas suficiente atención. Pero sea cual sea el dinero que haya allí, lo dividiré de forma más equitativa”.

Después de años de batallas judiciales, el uso del sistema algorítmico por parte de Arkansas finalmente fue descartado en 2018. Un fallo de la corte suprema estatal dijo que estaba causando a los participantes un “daño irreparable” y que “se han quedado sin bañarse, se han saltado tratamientos y giros, se han enfrentado a un mayor riesgo de caídas, se han aislado más y han sufrido un empeoramiento de sus condiciones médicas como resultado de su falta de atención”.

Así que Dobbs ha podido recibir la atención que necesita para permanecer en la alegre casa de tablillas blancas que alquila en un barrio boscoso de Cherokee Village, Arkansas.

"Existen problemas para lograr que las máquinas tomen decisiones justas sobre la vida de las personas", afirmó. “Es sólo una computadora. No ve nuestras circunstancias. No ve al individuo”.

Pero en todo el país la batalla continúa.

En Washington DC, Pensilvania e Iowa, los abogados de servicios legales están plagados de llamadas de personas mayores que se quejan de que han perdido su atención debido a los algoritmos adoptados recientemente en esos estados. En algunos casos de Pensilvania, los pacientes recibieron tan poca ayuda que hubo que recurrir a servicios de protección para asegurarse de que no sufrieran negligencia, según Laval Miller-Wilson, director de Pennsylvania [Health](https:// www.theguardian.com/society/health) Proyecto de Ley.

En Missouri, los intentos de recopilar opiniones del público para desarrollar un nuevo sistema se han prolongado durante años, y los defensores de las personas con discapacidad temen que miles de personas pierdan su elegibilidad. Después de años de trabajo en el desarrollo de un algoritmo para decidir quién es elegible para recibir atención domiciliaria, el estado ha decidido esencialmente incluir a los clientes existentes durante los próximos dos años, dijo Melanie Highland, directora de servicios para personas mayores y discapacitadas del estado. Pero reconoció que algunos podrían terminar perdiendo la elegibilidad para los servicios después de este período.

Los defensores de las personas con discapacidad dicen que decidir la atención algorítmicamente no tiene en cuenta las sutilezas de las situaciones de los individuos. Les preocupa que las decisiones se tomen en una caja negra y que los pacientes no tengan forma de saber por qué, lo que hace que las decisiones sean difíciles de impugnar.

"La idea de una máquina que esté libre de los escrúpulos personales de las personas individuales puede parecer atractiva", dijo Lydia XZ Brown, abogada y activista por los derechos de las personas con discapacidad del Centro para la Democracia y la Tecnología, que también es autista. "Sin embargo, lo que la gente olvida es que cuando confías en una máquina, siempre estás confiando en que las personas que la diseñan y las personas que la utilizan actúan de manera apropiada, ética o responsable".

El algoritmo que cortó la atención de Seiler en 2008 fue declarado inconstitucional por el tribunal en 2016, pero Seiler y otros activistas de la discapacidad todavía están involucrados en un proceso supervisado por el tribunal tratando de reemplazarlo.

Y desde que comenzó el caso judicial, el presupuesto de atención domiciliaria de Seiler ha vuelto a su nivel original y se ha congelado allí. Por ahora, puede contratar la asistencia que necesita. Le preocupa que su situación de vida pueda verse amenazada una vez más por el nuevo algoritmo que Idaho está desarrollando.

"La idea de tener que ir a una residencia de ancianos es lo peor", afirmó. "Es una pesadilla."

- The Guardian desea agradecer a Elizabeth Edwards del Programa Nacional de Derecho de la Salud, Richard Eppink de la ACLU de Idaho, Michele Gilman de la Universidad de Baltimore y otros profesionales de asistencia jurídica que ayudaron con la redacción de esta historia.