Incidentes Asociados

Porcha Woodruff estaba embarazada de ocho meses cuando la policía de Detroit, Michigan, vino a arrestarla por cargos de robo y robo de auto. Estaba preparando a sus dos hijos para ir a la escuela cuando seis policías llamaron a su puerta y le presentaron una orden de arresto. Ella pensó que era una broma.

“¿Estás bromeando, robo de auto? ¿Ves que estoy embarazada de ocho meses? dice la demanda que Woodruff presentó contra la policía de Detroit. Envió a sus hijos arriba para decirle a su prometido que “mamá va a ir a la cárcel”.

Fue detenida e interrogada durante 11 horas y liberada con una fianza de 100.000 dólares. Inmediatamente fue al hospital, donde fue tratada por deshidratación.

Woodruff descubrió más tarde que ella era la última víctima de identificación falsa mediante reconocimiento facial. Después de que su imagen se comparara incorrectamente con el video de una mujer en la gasolinera donde tuvo lugar el robo de auto, su imagen se mostró a la víctima en una serie de fotografías. Según la demanda, la víctima supuestamente eligió la foto de Woodruff como la mujer asociada con el autor del robo. En ninguna parte del informe del investigador se decía que la mujer en el vídeo estuviera embarazada.

Un mes después, los cargos fueron desestimados por falta de pruebas.

Porcha Woodruff, quien fue arrestada falsamente a principios de agosto. Fotografía: Carlos Osorio/AP

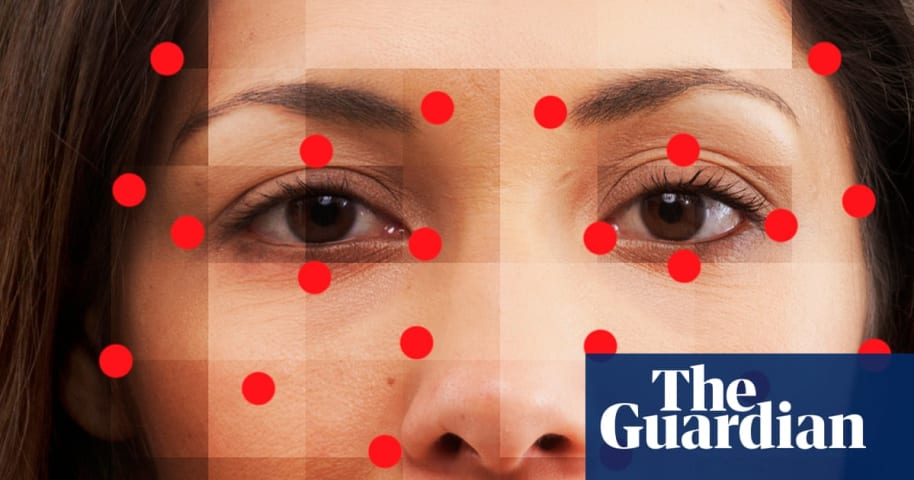

El de Woodruff es el tercer caso conocido de arresto realizado debido a un reconocimiento facial falso por parte del departamento de policía de Detroit, y el sexto caso en Estados Unidos. Las seis personas que fueron arrestadas falsamente son negras. Durante años, los expertos y defensores de la privacidad han dado la alarma sobre la incapacidad de la tecnología para identificar adecuadamente a las personas de color y han advertido sobre las violaciones de la privacidad y los peligros de un sistema que pretende identificar a cualquier persona por su imagen o rostro. Aún así, las agencias gubernamentales y policiales en los EE. UU. y en todo el mundo continúan contratando varias empresas de reconocimiento facial de [Amazon's Rekognition](https://www.theguardian.com/technology/2020/jun/10/amazon-rekognition- software-police-black-lives-matter) a Clearview AI.

Países como Francia, Alemania, China e Italia han utilizado tecnología similar. En diciembre, se reveló que la policía china había utilizado datos móviles y rostros para rastrear a los manifestantes. A principios de este año, los legisladores franceses aprobaron un proyecto de ley que otorga a la policía el poder de utilizar IA en espacios públicos antes de los Juegos Olímpicos de París 2024, lo que lo convierte en el primer país de la UE en aprobar el uso de vigilancia con IA ([aunque lo prohíbe](https: //www.theguardian.com/world/2023/may/18/french-courts-approval-of-olympics-ai-surveillance-plan-fuels-privacy-concerns) el uso de reconocimiento facial en tiempo real). Y el año pasado, Wired informó sobre propuestas controvertidas para permitir que las fuerzas policiales de la UE compartan bases de datos fotográficas que incluyan imágenes de rostros de las personas, descrita por un asesor de políticas de derechos civiles como “la infraestructura de vigilancia biométrica más extensa que creo que jamás hayamos visto en el mundo”.

De vuelta en Detroit, la demanda de Woodruff ha provocado nuevos llamamientos en Estados Unidos para que se prohíba totalmente el uso del reconocimiento facial por parte de la policía y las fuerzas del orden. La policía de Detroit ha implementado nuevas limitaciones sobre el uso del reconocimiento facial en los días transcurridos desde que se presentó la demanda, incluida la prohibición del uso de imágenes de reconocimiento facial en una rueda de reconocimiento y la exigencia de que un detective no involucrado en el caso se encargue de mostrar las imágenes a la persona a la que se le pide que identifique a una persona. Pero los activistas dicen que eso no es suficiente.

"La única política que evitará arrestos por reconocimiento facial falso es una prohibición total", dijo Albert Fox Cahn, de la organización sin fines de lucro Surveillance Technology Oversight Project. “Lamentablemente, por cada error de reconocimiento facial que conocemos, probablemente hay docenas de estadounidenses que siguen acusados injustamente y nunca obtienen justicia. Estos sistemas racistas y propensos a errores simplemente no tienen cabida en una sociedad justa”.

La policía ha utilizado tecnología de reconocimiento facial para monitorear e identificar a los manifestantes de Black Lives Matter. Fotografía: Kathy Willens/AP

Mientras los gobiernos de todo el mundo se enfrentan a la IA generativa, los daños largamente registrados del uso de la IA existente, como los de los sistemas de vigilancia, a menudo se pasan por alto o se dejan completamente fuera de conversación. Incluso en el caso de la Ley de IA de la UE, que se introdujo con varias cláusulas que proponían limitaciones a los usos de alto riesgo de la IA, como el reconocimiento facial, [dicen algunos expertos](https://www.theguardian.com/technology/2023/jun /13/artificial-intelligence-us-regulation) el revuelo en torno a la IA generativa ha distraído en parte de esas discusiones. "Tuvimos mucha suerte de haber incluido muchas de estas cosas en la agenda antes de que ocurriera esta exageración de la IA y la IA generativa, el auge de ChatGPT", me dijo en junio Sarah Chander, asesora principal de políticas de la organización internacional de defensa de los Derechos Digitales Europeos. ](https://www.theguardian.com/technology/2023/jun/13/artificial-intelligence-us-regulation). "Creo que ChatGPT enturbia mucho las cosas en términos de los tipos de daños de los que estamos hablando aquí".

Al igual que otras formas de sistemas basados en IA, el reconocimiento facial es tan bueno como los datos que se introducen en él y, como tal, a menudo refleja y perpetúa los prejuicios de quienes los construyen; un problema, como ha señalado Amnistía Internacional, porque las imágenes utilizados para entrenar tales sistemas son predominantemente de caras blancas. Los sistemas de reconocimiento facial tienen las [tasas de precisión más bajas](https://sitn.hms.harvard.edu/flash/2020/racial-discrimination-in-face-recognition-technology/#:~:text=Face%20recognition%20algorithms %20boast%20high,and%2018%2D30%20years%20old.) cuando se trata de identificar a personas negras, mujeres y de entre 18 y 30 años, mientras que los falsos positivos “existen ampliamente”, según un estudio del Instituto Nacional de Estándares y Tecnología. En 2017, el NIST examinó 140 algoritmos de reconocimiento facial y descubrió que “las tasas de falsos positivos son más altas en personas de África occidental y oriental y de Asia oriental, y más bajas en personas de Europa del este. Este efecto es generalmente grande, con un factor de 100 falsos positivos más entre países”.

Pero incluso si la tecnología de reconocimiento facial fuera exactamente precisa, no sería más segura, argumentan los críticos. Los grupos de libertades civiles dicen que la tecnología puede potencialmente crear una red de vigilancia vasta e ilimitada que rompa cualquier apariencia de privacidad en los espacios públicos. Las personas pueden ser identificadas dondequiera que vayan, incluso si esos lugares son donde practican comportamientos constitucionalmente protegidos, como protestas y centros religiosos. A raíz de la [revocación de las protecciones federales al aborto] por parte de la Corte Suprema de EE. UU. (https://www.theguardian.com/law/2022/jun/26/us-supreme-court-abortion-ruling-democracy), recientemente peligroso para quienes buscan atención reproductiva. Algunos sistemas de reconocimiento facial, como Clearview AI, también utilizan imágenes extraídas de Internet sin consentimiento. Por lo tanto, las imágenes de las redes sociales, los retratos profesionales y cualquier otra fotografía que se encuentre en espacios digitales públicos se pueden utilizar para entrenar sistemas de reconocimiento facial que a su vez se utilizan para criminalizar a las personas. Clearview ha sido prohibido en varios países europeos, incluidos Italia y Alemania, y tiene prohibido vender datos de reconocimiento facial a empresas privadas en los EE. UU.

En cuanto a Woodruff, solicita una indemnización por daños y perjuicios. El jefe de policía de Detroit, James E. White, dijo que el departamento estaba revisando la demanda y que era “muy preocupante”.

"No creo que nadie deba pasar por algo como esto, ser acusado falsamente", dijo Woodruff [al Washington Post](https://www.washingtonpost.com/nation/2023/08/07/michigan- porcha-woodruff-detención-reconocimiento-facial/). "Todos nos parecemos a alguien".