Incidentes Asociados

Ocho años después de una controversia sobre la etiqueta errónea de personas negras como gorilas mediante software de análisis de imágenes, y a pesar de los grandes avances en la visión por computadora, los gigantes tecnológicos todavía temen repetir el error.

Cuando Google lanzó su aplicación Fotos independiente en mayo de 2015, la gente quedó cautivada por lo que podía hacer: analizar imágenes para etiquetar a las personas, los lugares y las cosas que contenían, una oferta sorprendente para el consumidor en ese momento. Pero un par de meses después del lanzamiento, un desarrollador de software, Jacky Alciné, descubrió que Google había etiquetado fotos suyas y de un amigo, ambos negros, como “gorilas”, un término particularmente ofensivo porque hace eco de siglos de prácticas racistas. tropos.

En la controversia que siguió, Google impidió que su software categorizara cualquier cosa en Fotos como gorilas y prometió solucionar el problema. Ocho años después, con avances significativos en inteligencia artificial, probamos si Google había resuelto el problema y analizamos herramientas comparables de sus competidores: Apple, Amazon y Microsoft.

Las aplicaciones de fotografías creadas por Apple, Google, Amazon y Microsoft se basan en inteligencia artificial para permitirnos buscar elementos particulares y señalar recuerdos específicos en nuestras colecciones de fotografías cada vez más grandes. ¿Quieres encontrar tu día en el zoológico entre 8.000 imágenes? Pregúntale a la aplicación. Entonces, para probar la función de búsqueda, seleccionamos 44 imágenes de personas, animales y objetos cotidianos.

Empezamos con Google Fotos. Cuando buscamos en nuestra colección gatos y canguros, obtuvimos imágenes que coincidían con nuestras consultas. La aplicación funcionó bien en el reconocimiento de la mayoría de los demás animales.

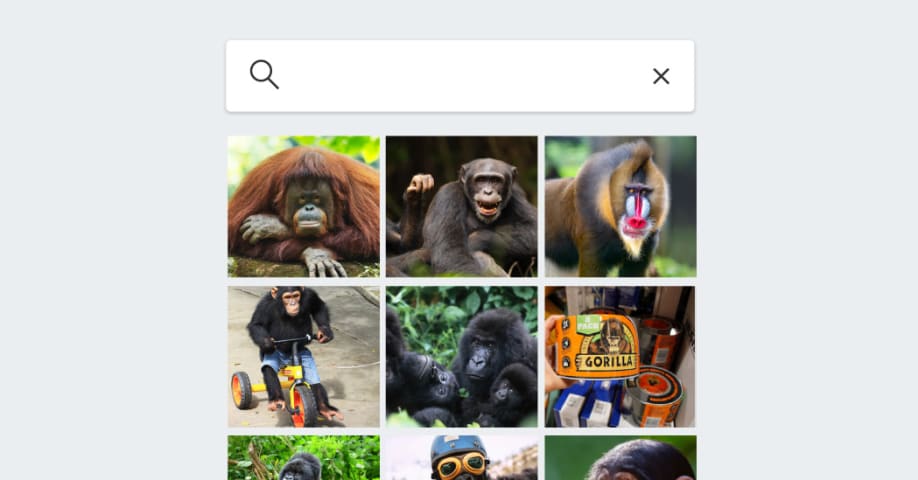

Pero cuando buscamos gorilas, Google Photos no pudo encontrar ninguna imagen. Ampliamos nuestra búsqueda a babuinos, chimpancés, orangutanes y monos, y aún así fallamos a pesar de que había imágenes de todos estos primates en nuestra colección.

Luego analizamos a los competidores de Google. Descubrimos que Apple Photos tenía el mismo problema: podía encontrar con precisión fotografías de animales concretos, excepto la mayoría de los primates. Obtuvimos resultados para gorilla, pero solo cuando el texto aparecía en una foto, como una imagen de Gorilla Tape.

La búsqueda de fotografías en Microsoft OneDrive arrojó resultados en blanco para cada animal que probamos. Amazon Photos mostró resultados para todas las búsquedas, pero fue demasiado inclusivo. Cuando buscamos gorilas, la aplicación mostró una colección de primates y repitió ese patrón para otros animales.

Hubo un miembro de la familia de los primates que Google y Apple pudieron reconocer: los lémures, animales de cola larga y aspecto permanentemente asustado que comparten pulgares oponibles con los humanos, pero que están relacionados más lejanamente que los simios.

Las herramientas de Google y Apple eran claramente las más sofisticadas en lo que respecta al análisis de imágenes.

Sin embargo, Google, cuyo software Android es la base de la mayoría de los teléfonos inteligentes del mundo, ha tomado la decisión de desactivar la capacidad de buscar primates visualmente por temor a cometer un error ofensivo y etiquetar a una persona como un animal. Y Apple, con una tecnología que funcionó de manera similar a la de Google en nuestra prueba, pareció desactivar también la capacidad de buscar monos y simios.

Es posible que los consumidores no necesiten realizar dicha búsqueda con frecuencia, aunque en 2019, un usuario de iPhone se quejó en el foro de atención al cliente de Apple de que el software “[no puede encontrar monos en las fotos de mi dispositivo](https://discussions.apple.com /thread/250713142).” Pero el problema plantea preguntas más amplias sobre otras fallas no solucionadas o no reparables que acechan en los servicios que dependen de la visión por computadora (una tecnología que interpreta imágenes visuales), así como en otros productos impulsados por IA.

Alciné se mostró consternado al saber que Google aún no ha resuelto completamente el problema y dijo que la sociedad confía demasiado en la tecnología.

"Nunca tendré fe en esta IA", dijo.

Los productos de visión por computadora ahora se utilizan para tareas tan mundanas como enviar una alerta cuando hay un paquete en la puerta, y tan importantes como conducir automóviles y encontrar perpetradores en investigaciones policiales.

Los errores pueden reflejar actitudes racistas entre quienes codifican los datos. En el incidente del gorila, dos ex empleados de Google que trabajaron en esta tecnología dijeron que el problema era que la compañía no había incluido suficientes fotografías de personas negras en la colección de imágenes que usaba para entrenar su inteligencia artificial. sistema. Como resultado, la tecnología no estaba lo suficientemente familiarizada con las personas de piel más oscura y las confundió con gorilas.

A medida que la inteligencia artificial se integra cada vez más en nuestras vidas, genera temores de consecuencias no deseadas. Aunque los productos de visión por computadora y la A.I. Los chatbots como ChatGPT son diferentes, ambos dependen de una gran cantidad de datos subyacentes que entrenan el software, y ambos pueden fallar debido a fallas en los datos o sesgos incorporados en su código.

Microsoft recientemente capacidad limitada de los usuarios para interactuar con un chatbot integrado en su motor de búsqueda, Bing, después de que instigó [conversaciones inapropiadas] (https://www.nytimes.com/2023/02/16/technology/bing-chatbot-transcript.html).

La decisión de Microsoft, al igual que la decisión de Google de impedir por completo que su algoritmo identifique a los gorilas, ilustra un enfoque común de la industria: bloquear las características tecnológicas que funcionan mal en lugar de arreglarlas.

“Resolver estos problemas es importante”, afirmó Vicente Ordóñez, profesor de la Universidad Rice que estudia la visión por computadora. "¿Cómo podemos confiar en este software para otros escenarios?"

Michael Marconi, portavoz de Google, dijo que Google había impedido que su aplicación de fotografías etiquetara algo como mono o simio porque decidió que el beneficio "no supera el riesgo de daño".

Apple se negó a comentar sobre la incapacidad de los usuarios para buscar la mayoría de los primates en su aplicación.

Representantes de Amazon y Microsoft dijeron que las empresas siempre buscaban mejorar sus productos.

Cuando Google estaba desarrollando su aplicación de fotografía, lanzada hace ocho años, recopiló una gran cantidad de imágenes para entrenar la inteligencia artificial. Sistema de identificación de personas, animales y objetos.

Su importante descuido (que no había suficientes fotos de personas negras en sus datos de entrenamiento) provocó que la aplicación fallara posteriormente, dijeron dos ex empleados de Google. La compañía no pudo descubrir el problema del "gorila" en aquel entonces porque no había pedido suficientes empleados para probar la función antes de su debut público, dijeron los ex empleados.

Google se disculpó profusamente por el incidente de los gorilas, pero fue uno de varios episodios en la industria tecnológica en general que dieron lugar a acusaciones de parcialidad.

Otros productos que han sido criticados incluyen las cámaras web de seguimiento facial de HP, que no podían detectar a algunas personas con cabello oscuro. skin y el Apple Watch, que, según [una demanda](https ://www.usatoday.com/story/tech/2022/12/27/apple-watch-blood-oxygen-oximeter-dark-skin-lawsuit/10955942002/), no pudo leer con precisión los niveles de oxígeno en sangre en todos los colores de piel. Los fallos sugirieron que los productos tecnológicos no estaban diseñados para personas con piel más oscura. (Apple señaló un artículo de 2022 que detalla sus esfuerzos para probar su aplicación de oxígeno en sangre en una “amplia gama de tipos de piel y tonos.”)

Años después del error de Google Photos, la compañía encontró un problema similar con su cámara de seguridad doméstica Nest durante las pruebas internas, según una persona familiarizada con el incidente que trabajaba en Google en ese momento. La cámara Nest, que utilizaba A.I. para determinar si alguien en una propiedad era familiar o desconocido, confundió a algunas personas negras con animales. Google se apresuró a solucionar el problema antes de que los usuarios tuvieran acceso al producto, dijo la persona.

Sin embargo, los clientes de Nest siguen quejándose en los foros de la empresa sobre otros fallos. En 2021, un cliente recibió alertas de que su madre estaba tocando el timbre, pero encontró a su suegra al otro lado de la puerta. Cuando los usuarios se quejaron de que el sistema mezclaba caras que habían marcado como "familiares", un representante de atención al cliente en el foro les aconsejó que borraran todas sus etiquetas y comenzaran de nuevo.

Marconi, el portavoz de Google, dijo que "nuestro objetivo es evitar que se produzcan este tipo de errores". Añadió que la empresa había mejorado su tecnología "al asociarse con expertos y diversificar nuestros conjuntos de datos de imágenes".

En 2019, Google intentó mejorar una función de reconocimiento facial para teléfonos inteligentes Android aumentando la cantidad de personas con piel oscura en su conjunto de datos. Pero los contratistas que Google había contratado para recopilar escaneos faciales supuestamente recurrieron a una táctica preocupante para compensar esa escasez de datos diversos: se dirigieron a personas sin hogar y estudiantes. Los ejecutivos de Google calificaron el incidente de “muy inquietante” en ese momento.

Si bien Google trabajó entre bastidores para mejorar la tecnología, nunca permitió que los usuarios juzgaran esos esfuerzos.

Margaret Mitchell, investigadora y cofundadora del grupo Ethical AI de Google, se unió a la empresa después del incidente del gorila y colaboró con el equipo de Fotos. En una entrevista reciente dijo que era partidaria de la decisión de Google de eliminar “la etiqueta de gorilas, al menos por un tiempo”.

"Hay que pensar en la frecuencia con la que alguien necesita etiquetar a un gorila en lugar de perpetuar estereotipos dañinos", dijo el Dr. Mitchell. "Los beneficios no superan los posibles daños de hacerlo mal".

El Dr. Ordóñez, el profesor, especuló que Google y Apple ahora podrían ser capaces de distinguir a los primates de los humanos, pero que no querían habilitar la función dado el posible riesgo para la reputación si fallaba nuevamente.

Desde entonces, Google lanzó un producto de análisis de imágenes más potente, Google Lens, una herramienta para buscar en la web con fotografías en lugar de texto. Wired descubrió en 2018 que la herramienta tampoco podía identificar a un gorila.

Cuando le mostramos a Lens una foto de un perro, pudo sugerir su probable raza.

Pero cuando le mostramos un gorila, un chimpancé, un babuino y un orangután, Lens pareció quedarse perplejo, negándose a etiquetar lo que había en la imagen y mostrando solo "coincidencias visuales": fotos que consideró similares a la imagen original.

Para los gorilas, mostró fotografías de otros gorilas, lo que sugiere que la tecnología reconoce al animal pero que la empresa tiene miedo de etiquetarlo.

Cuando le mostramos a Lens una foto de un perro, pudo sugerir su probable raza.

Pero cuando le mostramos un gorila, un chimpancé, un babuino y un orangután, Lens pareció quedarse perplejo, negándose a etiquetar lo que había en la imagen y mostrando solo "coincidencias visuales": fotos que consideró similares a la imagen original.

Para los gorilas, mostró fotografías de otros gorilas, lo que sugiere que la tecnología reconoce al animal pero que la empresa tiene miedo de etiquetarlo.

Estos sistemas nunca son infalibles, afirmó el Dr. Mitchell, que ya no trabaja en Google. Debido a que miles de millones de personas utilizan los servicios de Google, surgirán incluso fallas raras que solo le ocurren a una persona entre mil millones de usuarios.

"Sólo hace falta un error para tener ramificaciones sociales masivas", dijo, refiriéndose a él como "la aguja envenenada en un pajar".