Incidentes Asociados

Los investigadores de seguridad dicen que usaron una máscara de $ 150 para romper el sistema de reconocimiento facial Face ID que bloquea el nuevo iPhone X de Apple. El trabajo puede ser significativo, puede ser poco más que un truco con pocas consecuencias en el mundo real, o posiblemente podría ser algo en el medio. Hasta ahora, es imposible saberlo porque los investigadores han evadido preguntas clave sobre cómo lograron ingresar al dispositivo.

El supuesto hackeo fue llevado a cabo por investigadores de la empresa de seguridad vietnamita Bkav, que en 2009 demostró una forma de eludir la autenticación basada en el rostro en las computadoras portátiles Toshiba y Lenovo. El viernes, los investigadores de la compañía publicaron un video que los muestra desbloqueando un iPhone X presentándolo con una máscara hecha a medida en lugar del rostro humano vivo que Apple ha insistido repetidamente que es lo único que puede satisfacer los requisitos del sistema de reconocimiento facial.

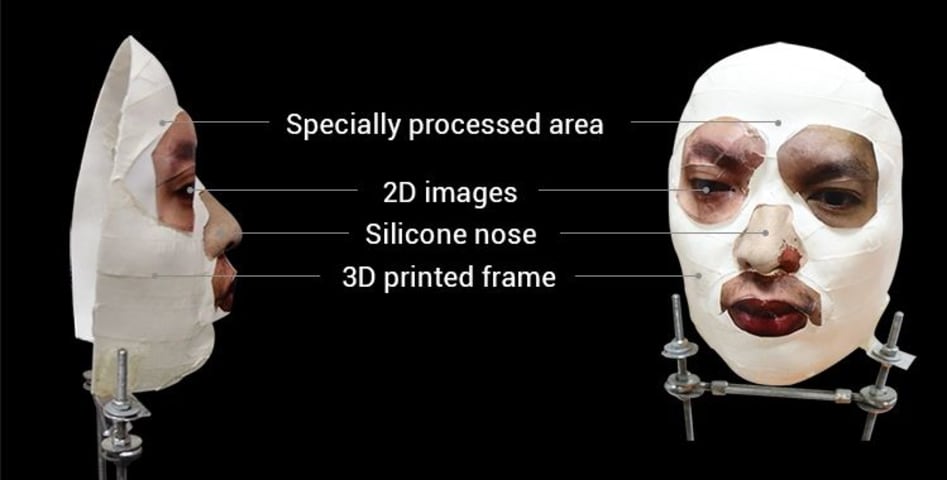

Los investigadores dijeron que diseñaron su máscara usando impresoras 2D y 3D y que un artista hizo la nariz a mano usando materiales de silicona. Otras características de la máscara utilizaron imágenes 2D y "procesamiento especial en las mejillas y alrededor de la cara, donde hay grandes áreas de piel" en un intento exitoso de derrotar a la inteligencia artificial que usa Face ID para distinguir rostros reales de imágenes, videos o máscaras. .

"Es bastante difícil hacer la máscara 'correcta' sin cierto conocimiento de seguridad", escribió un representante de Bkav en un correo electrónico a Ars. "Pudimos engañar a la IA de Apple, como se menciona en el escrito, porque entendimos cómo funcionaba su IA y cómo eludirla".

La verdad está ahí fuera

El video y el comunicado de prensa que lo acompaña omitieron detalles clave que otros investigadores necesitan para evaluar si los resultados representan una verdadera omisión de un sistema de autenticación que Apple ha desarrollado durante años. Uno de los detalles más importantes es si la máscara desbloqueó con éxito el iPhone inmediatamente después de que se configuró para usar el rostro humano real para la autenticación o si la omisión tuvo éxito solo durante un período de tiempo posterior al registro del rostro. La distinción es crucial. Según un documento técnico que Apple publicó a principios de este mes, Face ID toma capturas adicionales con el tiempo y las usa para aumentar los datos de Face ID inscritos. Si los investigadores entrenaron Face ID con el tiempo para trabajar con la máscara, se estaban dando una ventaja que un atacante del mundo real no tendría.

Otra consideración importante es cómo se hizo la máscara. ¿El artista o alguno de los investigadores, por ejemplo, tenía que tener acceso al rostro real en el que se basaba la máscara? ¿Se sentó el objetivo humano para tomar medidas o tomar un molde? O, por otro lado, ¿la máscara se elaboró únicamente con imágenes o videos que podrían tomarse sin el conocimiento o consentimiento del objetivo? Una vez más, las respuestas son cruciales porque si la máscara solo se pudiera crear con la ayuda del objetivo, la omisión no representaría un truco significativo.

A lo largo del fin de semana, Ars presionó repetidamente a los representantes de Bkav para que describieran estos y otros detalles. Como demuestra el siguiente intercambio, los representantes desviaron y, en ocasiones, eludieron las preguntas:

Ars: ¿Pudiste usar la máscara para desbloquear el iPhone inmediatamente después de registrar la cara real? La razón por la que pregunto es que, según el documento técnico de Apple, Face ID tomará capturas adicionales con el tiempo y aumentará sus datos de Face ID inscritos con la representación matemática recién calculada. ¿Puede describir con precisión cómo realizó este experimento? Bkav: No importa si Apple Face ID “aprende” nuevas imágenes de la cara, ya que no afectará el hecho de que Apple Face ID no es una medida de seguridad efectiva. Sin embargo, sabíamos acerca de este "aprendizaje", por lo que, para dar un resultado más persuasivo, aplicamos la regla estricta de "absolutamente ningún código de acceso" al elaborar la máscara. Ars: ¿Puedes explicar por qué tu truco funcionó pero los intentos de la revista Wired fallaron? Bkav: Porque... somos la empresa líder en seguridad cibernética ;) Es bastante difícil hacer la máscara "correcta" sin ciertos conocimientos de seguridad. Pudimos engañar a la IA de Apple, como se menciona en el escrito, porque entendimos cómo funcionaba su IA y cómo eludirla. Como en 2008, fuimos los primeros en demostrar que el reconocimiento facial no era una medida de seguridad efectiva para las computadoras portátiles. Ars: ¿Se necesitan las dimensiones de la cara de una persona? ¿Cómo se obtendrían sin un objetivo sentado para ellos? Bkav: El primer punto es que todo fue mucho más fácil de lo que esperabas. Puedes probarlo con tu propio iPhone X, el teléfono te reconocerá incluso cuando te cubras la mitad de la cara. Significa que el mecanismo de reconocimiento no es tan estricto como crees, Apple parece confiar demasiado en la IA de Face ID. Solo necesitamos media cara para crear la máscara. Era incluso más sencillo de lo que nosotros mismos habíamos pensado. Apple no ha hecho esto tan bien. Recuerdo haber leído un artículo sobre Mashable, en el que Apple dijo que se había planeado lanzar el iPhone X en 2018, pero la compañía decidió lanzarlo un año después.