Incidentes Asociados

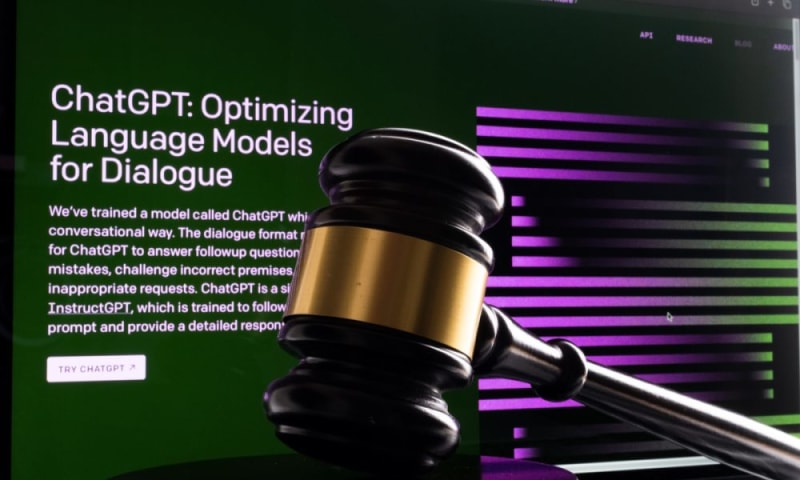

Dos abogados pueden enfrentar sanciones judiciales después de citar casos inventados por ChatGPT.

Los abogados podrían incluso ser inhabilitados después de usar información "alucinada" por la herramienta de inteligencia artificial generativa (IA) en dos ocasiones distintas, CNBC [informó] (https://www.cnbc.com/2023/05/30/chatgpt-cited -bogus-cases-for-a-new-york-federal-court-filing.html) martes (30 de mayo).

En primera instancia, los abogados presentaron mociones en un tribunal federal de la ciudad de Nueva York que citaron nueve casos legales que el abogado contrario le dijo más tarde al juez que no podía encontrar, según el informe.

El juez ordenó a los abogados que proporcionaran copias de los casos que habían citado sin decirles que tanto él como el abogado contrario habían determinado que los casos no existían, según el informe.

Los abogados presentaron el texto completo de ocho de los nueve casos, según el informe.

Más tarde se determinó que tanto las citas iniciales como el texto completo de los casos habían sido inventados por ChatGPT, según el informe.

El juez fijó una audiencia en la que los abogados deben explicarse, según el informe.

“A la Corte se le presenta una circunstancia sin precedentes”, dijo el juez, según el informe.

Como informó PYMNTS en marzo, “[alucinación](https://www.pymnts.com/artificial-intelligence-2/2023/chatgpt-4-looks-to-push-ai-innovation-beyond-shiny-object-category /)”, que es el término que usan los investigadores de IA para la generación de texto que es completamente falso o engañoso, es un problema que afecta a todos los chatbots.

No es nativo de ChatGPT sino de toda la IA de manera más amplia como una solución técnica entrenada en datos históricos.

Estas soluciones están inherentemente limitadas por una base de información que nunca estará verdaderamente actualizada.

Los modelos de lenguaje extenso (LLM) como ChatGPT también son propensos a [alucinaciones](https://www.pymnts.com/artificial-intelligence-2/2023/artificial-intelligence-is-eating-the-world-how-to- evitar-indigestión/) y devolver información inexacta o engañosa porque si los datos erróneos se convierten en la fuente de una respuesta, pueden propagarse aún más sirviendo como una base informativa para futuras respuestas con la tarea de una IA.

Este informe llega en un momento en que los líderes de la industria tecnológica como Amazon, Microsoft, Alphabet y Meta están redoblando su apuesta por las innovaciones adaptadas al futuro en [IA generativa](https://www.pymnts.com/big-tech/2023/big- tech-leans-on-ai-to-stabilize-after-brutal-year/) y aprendizaje automático (ML).

Durante las últimas llamadas de ganancias de estas empresas, se [mencionó] la "IA" (https://www.bloomberg.com/news/newsletters/2023-04-27/meta-alphabet-and-microsoft-are-ready-to- gastar mucho en inteligencia artificial a pesar de los recortes de costos) por parte de los ejecutivos más de 200 veces.

Estas empresas ya están utilizando IA entre bastidores y ahora la están expandiendo a más aplicaciones orientadas al consumidor.