Incidentes Asociados

Un sistema de identificación de voz utilizado por el gobierno australiano para millones de personas tiene una falla de seguridad grave, según descubrió una investigación de Guardian Australia.

Centrelink y la Oficina de Impuestos de Australia (ATO) brindan a las personas la opción de usar una "huella de voz", junto con otra información, para verificar su identidad por teléfono, lo que les permite acceder a información confidencial de sus cuentas.

Pero después de los informes de que una voz generada por IA entrenada para sonar como una persona específica podría usarse para acceder a servicios de banca telefónica en el extranjero, Guardian Australia ha confirmado que el sistema de huellas de voz también puede ser engañado por una voz generada por IA.

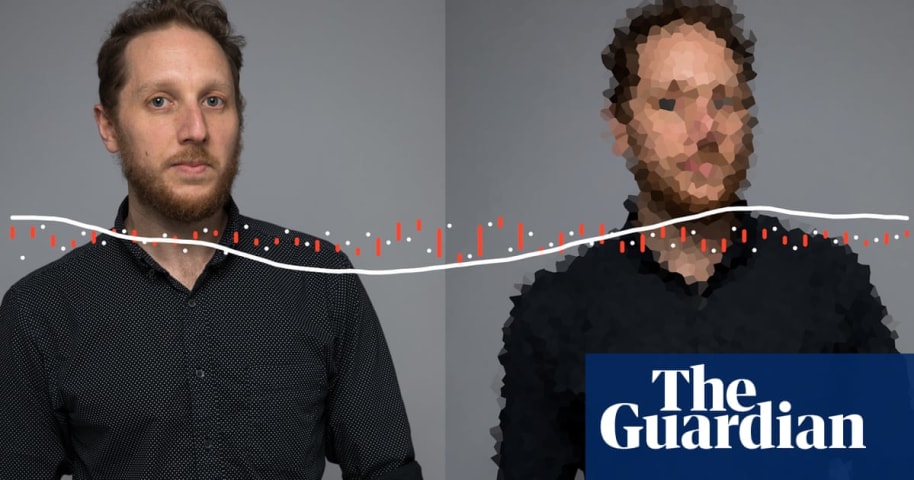

Con solo cuatro minutos de audio, un periodista de The Guardian Australia pudo generar un clon de su propia voz y luego pudo usarlo, combinado con su número de referencia de cliente, para obtener acceso a su propia cuenta de autoservicio de Centrelink.

El servicio Voiceprint, descrito como la "representación digital del sonido, el ritmo, las características físicas y los patrones de su voz", fue utilizado por 3,8 millones de clientes de Centrelink a fines de febrero, y más de 7,1 millones de personas habían verificado su voz con la ATO.

Services Australia, el departamento que supervisa Centrelink, dice en su sitio web que el servicio es "seguro, preciso y confiable".

“Es muy difícil que alguien acceda a tu información personal. El sistema puede saber cuándo alguien se hace pasar por usted o usa una grabación de su voz. No les daremos acceso a sus datos”.

Cualquier persona que intente utilizar la huella de voz también debe conocer el número de referencia del cliente del titular de la cuenta, que normalmente no está disponible públicamente, pero el número no se trata de forma tan segura como una contraseña y se incluye en la correspondencia de Centrelink y otros proveedores de servicios, como el cuidado de niños. centros

El sistema telefónico de autoservicio permite a las personas acceder a material sensible, como información sobre el pago de sus beneficios y solicitar el envío de documentos por correo, incluido el reemplazo de tarjetas de concesión o de salud.

Cuando Guardian Australia se puso en contacto con Services Australia con los detalles de la vulnerabilidad de seguridad, se negó a decir si la tecnología de impresión de voz se cambiaría o eliminaría de Centrelink.

Un portavoz, Hank Jongen, dijo que Services Australia "tiene la capacidad de evaluar continuamente los riesgos y actualizar los procesos en consecuencia" y que la identificación de voz es un "método de autenticación altamente seguro" utilizado por Centrelink.

“Buscamos continuamente amenazas potenciales y realizamos mejoras continuas para garantizar la seguridad del cliente”, dijo.

“Si identificamos circunstancias inusuales en la forma en que los clientes usan nuestros sistemas de autenticación, aplicamos pruebas adicionales para confirmar la identidad de la persona que llama”.

La línea telefónica de autoservicio de Centrelink utiliza huellas de voz en un sistema automatizado en lugar de una contraseña, pero la ATO y al menos un banco australiano, Bank Australia, ofrecen huellas de voz como una opción durante las conversaciones con el personal para reducir la necesidad de preguntas de verificación. Esto puede ser menos vulnerable a la explotación por parte del software de voz generado por IA, ya que es más difícil responder con respuestas de alta calidad en tiempo real, pero la tecnología para hacerlo está mejorando constantemente.

Toby Walsh, científico jefe del Instituto de IA de la Universidad de Nueva Gales del Sur, le dijo a Guardian Australia que pudo clonar su propia voz en cinco minutos, y la facilidad con la que la IA podía eludir la identificación biométrica mostró sus límites como herramienta de seguridad. Walsh no usó la voz clonada para probar el acceso a ningún servicio.

“Creo que la lección básica aquí es que la biometría no nos salvará de las molestias que tenemos hoy con las contraseñas y la autenticación de dos factores”, dijo.

“Si ha contactado a la persona por varias vías, a través de su teléfono o cuenta de Internet, entonces tiene cierta confianza en que la persona es [quien dice ser], pero solo ver su rostro o escuchar su voz no va a funcionar. ser suficiente."

Ed Santow, ex comisionado de derechos humanos y ahora director de políticas del Instituto de Tecnología Humana de la Universidad Tecnológica de Sídney, dijo que las agencias gubernamentales que utilizan la biometría como una forma de verificación necesitaban asegurarse de que tenían los mejores sistemas implementados, y que había la legislación que sustenta esos sistemas.

“Se necesita una legislación realmente clara para garantizar que las medidas de protección estén en su lugar desde la perspectiva del gobierno, [así como] los estándares básicos”, dijo. “Para que la agencia gubernamental solo use la tecnología cuando sea segura y confiable, y no esté sujeta al uso indebido y al delito cibernético”.

Un portavoz de la ATO dijo que la agencia tenía medidas sólidas para proteger el sistema de amenazas, incluida la clonación de voz de IA.

“ATO busca activamente vulnerabilidades potenciales y mejora su sistema según sea necesario para garantizar la seguridad y protección de los datos de los clientes de ATO, y los controles apropiados están integrados en los servicios digitales que ofrecemos a la comunidad australiana”.

Un portavoz de Bank Australia dijo que el banco trabajó "en estrecha colaboración con nuestros socios tecnológicos para monitorear regularmente y mejorar continuamente nuestros sistemas para garantizar que nos mantenemos a la vanguardia de las nuevas amenazas, incluidas las que plantean las herramientas emergentes de inteligencia artificial y aprendizaje automático".

Nuance, la empresa cuya tecnología se usa para el servicio de huellas de voz, no abordó específicamente las preguntas sobre la vulnerabilidad, pero dirigió a Guardian Australia a una [publicación de blog de febrero] (https://whatsnext.nuance.com/customer-engagement/detect -y-golpear-voces-sintéticas-con-biometría/), en el que abordó el tema de las “voces sintéticas”.

En la publicación del blog, la compañía describió sus esfuerzos para detectar voces sintéticas y afirmó que su última tecnología podría detectar y marcar con precisión el uso de voces clonadas en el 86% al 99% de los casos, según la tecnología utilizada.

“En Nuance, sabemos que no podemos dormirnos en los laureles, y los estafadores buscarán continuamente formas de eludir nuestras tecnologías de seguridad. Es por eso que dedicamos una gran cantidad de esfuerzo de I + D para anticiparnos a los próximos pasos de los delincuentes y estar constantemente un paso por delante”, dice la publicación.

La clonación de voz, una tecnología relativamente nueva que utiliza el aprendizaje automático, se ofrece en varias aplicaciones y sitios web de forma gratuita o por una pequeña tarifa, y se puede crear un modelo de voz con solo un puñado de grabaciones de una persona.

Si bien la voz generada es mejor con grabaciones de alta calidad, cualquier persona con grabaciones públicas de sí mismo en las redes sociales, o que haya sido grabada en otro lugar, podría ser vulnerable a que se reproduzca su voz.