Incidentes Asociados

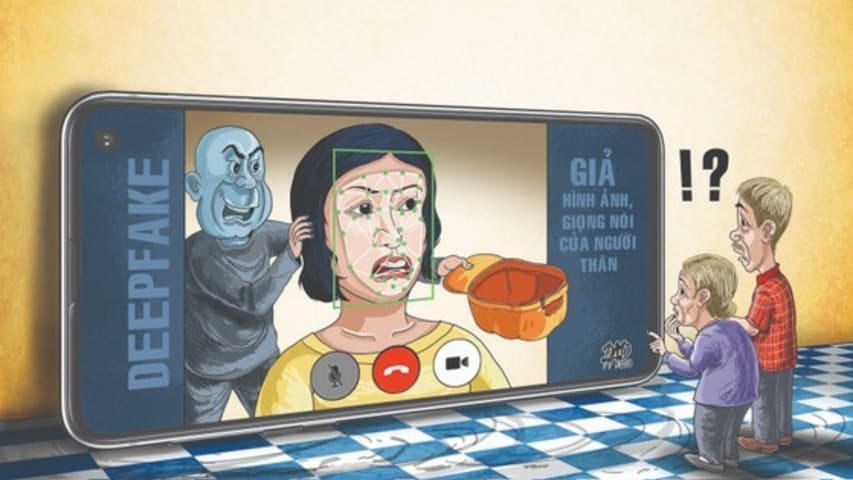

(DTTCO) - Después de la estafa por mensajes de texto gracias a la transferencia de dinero, ahora los estafadores aplican rápidamente otras tácticas más sofisticadas, a través de videollamadas falsas gracias a la tecnología Deepfake.

engañar a los usuarios

Después de casi una semana de ser estafado por casi 100 millones de VND, el Sr. N.C.P. (SN 1990, viviendo en la ciudad de Thu Duc) comprendió gradualmente que estaba "atrapado". Dijo que el 23 de marzo recibió un mensaje de un pariente llamado Th. (que vive en el extranjero) a través de Facebook, pidió prestado casi 100 millones de VND.

“Hice una videollamada con cuidado para confirmar, vi la foto y la voz de Th, dije que necesitaba dinero con urgencia y que lo devolvería al día siguiente. Creyendo que era mi pariente, inmediatamente transfirí dinero”, dijo el Sr. P.

Al llegar a su casa, entró en pánico al recibir el aviso de la cuenta de Facebook de Th. ha sido apropiado por ladrones, enviando mensajes pidiendo a amigos y familiares que pidan dinero prestado. El Sr. P. hizo una videollamada a Th. Todavía levanto el teléfono, todavía la cara y la voz de Th., pero el sonido es difícil de escuchar, la imagen está borrosa... El Sr. P. continúa llamando al número de teléfono móvil, luego la situación y la imagen del Sr. Th cambiarán sea claro. . ha sido cortado por objetos para engañar.

A mediados de marzo de 2023, la Sra. C.T.N.Y. (SN 1996, residente en el Distrito 8) también fue estafado por el mismo escenario, con una cantidad aún mayor. Dijo que mientras trabajaba en la empresa, recibió un mensaje de un amigo cercano a través de Facebook, pidiendo prestados 150 millones de VND para pagar la fecha de vencimiento. Debido a las advertencias de estafa anteriores, la Sra. Y. hizo una videollamada en línea para verificar. Al ver el video que mostraba la imagen del rostro de un amigo cercano, pero estaba bastante borroso, el sonido era tembloroso, la Sra. Y inmediatamente se preguntó; Esta persona respondió "en un área de señal débil".

Y. confianza, primero transfiera 50 millones de VND al número de cuenta requerido, videollamada para notificarle antes de transferir el monto restante. Al final del día, al no verlo transferir el préstamo, la Sra. Y volvió a llamar pero la cuenta no existía. Continuó llamando por número de teléfono, entonces ambos supieron que la cuenta de Facebook mencionada anteriormente había sido apropiada por los sujetos.

muchas consecuencias

Recientemente, la policía de algunas localidades como Hanoi, Thai Nguyen, Tuyen Quang, etc. ha emitido continuamente advertencias sobre métodos fraudulentos de apropiación de activos en el ciberespacio aprovechando la tecnología Deepfake. Sin embargo, más allá de los fines del fraude, la apropiación de bienes era bastante común; No es raro usar Deepfake para crear imágenes, videos y palabras falsas de celebridades y políticos con malos propósitos.

En todo el mundo, muchos líderes estadounidenses e incluso el fundador de la red social Facebook, Mark Zuckerberg, también han sido "atacados" con Deepfake. En Vietnam, ha habido una situación en la que muchos cantantes y celebridades famosos han sido pirateados por piratas informáticos que utilizan la tecnología Deepfake para defraudar a los consumidores a través de trucos publicitarios de ventas en línea.

Lo que es más peligroso, en algunos canales contra el Partido y el Estado de Vietnam, aparecieron imágenes, videos, sonidos y palabras falsos de la aplicación Deepfake para propagar cuestiones contrarias a la ley vietnamita; incluso fabricando descaradamente cuestiones políticas, económicas y sociales en Vietnam. Estos contenidos se distribuyen ampliamente a través de las plataformas de YouTube y Facebook, pero para muchas personas es difícil distinguir lo real de lo falso.

El Sr. Ngo Minh Hieu, Centro Nacional de Monitoreo de Seguridad Cibernética, dijo que existen muchas herramientas para apoyar objetos para crear videos Deepfake. En este punto, cuando los ciberdelincuentes en Vietnam saben más sobre las formas de robar videos e imágenes, recortar, usar herramientas guiadas en línea para crear Deepfake, es cuando se produce una ola de estafas del sistema 4.0, lo que dificulta que muchas personas sean engañadas y convertirse fácilmente en víctimas.

La policía de la ciudad de HCM dijo que recientemente, un método para llamar a la gente a denunciar es "tener hijos, amigos, parientes... emergencia en el hospital, tener que transferir dinero". Con este método, los sujetos apuntan a la psicología impaciente e impaciente de los padres.

Solo a principios de marzo de 2023, muchos padres en Ciudad Ho Chi Minh y algunas provincias fueron "atrapados" y transfirieron cientos de millones de dong a estafadores. El Departamento de Policía de Ciudad Ho Chi Minh recibió muchas denuncias, investigó activamente y determinó que se trata de un delito sin fronteras asociado con extranjeros.