Incidentes Asociados

El banco pensó que me estaba hablando a mí; la voz generada por IA ciertamente sonaba igual.

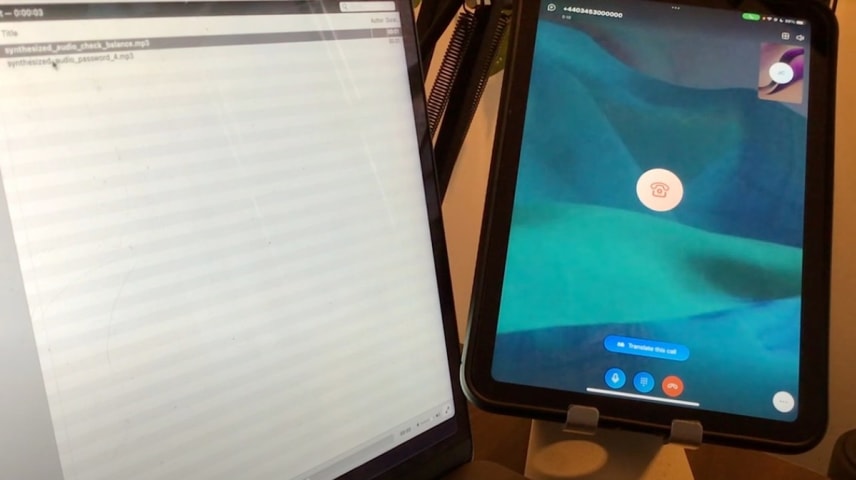

El miércoles, llamé a la línea de servicio automatizado de mi banco. Para empezar, el banco me pidió que dijera con mis propias palabras por qué estaba llamando. En lugar de hablar en voz alta, hice clic en un archivo en mi computadora portátil cercana para reproducir un clip de sonido: "verifique mi saldo", dijo mi voz. Pero esta no era en realidad mi voz. Era un clon sintético que había hecho usando tecnología de inteligencia artificial fácilmente disponible.

"Está bien", respondió el banco. Luego me pidió que ingresara o dijera mi fecha de nacimiento como la primera pieza de autenticación. Después de escribir eso, el banco dijo "por favor diga, 'mi voz es mi contraseña'".

Nuevamente, reproduje un archivo de sonido desde mi computadora. "Mi voz es mi contraseña", dijo la voz. El sistema de seguridad del banco tardó unos segundos en autenticar la voz.

“Gracias”, dijo el banco. Yo estaba en.

No podía creerlo, había funcionado. Había usado una réplica de una voz impulsada por IA para entrar en una cuenta bancaria. Después de eso, tuve acceso a la información de la cuenta, incluidos los saldos y una lista de transacciones y transferencias recientes.

Los bancos de EE. UU. y Europa utilizan este tipo de verificación de voz para permitir que los clientes inicien sesión en su cuenta por teléfono. Algunos bancos promocionan la identificación por voz como equivalente a una huella digital, una forma segura y conveniente para que los usuarios interactúen con su banco. Pero este experimento hace añicos la idea de que la seguridad biométrica basada en la voz proporciona una protección infalible en un mundo en el que ahora cualquiera puede generar voces sintéticas a bajo costo o, a veces, sin costo alguno. Usé un servicio gratuito de creación de voz de ElevenLabs, una empresa de voz de IA.

Ahora, el abuso de las voces de IA puede extenderse al fraude y la piratería. Algunos expertos con los que hablé después de hacer este experimento ahora están pidiendo a los bancos que abandonen la autenticación de voz por completo, aunque el abuso en el mundo real en este momento podría ser raro.

Rachel Tobac, directora ejecutiva de la empresa enfocada en ingeniería social SocialProof Security, le dijo a Motherboard: "Recomiendo a todas las organizaciones que aprovechen la 'autenticación' de voz, cambien a un método seguro de verificación de identidad, como la autenticación multifactor, lo antes posible". Este tipo de replicación de voz se puede "completar sin necesidad de interactuar con la persona en la vida real".

Los trolls en línea ya han usado ElevenLabs para hacer réplicas de voces de personas sin su consentimiento, usando clips de las voces de las personas en línea. Potencialmente, cualquier persona con unos pocos minutos de su voz disponible públicamente (YouTubers, personas influyentes en las redes sociales, políticos, periodistas) podría ser susceptible a este tipo de clonación de voz.

Realicé la prueba en una cuenta con Lloyds Bank en el Reino Unido. En su sitio web, Lloyds Bank dice que su programa “Voice ID” es seguro. “Tu voz es como tu huella dactilar y es única para ti”, dice el sitio. “Voice ID analiza más de 100 características diferentes de su voz que, al igual que su huella digital, son únicas para usted. Por ejemplo, cómo usa la boca y las cuerdas vocales, su acento y qué tan rápido habla. Incluso te reconoce si tienes un resfriado o dolor de garganta”, añade.

Muchos bancos en los EE. UU. ofrecen servicios similares de verificación de voz. TD Bank tiene uno llamado “VoicePrint” y dice en su sitio web “Tu huella de voz, como tu huella dactilar, es única para ti, nadie más tiene una voz como tú”. Chase tiene “Identificación de voz” que, al igual que Lloyds Bank, también afirma que la huella de voz de un cliente “se crea a partir de más de 100 características físicas y de comportamiento diferentes”. Mientras tanto, “Verificación de voz” de Wells Fargo “protege efectivamente su identidad”, según el sitio web del banco.

Aunque solo realicé la prueba en Lloyds Bank, dada la naturaleza y el funcionamiento similares de estos otros sistemas, también pueden estar en riesgo para las voces impulsadas por IA. Muchos bancos permiten a los usuarios realizar una gran cantidad de funciones bancarias por teléfono, como verificar el historial de transacciones, los saldos de las cuentas y, en algunos casos, transferir fondos.

Para este ataque en particular, un estafador también necesitaría la fecha de nacimiento del objetivo. Pero gracias a una gran cantidad de filtraciones de datos, intermediarios o personas que comparten datos personales en línea, la fecha de nacimiento suele estar fácilmente disponible.

Un portavoz de Lloyds Bank dijo en un comunicado que "la identificación de voz es una medida de seguridad opcional; sin embargo, confiamos en que brinda niveles más altos de seguridad que los métodos tradicionales de autenticación basados en el conocimiento, y que nuestro enfoque en capas para la seguridad y la prevención del fraude continúa brindando el nivel adecuado de protección para las cuentas de los clientes, al tiempo que facilita el acceso a ellas cuando sea necesario”.

Lloyds Bank dijo que es consciente de la amenaza de las voces sintéticas y del despliegue de contramedidas, pero no ha visto ningún caso en el que se haya utilizado esa voz para cometer fraude contra sus clientes. Las voces sintéticas no son tan atractivas para los estafadores como otros métodos mucho más comunes, y la identificación de voz ha llevado a una caída significativa en el fraude con la banca telefónica, dijo Lloyds Bank.

Dado lo raro que es el fraude de voz sintética en este momento, es probable que los consumidores estén en mejores condiciones para usarlo si significa protegerlos de otros tipos de fraude, como el phishing. Ese cálculo podría cambiar si el consumidor es una figura pública, con mucho audio de alta calidad de su voz disponible en Internet.

TD Bank, Chase y Wells Fargo no respondieron a una solicitud de comentarios sobre si están al tanto de las voces impulsadas por IA que se utilizan para atacar las cuentas de los clientes y qué mitigaciones, si las hay, están tomando para detener la amenaza. En septiembre, los abogados [demandaron a un grupo de instituciones financieras estadounidenses](https://news.bloomberglaw.com/privacy-and-data-security/capital-one-faces-lawsuit-over-use-of-biometric-voice- huellas dactilares) porque las huellas biométricas de voz utilizadas para identificar a las personas que llaman violan la Ley de invasión de la privacidad de California.

La Oficina de Protección Financiera del Consumidor, una de las agencias de EE. UU. que regula la industria financiera, me dijo en un comunicado después de que envié la demostración en video: “La CFPB está preocupada por la seguridad de los datos, y las empresas han recibido un aviso de que serán responsables de prácticas de mala calidad. Esperamos que cualquier empresa siga la ley, independientemente de la tecnología utilizada”.

En las últimas semanas, probé algunos servicios de generación de voz con IA. La mayoría de ellos tenían problemas o limitaciones para recrear mi acento británico, que sería necesario para acceder a la cuenta de Lloyds Bank. Eventualmente usé ElevenLabs, que manejó bien el acento.

Para crear la voz, grabé unos cinco minutos de discurso y los subí a ElevenLabs (para los clips de audio, leí secciones de la ley de protección de datos de Europa). Poco tiempo después, la voz sintética estaba lista para usar y decía cualquier texto ingresado en el sitio de ElevenLabs.

El experimento de ingresar a la cuenta bancaria falló varias veces y el sistema de Lloyds Bank dijo que no podía autenticar la voz. Después de hacer algunos ajustes en ElevenLabs, como hacer que lea un cuerpo de texto más largo para que las cadencias suenen más naturales, el audio generado superó con éxito la seguridad del banco.

En su sitio web, ElevenLabs dice que sus casos de uso incluyen proporcionar voces para boletines, libros y videos. Pero con medidas de seguridad mínimas en el momento del lanzamiento, la gente rápidamente abusó de la tecnología de ElevenLabs. Los miembros de 4chan usaron ElevenLabs para hacer versiones sintéticas de celebridades que dicen cosas racistas y transfóbicas, como [una falsa Emma Watson leyendo Mein Kampf] (https://www.vice.com/en/article/dy7mww/ai-voice-firm -4chan-celebrity-voices-emma-watson-joe-rogan-elevenlabs). Más tarde, los trolls usaron generadores de voz de IA para hacer réplicas de actores de voz específicos y luego los hicieron [leer las direcciones de las casas de los actores en publicaciones en Twitter] (https://www.vice.com/en/article/93axnd/ voice-actors-doxed-with-ai-voices-on-twitter) (los atacantes afirmaron que la tecnología de ElevenLabs se usó como parte del dox, pero ElevenLabs afirmó que solo otro clip, que no incluía las direcciones del objetivo, se hizo con su software).

Después de los clips de celebridades, ElevenLabs tuiteó para preguntar qué medidas de seguridad debería implementar, como solicitar la identificación de identificación completa de los usuarios o requerir información de pago. Sin embargo, Motherboard pudo generar la voz sin proporcionar una identificación ni ninguna información de pago, posiblemente porque la cuenta se creó antes de que ElevenLabs introdujera nuevas medidas de seguridad. El costo de crear la seguridad bancaria sin pasar por voz fue gratuito.

ElevenLabs no respondió a múltiples solicitudes de comentarios. En una declaración anterior, Mati Staniszewski, ex estratega de implementación de Palantir y ahora cofundador de ElevenLabs, dijo: "Nuestras nuevas medidas de seguridad ya están reduciendo rápidamente los casos de uso indebido y estamos agradecidos con nuestra comunidad de usuarios por continuar señalando cualquier ejemplo en el que se deba tomar una acción adicional y ayudaremos a las autoridades a identificar a esos usuarios". si se quebrantó la ley”.

Actualización: esta pieza se ha actualizado con una declaración de la Oficina de Protección Financiera del Consumidor. También se actualizó para corregir que la tecnología de ElevenLabs no se usaba para leer el dox de los actores de voz, sino que la usaban los mismos atacantes.