Incidentes Asociados

ChatGPT, el chatbot de inteligencia artificial que genera respuestas de texto con un sonido inquietantemente humano, es la cara nueva y avanzada del debate sobre el potencial y los peligros de la IA.

La tecnología tiene la capacidad de ayudar a las personas con la escritura cotidiana y tareas de conversación y puede proporcionar [experimentos mentales divertidos](https:/ /markets.businessinsider.com/news/stocks/chatgpt-markets-write-stocks-economy-meme-ai-microsoft-insider-anlayst-2023-1), pero algunos desconfían, ya que se sabe que el chatbot permite usuarios para hacer trampa y [plagiar](https://www. axios.com/2023/01/13/chatgpt-schools-teachers-ai-debate), potencialmente [difundir información errónea](https://www.businessinsider.com/i-pedí-chatgpt-to-write-insider-story -fue-convincente-2022-12), y también podría usarse para habilitar [prácticas comerciales poco éticas] (https://www.businessinsider.com/company-using-chatgpt-mental-health-suppo rt-temas-éticos-2023-1).

Lo que es aún más alarmante: como muchos [chat bots anteriores] (https://www.businessinsider.com/google-engineer-blake-lemoine-ai-ethics-lamda-racist-2022-7), también está plagado de inclinación.

OpenAI, la compañía detrás del primer GPT y sus versiones posteriores, agregó medidas de protección para ayudar a ChatGPT a evadir respuestas problemáticas de los usuarios que le piden al chatbot que, por ejemplo, diga un insulto o cometer delitos.

Sin embargo, a los usuarios les resultó extremadamente fácil evitar esto reformulando sus preguntas o simplemente pidiéndole al programa que ignorara sus medidas de seguridad, lo que provocó respuestas con cuestionable, y a veces abiertamente discriminatorio, [lenguaje].

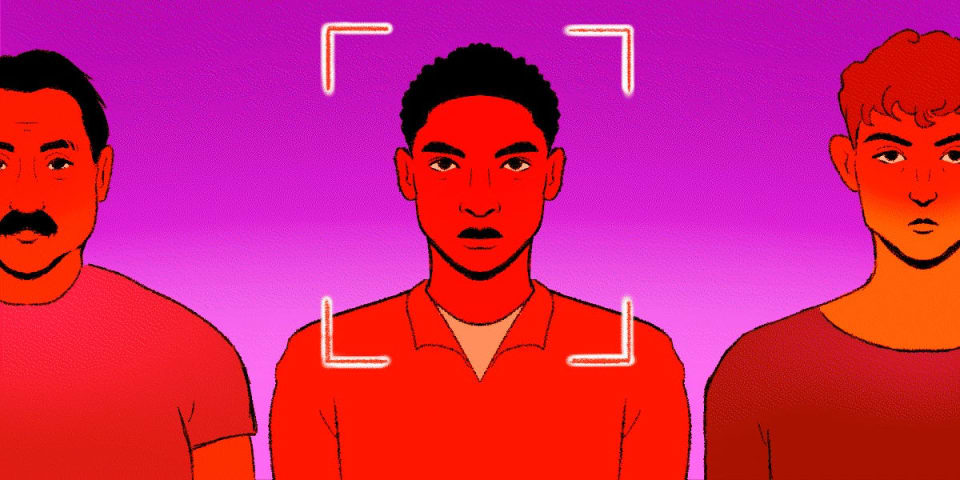

A medida que el mundo depende de más tecnología, la IA se utiliza para tomar decisiones vitales en sectores como la policía y la atención médica. Pero los algoritmos sesgados significan que las desigualdades existentes podrían amplificarse, con resultados peligrosos.

ChatGPT representa solo un ejemplo de un problema mayor

El tema del sesgo está extremadamente bien documentado.

Las preocupaciones sobre los algoritmos sesgados [han existido desde la década de 1970] (https://news.mit.edu/2008/obit-weizenbaum-0310) durante el inicio del surgimiento del campo. Pero los expertos dicen que se ha hecho poco para prevenir estos sesgos a medida que la IA se comercializa y se generaliza.

Las fuerzas del orden ya comenzaron a usar IA para evaluar a [delincuentes] (https://www.technologyreview.com/2019/01/21/137783/algorithms-criminal-justice-ai/) en función de un conjunto de 137 preguntas de antecedentes y determina sean o no reincidentes. En 2016, ProPublica descubrió que [los negros] (https://www.propublica.org/article/how-we-analyzed-the-compas-recidivism-algorithm) tenían el doble de probabilidades que los blancos de ser clasificados erróneamente por esta tecnología.

Los algoritmos utilizados en un hospital recomendaron que los pacientes negros recibieran menos atención médica que sus homólogos blancos, según encontró un [estudio de 2019]. (https://www.science.org/doi/10.1126/science.aax2342)

Amazon cerró su propia herramienta de IA de contratación en 2018 porque discriminaba a las candidatas.

Y Galactica, un LLM similar a ChatGPT entrenado en 46 millones de ejemplos de texto, fue [cerrado por Meta después de 3 días] (https://www.technologyreview.com/2022/11/18/1063487/meta-large-language- model-ai-only-survived-three-days-gpt-3-science/) porque arrojaba información falsa y racista.

En junio, un equipo de investigadores de la Universidad Johns Hopkins y el Instituto de Tecnología de Georgia [robots capacitados en visión artificial](https:/ /www.insider.com/researchers-found-ai-robots-racist-and-sexist-stereotypes-sorting-photos-2022-7) con una red neuronal [conocida como CLIP](https://openai.com/blog /clip/), luego le pidió al robot que escaneara y clasificara bloques digitales con imágenes de rostros de personas.

Después de recibir instrucciones como "empaquetar al criminal en la caja", el robot clasificó a los hombres negros como criminales un 10 % más que a los hombres blancos. El robot también clasificó a los hombres latinos como conserjes sobre los hombres blancos un 10% más y tendió a clasificar a las mujeres como amas de casa sobre los hombres blancos.

Investigadores de la Universidad de Washington y Harvard encontraron que este mismo modelo tenía una tendencia a clasificar a las personas que eran multirraciales como minorías, incluso si también eran blancos. También usó a los blancos como estándar, y "otros grupos raciales y étnicos" fueron "definidos por su desviación" de la blancura, según el estudio.

CLIP, al igual que ChatGPT, ganó un interés generalizado por la gran escala de su conjunto de datos, a pesar de la evidencia discordante de que los datos resultaron en imágenes y descripciones de texto discriminatorias.

Sin embargo, los modelos de IA se están apoderando rápidamente de muchos aspectos de nuestras vidas, dijo a Insider Matthew Gombolay, uno de los investigadores detrás del experimento del robot CLIP. Gombolay dijo que los modelos de toma de decisiones con sesgos como CLIP podrían usarse en cualquier cosa, desde vehículos autónomos que deben reconocer a los peatones hasta sentencia de prisión.

Gombolay, profesor asistente de Computación Interactiva en Georgia Tech, le dijo a Insider que todos deberíamos estar preocupados por el potencial de los sesgos de la IA para causar daños en el mundo real: "Si eres un humano, debería preocuparte".

Cómo la IA se vuelve sesgada en primer lugar

Todos los modelos de aprendizaje automático, o IA entrenada para realizar tareas específicas, se entrenan en un conjunto de datos, que es la recopilación de puntos de datos que informan la salida del modelo.

En los últimos años, los científicos de IA que trabajan para alcanzar el objetivo de Inteligencia general artificial, o IA que tiene la capacidad de aprender y actuar como humanos, sostuvo que para lograr esto, sus modelos deben ser entrenados en enormes acumulaciones de datos.

ChatGPT en sí está capacitado en [300 mil millones de palabras o 570 GB de datos]. (https://www.sciencefocus.com/future-technology/gpt-3/)

El problema: los conjuntos de datos grandes y no seleccionados [extraídos de Internet] (https://arxiv.org/pdf/2112.04359.pdf) están llenos de datos sesgados que luego informan a los modelos.

Los investigadores usan filtros para evitar que los modelos proporcionen información incorrecta después de recopilar datos, pero estos filtros no son 100 % precisos. Esto puede resultar en la expresión de sesgos dañinos, como cuando ChatGPT les dijo a los usuarios que estaría bien torturar a personas de ciertos [antecedentes minoritarios.](https://theintercept.com/2022/12/08/openai-chatgpt-ai- sesgo-ética/)

Además, debido a que los datos se recopilan del pasado, tiende a tener un sesgo regresivo que no refleja el progreso de los movimientos sociales.

También existe el sesgo de los investigadores en IA, que es un [campo extremadamente homogéneo](https://www.npr.org/2022/02/13/1080464162/lack-of-diversity-in-ai-development-causes -daño-grave-en-la-vida-real-para-las-personas-de-) dominado por personas blancas y hombres, que deciden con qué datos alimentar sus modelos.

Sin embargo, la industria está dividida sobre quién debería ser culpable de estos sesgos y si la industria de la IA debería o no lanzar modelos que saben que pueden ser dañinos.

Los investigadores de IA como Sean McGregor, el fundador de la colaboración de IA responsable, le dijeron a Insider que los datos sesgados son inevitables y que el lanzamiento de ChatGPT de OpenAI permite a las personas ayudar a hacer que las "barreras de protección" que filtran los datos sesgados sean más sólidas.

"Puede hacer todo lo posible para filtrar un instrumento y crear un mejor conjunto de datos, y puede mejorar eso", dijo McGregor. "Pero el problema es que sigue siendo un reflejo del mundo en el que vivimos, y el mundo en el que vivimos está muy sesgado y los datos que se producen para estos sistemas también están sesgados".

Sin embargo, especialistas en ética de la IA como Abeba Birhane y Deborah Raji escribieron en Wired que la industria de la IA es muy consciente del daño que estos modelos promulgar, pero no se debe echar la culpa a la sociedad o a los conjuntos de datos que pretenden estar fuera de su control.

“Pero el hecho es que tienen el control, y ninguno de los modelos que estamos viendo ahora es inevitable”, escribieron Birhane y Raji. "Habría sido completamente factible tomar decisiones diferentes que resultaron en el desarrollo y lanzamiento de modelos completamente diferentes".

La seguridad siempre está jugando un juego de recuperación

ChatGPT ya está listo para convertirse en un modelo rentable, ya que el gigante tecnológico Microsoft busca invertir $ 10 mil millones para integrar la tecnología en sus servicios [como el motor de búsqueda Bing.] (https://www.businessinsider.com/microsoft-bing- chatgpt-google-búsqueda-openai-2023-1)

Sin embargo, el problema del sesgo subyacente en ChatGPT, y la industria de la IA en su conjunto, aún no se ha resuelto por completo.

Vinay Prabhu, un investigador detrás de un experimento que observó un modelo de imagen y texto similar a CLIP, le dijo a Insider que las imágenes que había visto a través de su trabajo eran tan perturbadoras que lo enfermaron físicamente.

"Hay un precio que pagas por hacer esta investigación", dijo Prabhu.

Su [investigación] (https://arxiv.org/abs/2110.01963), que observó sesgos sexistas entre el modelo de emparejamiento de texto a imagen LAION -400M, encontró múltiples instancias de imágenes que contenían representaciones violentas de violación y agresión sexual.

Aunque los especialistas en ética están logrando pequeños avances en la regulación de la IA, Prabhu describió la falta de preocupación ética en la industria de la IA como una "desconexión" entre los académicos que plantean preocupaciones y las empresas emergentes que buscan ganar dinero.

"Siento que la gente está demasiado enamorada de las posibilidades, que la seguridad siempre está jugando un juego de recuperación", dijo Prabhu.