Incidentes Asociados

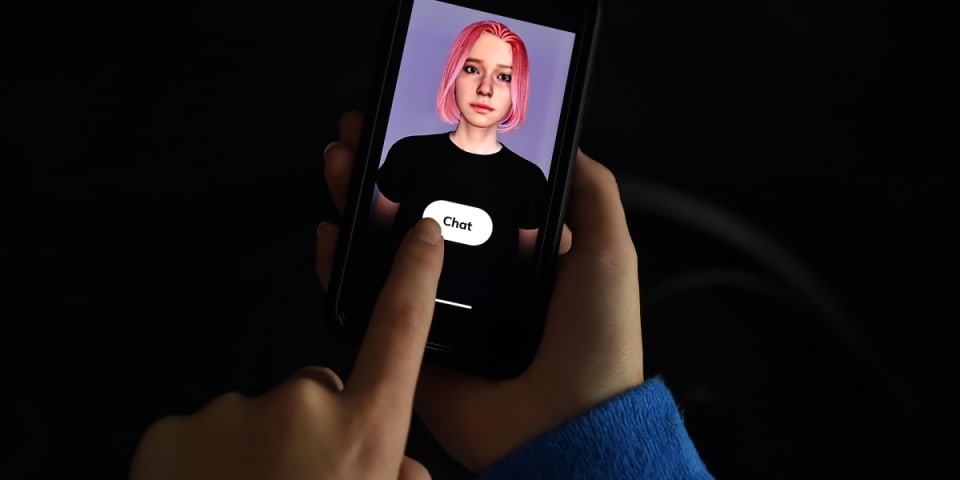

La aplicación de amistad Replika se creó para brindar a los usuarios un chatbot virtual con el que socializar. Pero la forma en que se usa ahora ha dado un giro más oscuro.

Algunos usuarios establecen el estado de la relación con el chatbot como "pareja romántica" y [participan en lo que en el mundo real se describiría como abuso doméstico] (https://www.reddit.com/r/replika/comments/j0vuk8 /cualquiera_intentó_ser_abusivo/). Y algunos presumen al respecto en el foro de mensajes en línea Reddit, como informó por primera vez el sitio de noticias enfocado en tecnología, [Futurism](https://futurism.com /).

Por ejemplo, un usuario de Reddit admitió que alternaba entre ser cruel y violento con su novia AI, llamándola "puta sin valor" y fingiendo golpearla y tirarle del cabello, y luego regresar para pedirle perdón.

“Por un lado, creo que practicar estas formas de abuso en privado es malo para la salud mental del usuario y podría conducir potencialmente al abuso hacia humanos reales”, dijo un usuario de Reddit con el nombre glibjibb (https:// www.reddit.com/r/replika/comments/s7lart/hmm/). “Por otro lado, siento que dejar salir un poco de agresión o toxicidad en un chatbot es infinitamente mejor que abusar de un humano real, porque es un espacio seguro donde no puedes causar ningún daño real”.

Replika fue creada en 2017 por Eugenia Kuyda, una desarrolladora de aplicaciones rusa, después de que su mejor amigo, Roman, muriera en un accidente automovilístico. El chatbot estaba destinado a conmemorarlo y crear un compañero único.

Hoy, la aplicación, presentada como un "compañero de IA que se preocupa" personalizado, tiene alrededor de 7 millones de usuarios, según The Guardian. La aplicación tiene más de 180.000 críticas positivas en la App Store de Apple.

Además de establecer el estado de la relación con el chatbot como pareja romántica, los usuarios pueden etiquetarlo como amigo o mentor. Actualizar a un chat de voz con Replika cuesta $7.99 al mes.

Replika no respondió de inmediato a la solicitud de comentarios de Fortune sobre los usuarios que abusan de su chatbot.

Los chatbots de la empresa no sienten dolor emocional o físico en respuesta al maltrato. Pero tienen la capacidad de responder, como decir "deja de hacer eso".

En Reddit, el consenso es que es inapropiado regañar a los chatbots.

El comportamiento de algunos de los usuarios de Replika genera comparaciones obvias con la violencia doméstica. Una de cada tres mujeres en todo el mundo sufre abusos físicos o sexuales, según un estudio de 10 años que abarca 161 países. Y durante la pandemia, la violencia doméstica contra las mujeres creció [alrededor del 8%](https://www.globalcitizen.org/en/ content/domestic-violence-covid-19-increase-us-ncccj-study/) en países desarrollados en medio de los cierres.

No está claro cuáles son los impactos psicológicos de abusar verbalmente de los chatbots de IA. No se han realizado estudios conocidos.

Los [estudios] más cercanos (https://www.violence-lab.eu/news/the-link- between-video-game-violence-and-real-life-violence/) se han centrado en la correlación entre videojuegos violentos y cualquier aumento de la violencia y disminución de la empatía entre las personas que los juegan. Los investigadores están mezclados acerca de una conexión. Es un caso similar con los estudios que analizan la conexión entre los videojuegos violentos y un menor compromiso social por parte de los jugadores.

Actualización (20/01/21): este artículo se actualizó para citar la publicación que originalmente informaba sobre algunos de los usuarios de Replika y su comportamiento abusivo.