Incidentes Asociados

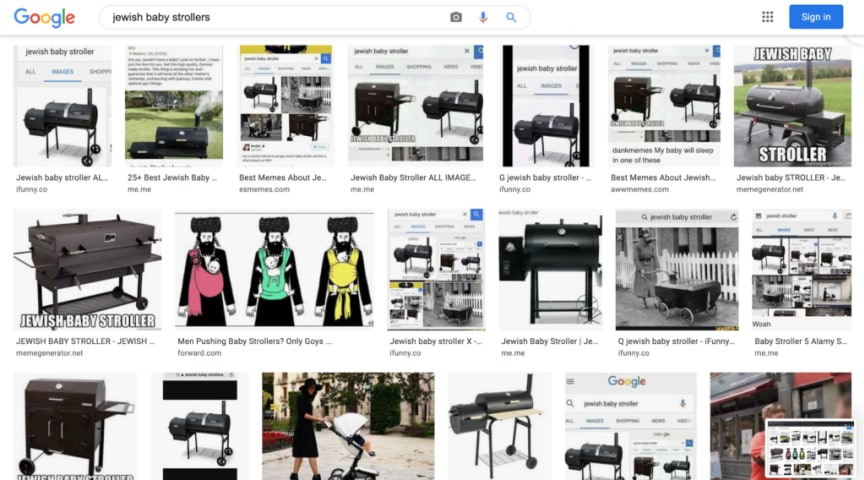

(JTA) — Los resultados de Google son impactantes: haga una búsqueda de imágenes de "cochecitos de bebé judíos" y verá fila tras fila de hornos portátiles, una alusión ofensiva a la Holocausto.

Google dice que está investigando los resultados de búsqueda y quiere mejorarlos. Pero según los investigadores, los resultados pueden no ser un accidente. Es posible que sean el resultado de una campaña extremista coordinada en un sitio web marginal para generar esas imágenes específicas.

El Instituto de Investigación de Contagio en la Red, que estudia la forma en que el discurso de odio se propaga en línea, ubicó una serie de publicaciones en el foro de mensajes de 4chan, que datan de 2017, que emparejan deliberadamente imágenes de hornos en ruedas con el término "cochecito de bebé judío". En una búsqueda aparecieron al menos una docena de imágenes de este tipo, que datan de agosto y septiembre de 2017. Eso significa que estos resultados pueden haber estado vigentes durante años, a pesar de que llamaron la atención el viernes.

Publicar ese término específico junto a la imagen puede haber manipulado el algoritmo de búsqueda de Google, de modo que promocionó esas imágenes cuando los usuarios buscan el término, dice Joel Finkelstein, director del instituto.

“Lo que sucede es que engañan a Google para que ponga esas cosas arriba”, dijo Finkelstein. “Pegan la imagen con las palabras para que cuando busques esas palabras, la imagen aparezca en la parte superior”.

Las referencias a los hornos son relativamente comunes entre los antisemitas, quienes las hacen para aludir a los judíos pertenecientes a los crematorios que los nazis utilizaron para incinerar los cuerpos de los judíos que mataron en el Holocausto.

Google le dijo a la Agencia Telegráfica Judía en un comunicado que las imágenes son "perturbadoras" y son el resultado de un algoritmo. No incluía información clara sobre cómo se pueden prevenir tales resultados de búsqueda.

“Entendemos que estos son resultados inquietantes y compartimos la preocupación por este contenido”, dijo el comunicado. “No refleja nuestras opiniones. Cuando las personas buscan imágenes en Google, nuestros sistemas dependen en gran medida de hacer coincidir las palabras de su consulta con las palabras que aparecen junto a las imágenes en la página web. Para esta consulta, que es para un producto que en realidad no existe, las coincidencias más cercanas son páginas web que contienen contenido ofensivo y odioso. Hemos realizado un trabajo considerable para mejorar los casos en los que devolvemos contenido de baja calidad, y analizaremos esta situación para ver cómo podemos obtener resultados más útiles”.

Google rara vez elimina resultados de búsqueda individuales o realiza ajustes para un término de búsqueda específico. Un portavoz dijo que la compañía busca "mejoras sistemáticas más amplias que puedan mejorar la búsqueda para otras consultas similares". En particular, dijo el portavoz, el desafío aquí es un "vacío de datos" donde el único contenido disponible para un término de búsqueda es "ofensivo [o] de baja calidad".

Los investigadores del Network Contagion Research Institute dicen que podría haber otra posibilidad: que un meme antisemita, también de 2017, llevó al algoritmo de búsqueda de Google a confundir el horno portátil con un cochecito porque se parecen un poco. Al igual que las publicaciones de 4chan, el meme es la imagen de un horno portátil sobre el texto "cochecito de bebé judío" en mayúsculas.

“O es una redada de trolls de 4chan o es un meme que circuló en la web”, dijo Alex Goldenberg, analista principal de inteligencia del instituto. “El algoritmo de búsqueda de Google lo está llevando a la cima por alguna razón, o el elemento en el meme está engañando al algoritmo de Google”.

Goldenberg agregó: "Es notable que la búsqueda de imágenes de Google no detectó eso".

Si fuera una acción coordinada de antisemitas en línea, llamada “redada”, no sería la primera. En una "redada" de 2016 llamada [Operación Google](https://www.newstatesman.com/science-tech/internet/2016/09/stinking-googles-should-be-killed-why-4chan-using-search- motor-racista), los extremistas intentaron socavar una nueva herramienta que tenía Google para detectar y filtrar insultos raciales y étnicos. Lo hicieron reemplazando los insultos en sus comentarios con los nombres de las empresas de tecnología. Entonces, por ejemplo, usaron la palabra "Google" en lugar de la palabra n, y usaron la palabra "Skype" para referirse a los judíos. Esperaban que hacer eso obligaría a Google a censurar su propio nombre, lo que no sucedió.

Esta tampoco es la primera vez que Google arroja resultados de búsqueda antisemitas. Según MEMRI, una organización de investigación de medios y la Organización Sionista Mundial, el término de búsqueda “oy vey” [arrojó resultados antisemitas] (https://www.wzo.org.il/antisemitism/index.php?dir= site&page=articles&op=item&cs=1822) también. En 2016, Google hizo cambios para que su función de búsqueda ya no sugirió el término de búsqueda "los judíos son malvados".

Goldenberg señaló que parte del objetivo de las "redadas" es generar cobertura mediática, de modo que los términos antisemitas se difundan más ampliamente.

“La naturaleza de estas redadas es llamar la atención sobre el antisemitismo”, dijo.