Incidentes Asociados

Un pequeño experimento de un investigador de inteligencia artificial plantea preguntas sobre cómo el algoritmo de recomendación de TikTok sugiere nuevos creadores a los usuarios.

Específicamente, la pregunta es si ese algoritmo está clasificando las sugerencias según la raza del creador, algo que TikTok niega que esté haciendo intencionalmente. Pero es otro ejemplo de la necesidad de un mayor escrutinio sobre cómo la aplicación y otras plataformas de redes sociales promueven creadores o contenido en particular.

Marc Faddoul es un investigador de la Escuela de Información de la Universidad de California Berkeley que estudia la IA y la desinformación. Estaba revisando TikTok para buscar desinformación cuando notó algo curioso sobre cómo el app recomienda nuevos creadores a seguir.

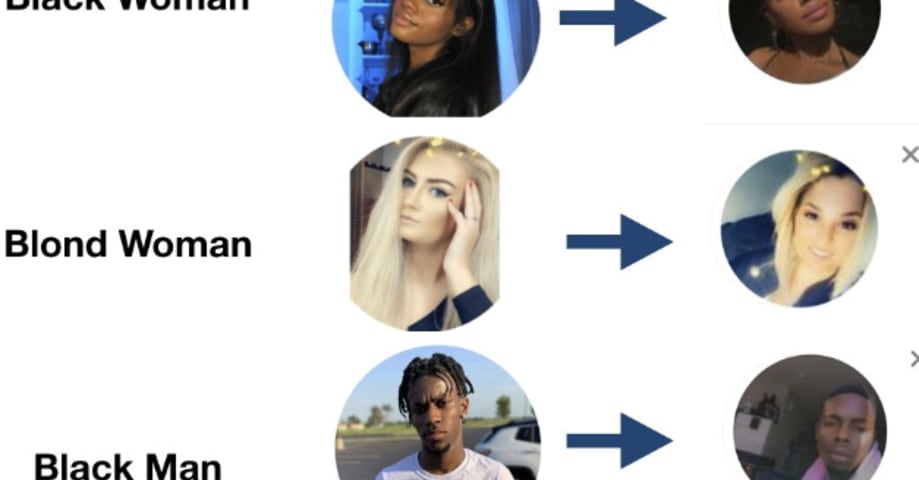

En la aplicación, cuando una persona sigue una nueva cuenta, puede hacer clic en una flecha que luego recomienda otras cuentas para seguir. Faddoul se dio cuenta de que cuando hacía esto, las cuentas recomendadas tendían a parecerse a la persona a la que acababa de seguir, hasta el origen étnico y el color del cabello.

"Vi este patrón muy claro que estaba sucediendo", dijo a BuzzFeed News. "Al seguir una cuenta, las sugerencias tienen un aspecto muy similar".

Hizo una nueva cuenta para probarlo de nuevo, y estos fueron sus resultados:

Faddoul advirtió que se trataba de un experimento casual, no de una investigación real, pero dijo que los resultados siguen siendo interesantes.

BuzzFeed News probó un experimento similar con una cuenta nueva y obtuvo resultados similares.

Seguir al creador del hiyab @jiggybush hizo que la aplicación recomendara a otras mujeres que usan un hiyab.

Al principio, Faddoul sospechó que TikTok estaba empleando tecnología de inteligencia artificial que estudiaba las fotos de perfil de las personas al hacer recomendaciones. Otras empresas de tecnología, como Netflix, usan esto para determinar en qué miniaturas es más probable que haga clic un usuario. Es por eso que la página de inicio de Netflix de una persona puede tener imágenes diferentes a las de otra persona para promocionar el mismo programa.

Pero, según TikTok, hay una respuesta simple a las preguntas planteadas por Faddoul.

TikTok le dijo a BuzzFeed News que usa lo que se conoce como filtrado colaborativo. Básicamente, la aplicación recomienda nuevas cuentas en función de a quién siguen las personas que siguen a ese usuario.

"No hemos podido replicar resultados similares a estos reclamos", dijo un portavoz de TikTok a BuzzFeed News.

"Nuestra recomendación de cuentas a seguir se basa en el comportamiento del usuario: los usuarios que siguen la cuenta A también siguen la cuenta B, por lo que si sigues a A, es probable que también quieras seguir a B".

Eso también explica por qué, al seguir a un gran creador como Addison Rae, la aplicación recomienda a otros creadores de Hype House, en lugar de creadores que se parecen a Rae.

O, en otro ejemplo, seguir a un artista devuelve recomendaciones para otros artistas.

Es un sistema clásico utilizado por empresas de tecnología desde YouTube hasta Netflix, pero eso no significa que no esté libre de problemas, dijo Faddoul.

"El filtrado colaborativo también puede reproducir cualquier sesgo que haya en el comportamiento de las personas", dijo.

"A las personas a las que les gustan los adolescentes rubios tienden a gustarles muchos otros adolescentes rubios. En ese sentido, es algo esperado".

Lo que eso significa es que TikTok recomendó a las mujeres de la cuenta de prueba de BuzzFeed News que usan hiyab porque las personas que siguen un hiyab tienden a seguir a otros hiyab.

Pero, dijo Faddoul, esto puede crear un ciclo de retroalimentación en el que a las personas solo se les recomienda un tipo particular de creador, lo que lleva a una falta de diversidad en su feed.

Por ejemplo, dijo, si los creadores más populares en una plataforma son blancos y la aplicación sigue recomendando a otros creadores blancos, a los creadores de color les resulta difícil ganar seguidores y popularidad, incluso si esa no es la intención del algoritmo.

"Entonces significa que es más fácil que se recomiende a una persona blanca que a alguien de una minoría subrepresentada", dijo. "Entonces eso es algo que puede estar sucediendo, independientemente de su característica facial o filtrado colaborativo".

Por supuesto, esto no es exclusivo de TikTok. Todas las plataformas de redes sociales que usan algoritmos pueden crear burbujas donde las personas solo ven contenido que confirma sus prejuicios. Piense, por ejemplo, en cómo un feed de Facebook puede estar sesgado hacia un punto de vista político en particular.

"Esta no es una metodología de investigación científica, solo evidencia anecdótica que resalta un fenómeno que parece bastante claro y distinto y fomenta una mayor investigación", dijo Faddoul.