Incidentes Asociados

“En lugar de buscar legisladores en una base de datos de fotos de arrestos, Clearview aparentemente buscó en su propia base de datos de fotos mal ensamblada”, dijo Snow. “Clearview afirmó[ed] que las imágenes de los legisladores estaban presentes en el depósito masivo de escaneos faciales de la compañía. Pero, ¿qué sucede cuando la policía busca a una persona cuya foto no está en la base de datos? ¿Con qué frecuencia el sistema devolverá una coincidencia falsa? ¿Las tasas de error son peores para las personas de color?”

También es atípico que un oficial que investiga un caso tenga una imagen nítida de la cabeza de un sospechoso, como las que Clearview supuestamente usó como información para los legisladores. La herramienta de Clearview está diseñada para usarse en situaciones del mundo real, donde la calidad de la foto, la iluminación y otros factores pueden sesgar el proceso y deben probarse como tales, dijo Snow.

“Si Clearview tiene tanta confianza en su tecnología, debería someter su producto a rigurosas pruebas independientes en entornos de la vida real”, dijo. “Y debería darle al público el derecho de decidir si el gobierno puede usar su producto”.

Ton-That dijo que la prueba del panel independiente ya fue diligente y exhaustiva. “La prueba Clearview ejecutó las mismas fotos que la ACLU, pero contra una base de datos que era más de 100 000 veces más grande”, dijo, y señaló que además de buscar a 535 líderes del Congreso de EE. UU., la tecnología de su empresa se probó con legisladores estatales de Texas. y California. “Con ese mayor nivel de dificultad, Clearview obtuvo un 100 % siguiendo el estándar de la ACLU”.

Los investigadores de reconocimiento facial expresaron serias dudas sobre el informe de Clearview. Si bien el estudio de la ACLU fue efectivo para demostrar las deficiencias de un software de reconocimiento facial, de ninguna manera es una metodología suficiente para evaluar definitivamente la precisión de una herramienta comercial como Clearview AI, Liz O'Sullivan, directora de tecnología del Proyecto de Supervisión de Tecnología de Vigilancia, le dijo a BuzzFeed News. O'Sullivan también cuestionó la afirmación del panel de que la tecnología de Clearview es precisa para "todos los grupos demográficos", dado que el grupo de prueba del estudio de 834 legisladores estatales y federales no es representativo de todas las personas o etnias.

El director ejecutivo de Clearview, Ton-That, no estuvo de acuerdo con esta evaluación. “Los rigores de la prueba han cubierto todos los grupos demográficos que están representados en la población general y han demostrado la precisión de Clearview al buscar entre miles de millones de fotos”, dijo.

El investigador de privacidad y reconocimiento facial Adam Harvey le dijo a BuzzFeed News que es imposible evaluar la precisión del estudio de Clearview sin más información sobre cómo se llevó a cabo. “Este documento no proporciona información suficiente para validar su reclamo”, dijo. "Parece que nadie en el panel tiene experiencia previa con el reconocimiento facial".

El informe de Clearview fue aprobado por un panel de tres personas, que incluía a Jonathan Lippman, juez principal de la Corte de Apelaciones de Nueva York de 2009 a 2015; el Dr. Nicholas Cassimatis, académico y empresario de inteligencia artificial; y Aaron Renn, analista urbano y ex miembro principal del Instituto Manhattan, un grupo de expertos conservador. El panel determinó si las dos coincidencias mejor clasificadas de los resultados de búsqueda de Clearview mostraban a la misma persona en la búsqueda original.

“En octubre de 2019, el Panel que suscribe realizó una prueba de precisión independiente de Clearview AI, una nueva tecnología de comparación de imágenes que funciona como un motor de búsqueda de rostros en Internet”, se lee en el informe.

Ninguno de los panelistas parece tener experiencia en reconocimiento facial. Lippman le dijo a BuzzFeed News que "Richard Schwartz", uno de los cofundadores de la compañía, lo presentó a Clearview, a quien conoce desde la época de Schwartz como editor de la página editorial del New York Daily News. Dijo que no le pagaron por su trabajo en el estudio.

“Supongo que se me acercó debido a mi experiencia como juez en el gobierno y la justicia penal, y al analizar y sopesar la evidencia empírica”, dijo Lippman.

Cassimatis le dijo a BuzzFeed News que había trabajado en inteligencia artificial durante 20 años y señaló su trabajo como profesor en el Instituto Politécnico Rensselaer y como ex "jefe de investigación de IA de América del Norte de Samsung". Dijo que conoció a Ton-That a través de un amigo en común y fue seleccionado “por mi experiencia en este campo”. Cassimatis dijo que no le pagaron por trabajar en el estudio.

Renn no respondió a una solicitud de comentarios. Anteriormente, Ton-That dijo que él y Schwartz se conocieron durante un evento en el Instituto Manhattan, donde Renn se desempeñó como miembro principal hasta el año pasado.

El estudio "ACLU" de Clearview no es la primera vez que la compañía promociona la precisión de su tecnología sin mucho material de apoyo o revisión por pares. El verano pasado, la compañía le dijo al Departamento de Policía de Atlanta en materiales de marketing que [su tecnología tenía una precisión del 98,6 %] (https://www.buzzfeednews.com/article/ryanmac/clearview-ai-nypd-facial-recognition) en una prueba de 1 millón de caras, una tasa de precisión superior a la de las herramientas creadas por Google y el gigante tecnológico chino Tencent. Sin embargo, esa afirmación, que se hizo utilizando el punto de referencia de reconocimiento facial MegaFace de la Universidad de Washington, nunca fue verificada de forma independiente por la universidad o por un tercero, dijo la compañía más tarde a BuzzFeed News. Clearview rechazó una solicitud para que los resultados de esta prueba estén disponibles para su revisión.

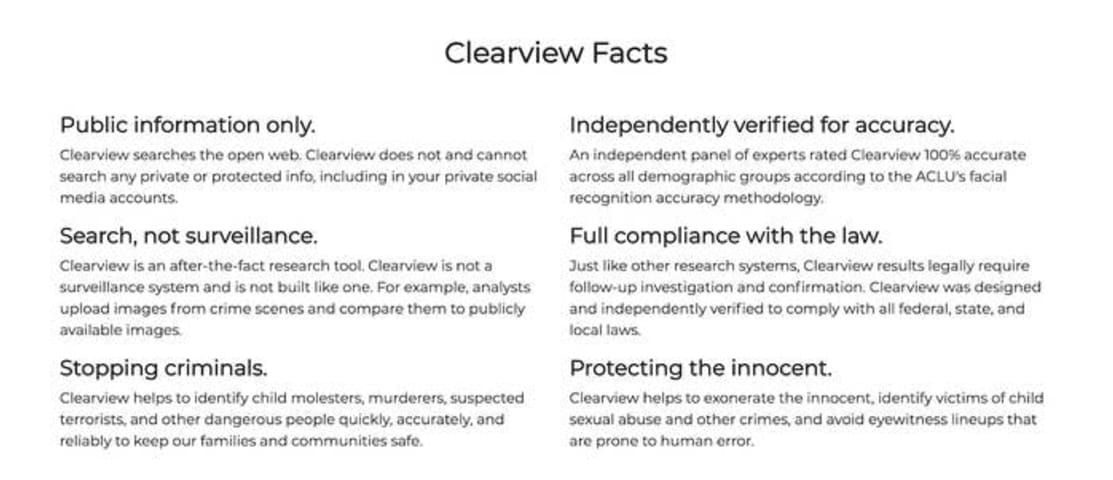

Sin embargo, desde octubre, la compañía parece haberse alejado de la comercialización del número MegaFace y ha seguido adelante con la calificación de precisión del 100% de la prueba basada en ACLU realizada por su panel de tres personas. Después de que se publicaran las primeras noticias sobre la compañía el mes pasado, la compañía agregó una nueva sección a su sitio web, que alguna vez fue escaso, llamada "Clearview Facts", donde dijo que "un panel independiente de expertos calificó a Clearview como 100 % preciso en todos los grupos demográficos según a la metodología de precisión de reconocimiento facial de la ACLU”.

Eso no le cayó bien a la ACLU, que finalmente presentó una denuncia. El 28 de enero, Clearview eliminó el nombre del grupo de derechos civiles de su sitio, aunque aún afirma que “un panel independiente de expertos revisó y certificó Clearview por su precisión y confiabilidad”.

Eso puede no ser suficiente para la ACLU y Snow, quienes dijeron que cualquier prueba de precisión estaba "fuera de lugar".

“La tecnología de Clearview otorga al gobierno un poder sin precedentes para espiarnos dondequiera que vayamos, rastreando nuestros rostros en protestas, reuniones de [Alcohólicos Anónimos], iglesias y más”, dijo. "Precisa o no, la tecnología de Clearview en manos de las fuerzas del orden acabará con la privacidad tal como la conocemos".