Incidentes Asociados

La aseguradora más grande de China, Ping An, aparentemente comenzó a emplear inteligencia artificial para identificar a clientes poco confiables y no rentables. Ofrece un ejemplo escalofriante de cómo, si no tenemos cuidado, podría ser el futuro aquí en los EE. UU.

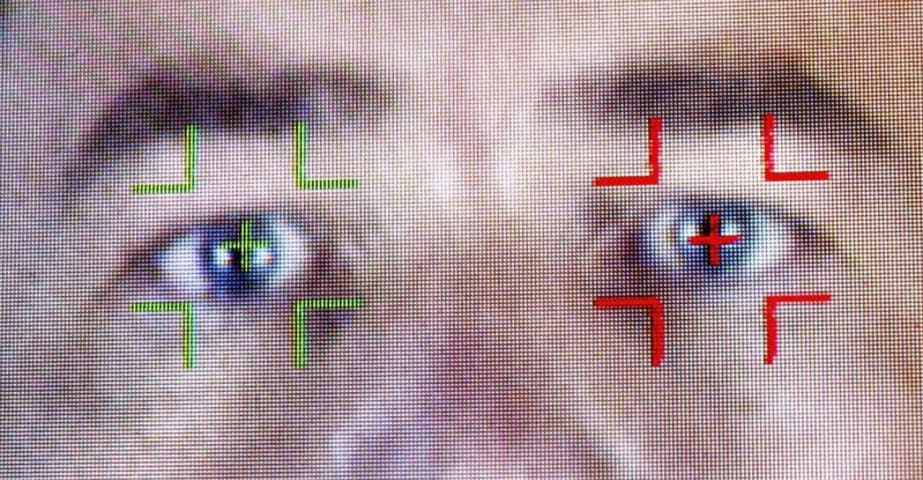

The Wall Street Journal informó que Ping An está utilizando un software de reconocimiento facial para buscar "microexpresiones" en los rostros de las personas para ayudar a decidir si están diciendo la verdad, para asegurarlos y presumiblemente cuáles deberían ser los términos del servicio. En segundo lugar, el software medirá el índice de masa corporal y el bienestar de las personas para determinar las primas del seguro de salud (spoiler: ¡cuesta más si está gordo!).

Si esto no le preocupa, considere mis "preguntas escépticas que todos deberían hacer sobre un nuevo modelo de negocio de IA" de código abierto, que son más o menos así:

-

¿Es posible lo que la IA afirma hacer, dadas las limitaciones de los datos y la tecnología?

-

Si es posible, ¿logrará su objetivo declarado? ¿O simplemente perpetuará el sesgo humano bajo la apariencia de "ciencia", como una versión moderna de la frenología?

-

Asumiendo que es adecuado para su propósito, una gran suposición, honestamente, considerando el mal desempeño de la mayoría de las IA, ¿es ese propósito deseable en sí mismo?

-

¿Socavará la industria para la que fue diseñado?

Evaluemos el reconocimiento facial de Ping An punto por punto. ¿Cómo entrenarías un algoritmo para determinar quién está mintiendo? Una opción es mostrarle un grupo de personas que mienten y dicen la verdad en un entorno de laboratorio. El problema es que las microexpresiones de las personas pueden ser diferentes cuando mienten en un laboratorio, o cuando les pagan por mentir, o cuando mienten por primera vez. Entonces, un algoritmo entrenado en ellos cometería muchos errores en la vida real.

¿Qué tal encontrar imágenes de video de personas que realmente mienten y mostrárselas al algoritmo? El problema aquí es que la mayoría de las mentiras nunca se descubren. Sin mencionar que los buenos mentirosos pueden controlar mejor sus expresiones, o que diferentes tipos de mentiras pueden parecer diferentes. Así que no creo que haya ninguna forma de entrenar el algoritmo de manera efectiva.

Pero tal vez encontrar mentirosos no sea el verdadero objetivo de Ping An. Lo más probable es que realmente estén buscando características de las personas que terminan haciendo reclamos, que es lo que quieren evitar más que el fraude. Lo que nos lleva al segundo punto: ¿El rechazo de tales clientes también tendrá un efecto descomunal en razas o clases de personas específicas?

Más probable. Los pobres y los oprimidos, las personas que viven vidas precarias y con exceso de trabajo, tienden a tener más problemas y, por lo tanto, tienen más reclamaciones de seguros. Y en China, la discriminación humana hace que ciertos grupos étnicos, como los uigures, la minoría musulmana, sean más propensos a ser pobres y oprimidos (tal como sucede con los negros en los EE. UU.). Entonces, un algoritmo entrenado para identificar a los posibles reclamantes también discriminaría a estas personas.

Sin embargo, en cierto sentido, el algoritmo aún podría ser adecuado para su propósito, suponiendo que su propósito sea maximizar las ganancias al evitar clientes costosos, sin restricciones para la equidad o la salud de la comunidad a largo plazo. Entonces, pasando al tercer punto, ¿es deseable ese propósito? Para los creadores de este algoritmo, tal vez. Parecen estar de acuerdo con discriminar a las personas obesas en busca de ganancias, entonces, ¿por qué no también a los pobres y marginados?

No es el tipo de mundo en el que me gustaría habitar, por eso creo que sirve como una advertencia. Aquí en los EE. UU., solo una cosa evita que las compañías de seguros discriminen a grupos específicos de clientes: el requisito, contenido en Obamacare, de que aseguren a todos, enfermos y sanos, por el mismo precio. Esto se hizo sostenible por el llamado mandato individual, que mantuvo el grupo de personas aseguradas lo más grande posible al exigir que todos, incluidos los sanos, compraran un seguro.

Ahora, sin embargo, el Congreso ha derogado efectivamente el mandato individual, y los fiscales generales del estado, junto con la administración Trump, están desafiando el requisito de tomar todo en los tribunales. Esto significa que en un futuro muy cercano, las aseguradoras podrán rechazar a las personas enfermas (o personas que esperan que se enfermen) y aceptar solo a aquellos clientes que no esperan que usen el seguro. Con ese fin, han estado trabajando arduamente en big data e inteligencia artificial para diferenciar a las personas enfermas caras de las personas sanas y baratas.

Los seguros que excluyen a las personas que podrían necesitarlos ya no son seguros. Lo que responde a la cuarta pregunta. Entonces, la peor parte de la terrible IA de Ping An no es que no funcione para su propósito declarado. El peligro real es que podría funcionar demasiado bien.