Incidentes Asociados

¿Alguna vez ha ignorado a un abogado de LinkedIn aparentemente al azar y se ha quedado con la extraña sensación de que algo en el perfil simplemente parecía... fuera de lugar? Bueno, resulta que, en algunos casos, los representantes de ventas que te acosan pueden no ser seres humanos en absoluto. Sí, han llegado deepfakes generados por IA para LinkedIn y les gustaría conectarse.

Eso es según una investigación reciente de Renée DiResta del Observatorio de Internet de Stanford detallada en un informe reciente de NPR. DiResta, que se hizo un nombre a través de torrentes de contenido de desinformación ruso a raíz de las elecciones de 2016, dijo que se dio cuenta de un aparente fenómeno de imágenes de perfil de LinkedIn falsas generadas por computadora con inteligencia artificial después de que una cuenta de aspecto particularmente extraño intentó conectate con ella El usuario, que supuestamente trató de convencer a DiResta de una pieza de software sin importancia, usó una imagen con extrañas incongruencias que le parecieron extrañas para una foto corporativa. En particular, DiResta dice que notó que los ojos de las figuras estaban perfectamente alineados en el medio de la imagen, un signo revelador de imágenes generadas por IA. Siempre miren a los ojos, compañeros humanos.

“La cara me llamó la atención como falsa”, dijo DiResta a NPR.

A partir de ahí, DiResta y su colega de Stanford, Josh Goldstein, llevaron a cabo una investigación que arrojó más de 1000 cuentas de LinkedIn usando imágenes que, según dicen, parecen haber sido creadas por una computadora. Aunque gran parte de la conversación pública sobre las falsificaciones profundas ha advertido sobre el peligroso potencial de la tecnología para la desinformación política, DiResta dijo que las imágenes, en este caso, parecen abrumadoramente diseñadas para funcionar más como lacayos de ventas y estafas. Según se informa, las empresas usan las imágenes falsas para jugar con el sistema de LinkedIn, creando cuentas alternativas para enviar argumentos de venta para evitar toparse con los límites de mensajes de LinkedIn, señala NPR.

“No es una historia de información errónea o desinformación, sino más bien la intersección de un caso de uso comercial bastante mundano con tecnología de inteligencia artificial y las cuestiones resultantes de ética y expectativas”, escribió DiResta en un Tweet. “¿Cuáles son nuestras suposiciones cuando nos encontramos con otros en las redes sociales? ¿Qué acciones cruzan la línea de la manipulación?

En un comunicado enviado a Gizmodo, LinkedIn dijo que había investigado y eliminado cuentas que violaban sus políticas sobre el uso de imágenes falsas.

“Nuestras políticas dejan claro que cada perfil de LinkedIn debe representar a una persona real. Estamos constantemente actualizando nuestras defensas técnicas para identificar mejor los perfiles falsos y eliminarlos de nuestra comunidad, como lo hemos hecho en este caso”, dijo un portavoz de LinkedIn. “Al final del día, se trata de asegurarnos de que nuestros miembros puedan conectarse con personas reales, y estamos enfocados en garantizar que tengan un entorno seguro para hacer precisamente eso”.

Creadores de Deepfake: ¿Dónde está el infierno de desinformación que nos prometieron?

Los expertos en desinformación y los comentaristas políticos advirtieron durante años un tipo de distopía ultrafalsa, pero los resultados en el mundo real, al menos por ahora, han sido menos impresionantes. Internet se cautivó brevemente el año pasado con este video falso de TikTok que presenta a alguien que finge ser Tom Cruise, aunque muchos usuarios pudieron detectar la falta de humanidad de inmediato. Esta y otras falsificaciones profundas populares (como esta supuestamente protagonizada por Jim Carey en El resplandor, o esta que muestra una oficina llena de clones de Michael Scott) presentan un contenido claramente satírico y relativamente inocuo que no parece del todo "Peligro para la democracia". " alarma.

Sin embargo, otros casos recientes han tratado de profundizar en el pantano político. Los videos anteriores, por ejemplo, han demostrado cómo los creadores pudieron manipular un video del expresidente Barack Obama para decir oraciones que en realidad nunca pronunció. Luego, a principios de este mes, un video falso que pretendía mostrar al presidente ucraniano Volodymyr Zelenskyy rindiéndose recorrió las redes sociales. Una vez más, sin embargo, vale la pena señalar que este parecía una mierda. Ver por ti mismo.

Deepfakes, incluso los de tendencia política, definitivamente están aquí, pero las preocupaciones de la sociedad sobre las imágenes atrofiadas aún no se han hecho realidad, un aparente fastidio que deja a algunos post-EE. UU. comentaristas electorales para preguntar: "¿Dónde están los deepfakes en esta elección presidencial?"

Los humanos están empeorando al detectar imágenes falsas

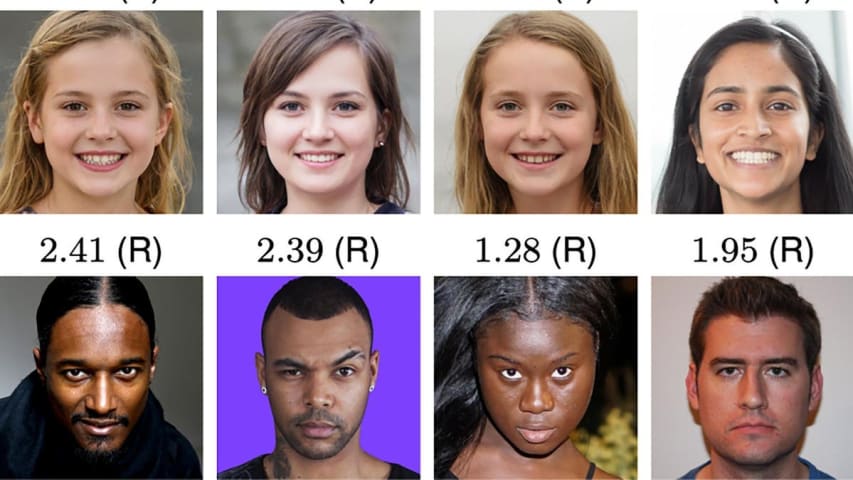

Aún así, hay una buena razón para creer que todo eso podría cambiar... eventualmente. Un estudio reciente publicado en Proceedings of the National Academy of Sciences encontró que los rostros generados por computadora (o "sintetizados") en realidad se consideraban más confiables que las fotografías de personas reales. Para el estudio, los investigadores reunieron 400 caras reales y generaron otras 400 fotografías de rostros extremadamente realistas utilizando redes neuronales. Los investigadores utilizaron 128 de estas imágenes y probaron a un grupo de participantes para ver si podían diferenciar entre una imagen real y una falsa. Se pidió a un grupo separado de encuestados que juzgaran qué tan confiables veían las caras sin insinuar que algunas de las imágenes no eran humanas en absoluto.

Los resultados no son un buen augurio para Team Human. En la primera prueba, los participantes solo pudieron identificar correctamente si una imagen era real o generada por computadora el 48,2% de las veces. Mientras tanto, el grupo de calificación de confiabilidad le dio a los rostros de IA una puntuación de confiabilidad más alta (4.82) que a los rostros humanos (4.48).

“El fácil acceso a imágenes falsas de tan alta calidad ha provocado y seguirá provocando varios problemas, incluidos perfiles falsos en línea más convincentes y, a medida que la generación de audio y video sintético continúa mejorando, problemas de imágenes íntimas no consensuadas, fraude y campañas de desinformación. ”, escribieron los investigadores. “Por lo tanto, alentamos a quienes desarrollan estas tecnologías a considerar si los riesgos asociados son mayores que sus beneficios”.

Vale la pena tomar en serio esos resultados y plantean la posibilidad de cierta incertidumbre pública significativa en torno a las falsificaciones profundas que corren el riesgo de abrir una caja de pandora de nuevas preguntas complicadas sobre la autenticidad, los derechos de autor, la desinformación política y la gran verdad en los años y décadas venideros. .

Sin embargo, a corto plazo, las fuentes más importantes de contenido políticamente problemático pueden no provenir necesariamente de deepfakes altamente avanzados impulsados por IA, sino más bien de las llamadas "falsificaciones baratas" más simples que pueden manipular los medios con un software mucho menos sofisticado, o ninguno en absoluto. Ejemplos de estos incluyen un video viral de 2019 que expone a una Nancy Pelosi supuestamente golpeada arrastrando las palabras (ese video en realidad solo se ralentizó en un 25%) y este de un aspirante a torpe Joe Biden tratando de vender seguros de automóviles estadounidenses. Ese caso fue en realidad solo un hombre que se hizo pasar por la voz del presidente doblada sobre el video real. Si bien esos son tremendamente menos sexys que algunos deepfakes de la cinta de orina de Trump, ambos ganaron una gran cantidad de atención en línea.