Incidentes Asociados

Target no se dio cuenta de que una adolescente estaba embarazada antes que su padre, y ese artículo que decía que sí era tonto y malo.

En 2012, se publicó una historia en el New York Times con el título Cómo las empresas aprenden sus secretos. El artículo analiza, entre otras cosas, cómo y por qué un equipo de marketing de Target intentó construir un modelo para predecir qué compradoras estaban embarazadas. A mitad del artículo, hay una anécdota

Aproximadamente un año después de que Pole creara su modelo de predicción de embarazo, un hombre entró en un Target en las afueras de Minneapolis y exigió ver al gerente. Estaba agarrando cupones que le habían enviado a su hija y estaba enojado, según un empleado que participó en la conversación.

“¡Mi hija recibió esto por correo!” él dijo. “Ella todavía está en la escuela secundaria, ¿y le estás enviando cupones para ropa de bebé y cunas? ¿Estás tratando de animarla a quedar embarazada?

El gerente no tenía idea de lo que estaba hablando el hombre. Miró el correo. Efectivamente, estaba dirigido a la hija del hombre y contenía anuncios de ropa de maternidad, muebles de guardería e imágenes de bebés sonrientes. El gerente se disculpó y luego llamó unos días después para disculparse nuevamente.

Sin embargo, por teléfono, el padre estaba algo avergonzado. “Tuve una conversación con mi hija”, dijo. “Resulta que ha habido algunas actividades en mi casa de las que no he sido completamente consciente. Ella es debido en agosto. Te debo una disculpa."

Poco después de la publicación del artículo inicial, un escritor de tecnología de Forbes destacó esta anécdota en un artículo con el título Cómo Target descubrió que una adolescente estaba embarazada antes que su padre. Aparentemente sabía cómo no enterrar el lede.

A partir de ahí, la historia explotó en la conciencia general a lo grande. Una búsqueda rápida en Twitter de “Hija embarazada objetivo” muestra que la gente todavía habla mucho sobre esta historia más de 7 años después de la publicación inicial del artículo. Generalmente se usa para mostrar cómo se puede usar Big Data para aprender todo sobre nosotros, cómo los usuarios de Facebook, Google y Target del mundo saben más sobre nosotros que los miembros de nuestra propia familia.

Pero la verdad es que esta anécdota y mucho del discurso que la rodea es, si me perdonan el lenguaje, tonto y malo.

Déjame contar las formas.

- Probablemente no sea cierto

No profundizaré en esto ya que en realidad no podemos saberlo, pero la anécdota sobre el padre que llamó a la tienda y habló con el gerente probablemente no sea cierta. No proviene del protagonista estadístico Pole, sino de "un empleado que participó en la conversación", lo que plantea preguntas. ¿Cómo se enteró el autor de esta pieza de esta anécdota? ¿Cuántos objetivos tuvo que visitar para encontrar a un empleado que había tenido una conversación como esta? ¿Cómo determina que el incidente ocurrió "alrededor de un año después de que Pole creara su modelo de predicción de embarazo" y, lo que es más importante, cómo determina que el libro de cupones se envió a la niña debido al modelo? El escritor de Forbes que repite la anécdota incluso la describe como “tan buena que suena inventada”. Por cierto.

Pero esta es una crítica fácil y no viene al caso, así que por el resto de este artículo, supongamos que la anécdota es cierta.

- No hay ningún sentido significativo en el que esta anécdota muestre que el algoritmo de Target predijo que la niña estaba embarazada

Esta historia pretende mostrar que la operación Big Data de Target y, además, las operaciones Big Data de todos los gigantes minoristas y tecnológicos con los que interactuamos, hacen predicciones sobre detalles íntimos de nuestras vidas con una precisión asombrosa.

Pero, ¿qué muestra realmente? Una niña recibió un libro de cupones con artículos de maternidad. Target probablemente envió muchos libros de cupones similares a muchas personas. Si Target simplemente enviara libros de cupones de maternidad completamente al azar, este escenario exacto aún podría haber sucedido; algunos de los libros de cupones asignados al azar ciertamente llegarían a las mujeres embarazadas por casualidad, y algunas de esas mujeres embarazadas podrían haber tenido padres que no sabían que estaban embarazadas, y uno de esos padres podría haber ido a una tienda a quejarse.

Esta historia ni siquiera muestra que Target trató de averiguar si la niña estaba embarazada. Solo muestra que recibió un folleto que contenía algunos artículos de maternidad y su extraño padre se asustó y quería hablar con el gerente. No hay forma de saber si el volante llegó como resultado de algún algoritmo de orientación complejo que dedujo correctamente que la niña estaba embarazada porque compró un montón de loción, o si simplemente tenían una oferta de pañales esa semana y enviaron un volante al respecto a todos sus clientes.

- Incluso si el algoritmo de Target predijo que esta chica estaba embarazada, la anécdota no muestra nada sobre cuán bueno es el algoritmo para predecir el embarazo.

El artículo de Forbes afirma que esta historia "transmite cuán inquietantemente precisa es la orientación", pero de hecho no muestra exactamente qué tan precisa es la orientación de Target; solo muestra que la orientación funcionó al menos una vez.

"Precisión" es un término técnico en el aprendizaje automático. La precisión de un algoritmo es la fracción de veces que el algoritmo es correcto del número total de predicciones que hace. Claramente, una sola anécdota no puede decirnos nada sobre la precisión de un algoritmo. Entonces, ¿por qué el escritor de Forbes cree que esta historia demuestra una precisión inquietante?

Hay una falacia que he notado en una gran cantidad de escritos populares sobre IA. Lo llamaré la falacia sobrehumana. La falacia sobrehumana dice que si un algoritmo predice correctamente un caso en el que un humano, especialmente un experto, se equivocó, entonces el algoritmo debe hacer predicciones más precisas que el humano en promedio. Por supuesto, esto no sigue en absoluto. Generalmente, los humanos y los algoritmos cometerán diferentes tipos de errores. Los humanos pueden ser un poco peores que los autos sin conductor para permanecer en el centro del carril, pero son mucho mejores para detectar un camión de bomberos detenido en el medio de la carretera. El conjunto de errores que cometen es diferente, y hacemos cualquier afirmación sobre el rendimiento relativo de humanos y máquinas al observar un solo ejemplo.

¿Cuántas clientas embarazadas de Target no recibieron los cupones? Realmente no hay forma de saberlo, porque los padres de las niñas embarazadas que no recibieron cupones nunca tuvieron la oportunidad de quejarse ante el gerente de su Target local. Esa pregunta es exactamente para lo que necesitaríamos la respuesta si quisiéramos saber si el algoritmo era "inquietantemente preciso".

¿Por qué estoy escribiendo sobre una publicación de blog aleatoria de Forbes de 2012?

Probablemente me equivoque, pero por lo que puedo recordar, la historia de que Target descubrió que la niña estaba embarazada fue la primera gran historia en toda una década de historias en las que un algoritmo era el tema de la historia. Los escritores no solían escribir sobre algoritmos. Escribieron sobre personas, lugares, cosas físicas y sistemas, pero no tanto sobre algoritmos. Pero esta historia en 2012 lanzó la idea a la conciencia pública de que las empresas pueden crear algoritmos que pueden diagnosticar, resolver, predecir el futuro y, en general, modelar la situación humana mejor que los humanos.

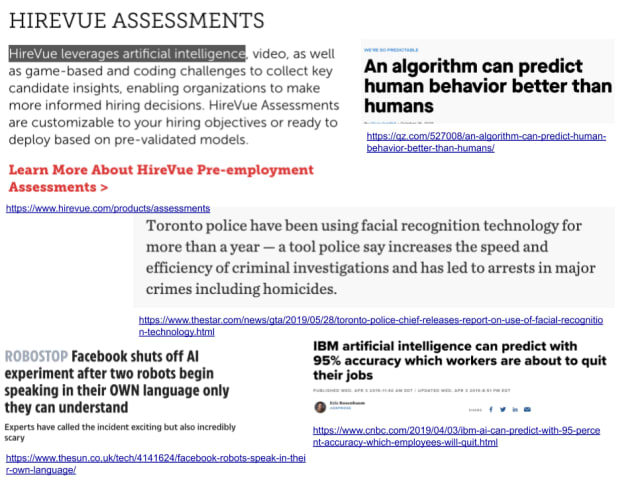

Esto ha llevado a una ola extrema de confianza en la eficacia de los algoritmos (cualesquiera que sean) o la IA en general para resolver las cosas. Los algoritmos, dice la narrativa, ahora son mejores que los humanos para determinar si estás embarazada, si estás a punto de renunciar a tu trabajo o si cometerás un delito si te dejan salir de prisión.

Pero muchos algoritmos en realidad simplemente apestan. Un secreto poco conocido es que es muy difícil incluso para los expertos construir, producir y mantener un algoritmo que haga predicciones precisas sobre cualquier cosa, y mucho menos sobre el comportamiento humano, y a pesar de lo que ha escuchado, la mayoría de las empresas generalmente no están haciendo un buen trabajo. de eso Y es aún más difícil construir estos algoritmos de manera que no incorporen y amplifiquen los sistemas de discriminación y opresión.

Nuestro discurso popular no tiene el vocabulario para distinguir entre algoritmos útiles de aprendizaje automático y aceite de serpiente [advertencia en pdf], por lo que terminamos escribiendo sobre IA en términos de anécdotas y somos víctimas de la falacia sobrehumana. Así es como terminamos con cosas como policías arrestando a personas sobre la base de técnicas de reconocimiento facial que tienen éxito menos del 10% de las veces.

Afortunadamente, tal vocabulario existe. Los profesionales que construyen estos sistemas de IA se preocupan mucho por caracterizar su eficacia y han desarrollado innumerables formas de describirla. Y mucho de esto no es tan difícil de entender para un laico: hay algunas preguntas simples que el autor de la historia podría haber hecho para demostrar la efectividad (o la falta de ella) del algoritmo de embarazo.

De todas las predicciones que hizo el algoritmo, ¿con qué frecuencia acertó? Esta es la precisión del algoritmo.

Cuando el algoritmo predijo que una mujer estaba embarazada, ¿con qué frecuencia se equivocó? Esta es la tasa de falsos positivos del algoritmo.

Cuando el algoritmo predijo que una mujer no estaba embarazada, ¿con qué frecuencia se equivocó? Esta es la tasa de falsos negativos del algoritmo.

Cuando el algoritmo predijo que una mujer estaba embarazada, ¿con qué frecuencia acertó? Esta es la precisión del algoritmo.

De todas las mujeres embarazadas en la base de datos de Target, ¿cuántas encontró el algoritmo? Esta es la recuperación del algoritmo.

No es necesario responder a todas estas preguntas en cada parte (de hecho, algunas de ellas se pueden derivar de las respuestas a las otras), pero algunas deberían serlo si desea tener alguna esperanza de caracterizar si el algoritmo es bueno. . Pero, por lo general, este tipo de estadísticas no se mencionan en absoluto en este nuevo género de escritura sobre algoritmos (si se menciona alguno, suele ser la precisión, que posiblemente sea la menos informativa).

Supongo que hay esperanza. Hay otras cosas de las que hablamos en términos de métricas ampliamente entendidas y acordadas. El deporte es grande. Sabemos que una sola anécdota generalmente no transmite nada útil sobre la contribución de un atleta a un deporte, y para la mayoría de los deportes hay algunas métricas que entendemos son buenas descriptoras del desempeño de un atleta. Un artículo sobre la temporada 2019-2020 de LeBron no estaría completo sin mencionar que tiene un promedio de 25–8–11 en su temporada número 17. Esas métricas no cuentan la historia completa de su temporada, y tampoco las que propongo arriba sobre un algoritmo, pero cuentan mucho más de la historia que una sola anécdota.

Pero incluso si mi sueño utópico en el que cada artículo de noticias sobre un algoritmo incluye un resumen detallado de su estrategia de validación y estadísticas nunca se hace realidad, aún nos vendría bien una buena dosis de escepticismo sobre lo que estos algoritmos pueden hacer. Lo crea o no, lo que el aprendizaje automático puede hacer de manera confiable en 2020 sigue siendo muy, muy limitado. Nos hemos vuelto bastante buenos en cosas como leer texto o clasificar imágenes, pero todavía somos muy malos en cosas como comprender y predecir el comportamiento humano; de hecho, es posible que nunca seamos buenos en eso. Entonces, cuando una persona o una empresa con algo que vender afirma que puede predecir quién está embarazada o quién dejará su trabajo o quién irá a la cárcel, nuestra primera reacción no debería ser renunciar a nuestros jefes supremos de robots, sino preguntarles. para demostrar que funciona con algo mejor que una sola anécdota.