Incidentes Asociados

Los algoritmos de la empresa francesa Idemia escanean rostros por millones. El software de reconocimiento facial de la empresa sirve a la policía de EE. UU., Australia y Francia. El software de Idemia compara los rostros de algunos pasajeros de cruceros que aterrizan en los EE. UU. con los registros de Aduanas y Protección Fronteriza. En 2017, un alto funcionario del FBI le dijo al Congreso que un sistema de reconocimiento facial que rastrea 30 millones de fotografías policiales utilizando la tecnología Idemia ayuda a “salvaguardar al pueblo estadounidense”.

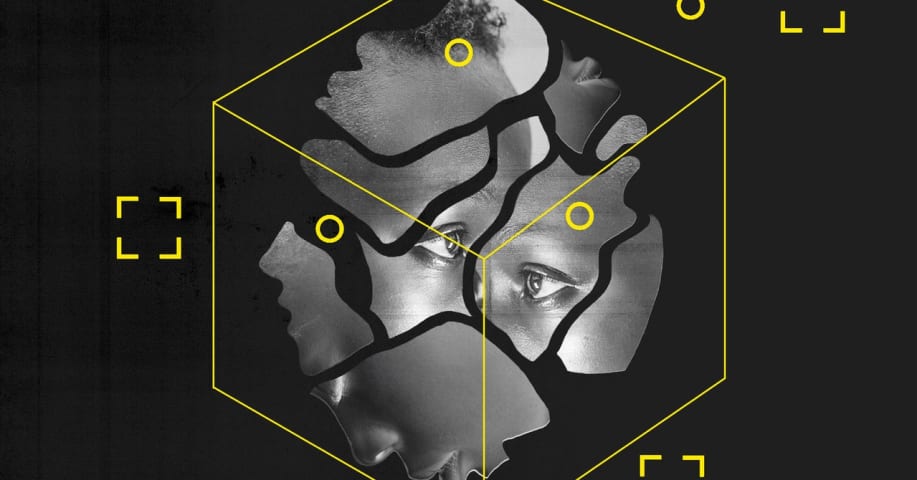

Pero los algoritmos de Idemia no siempre ven todas las caras con la misma claridad. Los resultados de las pruebas de julio del Instituto Nacional de Estándares y Tecnología indicaron que dos de los últimos algoritmos de Idemia tenían muchas más probabilidades de mezclar rostros de mujeres negras que de mujeres blancas o de hombres negros o blancos.

La prueba del NIST desafió a los algoritmos para verificar que dos fotos mostraran el mismo rostro, de manera similar a como un agente fronterizo revisaría los pasaportes. En los ajustes de sensibilidad en los que los algoritmos de Idemia coincidieron falsamente con diferentes rostros de mujeres blancas a una tasa de uno en 10 000, coincidieron falsamente con rostros de mujeres negras aproximadamente una vez en 1000, 10 veces más frecuentemente. A menudo se usa una tasa de coincidencia falsa de uno en 10,000 para evaluar los sistemas de reconocimiento facial.

Donnie Scott, quien dirige la división de seguridad pública de EE. UU. en Idemia, anteriormente conocida como Morpho, dice que los algoritmos probados por NIST no se han lanzado comercialmente y que la compañía verifica las diferencias demográficas durante el desarrollo del producto. Él dice que los diferentes resultados probablemente provinieron de ingenieros que impulsaron su tecnología para obtener la mejor precisión general en las pruebas observadas de cerca por el NIST. “Hay diferencias físicas en las personas y los algoritmos mejorarán en diferentes personas a diferentes ritmos”, dice.

Los algoritmos de visión por computadora nunca han sido tan buenos para distinguir rostros humanos. El NIST dijo el año pasado que los mejores algoritmos mejoraron 25 veces en la búsqueda de una persona en una gran base de datos entre 2010 y 2018, y fallaron una coincidencia verdadera solo el 0,2 por ciento de las veces. Eso ayudó a impulsar el uso generalizado en el gobierno, el comercio y dispositivos como el iPhone.

Pero las pruebas de NIST y otros estudios han encontrado repetidamente que los algoritmos tienen más dificultades para reconocer a las personas con piel más oscura. El informe de julio de la agencia cubrió pruebas de código de más de 50 empresas. Muchos de los mejores en ese informe muestran brechas de rendimiento similares a la diferencia de 10 veces de Idemia en la tasa de error para mujeres blancas y negras. El NIST ha publicado los resultados de las pruebas demográficas de los algoritmos de reconocimiento facial desde principios de 2017. También ha descubierto sistemáticamente que funcionan peor para las mujeres que para los hombres, un efecto que se cree que se debe, al menos en parte, al uso de maquillaje.

"Los hombres blancos... es el grupo demográfico que suele dar la FMR más baja" o tasa de coincidencias falsas, afirma el informe. "Las mujeres negras... es el grupo demográfico que suele dar la FMR más alta". NIST planea un informe detallado este otoño sobre cómo funciona la tecnología en diferentes grupos demográficos.

Los estudios del NIST se consideran el estándar de oro para evaluar los algoritmos de reconocimiento facial. Las empresas que lo hacen bien utilizan los resultados para la comercialización. Las empresas chinas y rusas han tendido a dominar las clasificaciones de precisión general y promocionan sus resultados NIST para ganar negocios en casa. Idemia emitió un comunicado de prensa en marzo alardeando de que se desempeñó mejor que sus competidores en los contratos federales de EE. UU.

Es más probable que muchos algoritmos de reconocimiento facial mezclen caras negras que caras blancas. Cada gráfico representa un algoritmo diferente probado por el Instituto Nacional de Estándares y Tecnología. Aquellos con una línea roja sólida en la parte superior coinciden incorrectamente con los rostros de las mujeres negras más que otros grupos. NIST

El Departamento de Seguridad Nacional también descubrió que la piel más oscura desafía el reconocimiento facial comercial. En febrero, el personal del DHS publicó los resultados de las pruebas de 11 sistemas comerciales diseñados para verificar la identidad de una persona, como en un punto de control de seguridad del aeropuerto. A los sujetos de prueba se les midió el pigmento de la piel. Los sistemas que se probaron generalmente tardaron más en procesar a las personas con piel más oscura y fueron menos precisos para identificarlos, aunque algunos proveedores se desempeñaron mejor que otros. El organismo de control interno de la privacidad de la agencia ha dicho que el DHS debería informar públicamente el desempeño de sus sistemas de reconocimiento facial implementados, como los que se encuentran en pruebas en aeropuertos, en diferentes grupos raciales y étnicos.

Los informes del gobierno se hacen eco de estudios críticos de 2018 de investigadores de ACLU y MIT que desconfían abiertamente de la tecnología. Informaron que los algoritmos de Amazon, Microsoft e IBM eran menos precisos en pieles más oscuras.