Incidentes Asociados

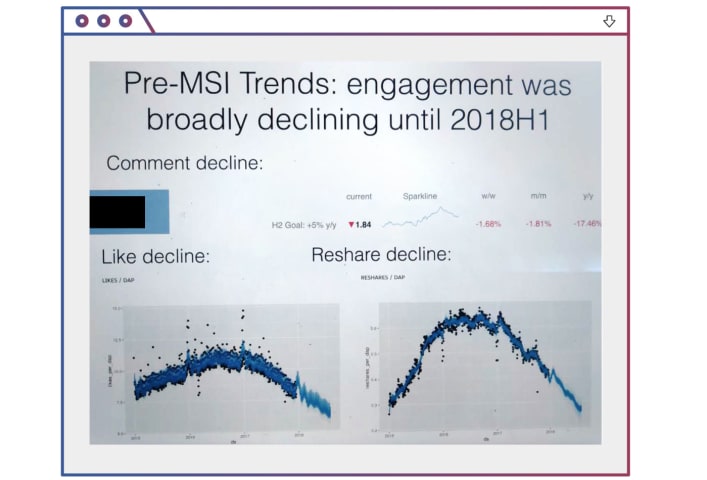

En el otoño de 2018, Jonah Peretti, director ejecutivo de la editorial en línea BuzzFeed, envió un correo electrónico a un alto funcionario de Facebook Inc. El contenido más divisivo producido por las editoriales se estaba volviendo viral en la plataforma, dijo, creando un incentivo para producir más. Señaló el éxito de una publicación de BuzzFeed titulada "21 cosas que casi todas las personas blancas son culpables de decir", que recibió 13 000 acciones y 16 000 comentarios en Facebook, muchos de personas que criticaban a BuzzFeed por escribirlo y discutían entre ellos sobre la raza. . Otro contenido producido por la compañía, desde videos de noticias hasta artículos sobre el cuidado personal y los animales, tuvo problemas para abrirse paso, dijo. El Sr. Peretti culpó a una revisión importante que Facebook había hecho a su algoritmo News Feed a principios de ese año para impulsar las “interacciones sociales significativas” o MSI, entre amigos y familiares, según documentos internos de Facebook revisados por The Wall Street Journal que citan el correo electrónico. BuzzFeed basó su negocio en la creación de contenido que se volvería viral en Facebook y otras redes sociales, por lo que tenía un interés personal en cualquier cambio de algoritmo que perjudicara su distribución. Aun así, el correo electrónico de Peretti tocó un nervio. El director ejecutivo de Facebook, Mark Zuckerberg, dijo que el objetivo del cambio de algoritmo era fortalecer los lazos entre los usuarios y mejorar su bienestar. Facebook alentaría a las personas a interactuar más con amigos y familiares y a pasar menos tiempo consumiendo pasivamente contenido producido profesionalmente, que según las investigaciones era dañino para su salud mental. Sin embargo, dentro de la empresa, los empleados advirtieron que el cambio estaba teniendo el efecto contrario, según muestran los documentos. Estaba haciendo de la plataforma de Facebook un lugar más enojado. Los investigadores de la empresa descubrieron que los editores y los partidos políticos estaban reorientando sus publicaciones hacia la indignación y el sensacionalismo. Esa táctica produjo altos niveles de comentarios y reacciones que se tradujeron en éxito en Facebook. “Nuestro enfoque ha tenido efectos secundarios nocivos para la salud en sectores importantes del contenido público, como la política y las noticias”, escribió un equipo de científicos de datos, señalando las quejas de Peretti, en un memorando revisado por el Journal. “Esta es una responsabilidad cada vez mayor”, escribió uno de ellos en un memorando posterior. Llegaron a la conclusión de que la gran ponderación del nuevo algoritmo del material compartido en su News Feed hizo que las voces enojadas se hicieran más fuertes. “La desinformación, la toxicidad y el contenido violento prevalecen desmesuradamente entre los compartidos”, señalaron los investigadores en memorandos internos. Algunos partidos políticos en Europa le dijeron a Facebook que el algoritmo les había hecho cambiar sus posiciones políticas para que resonaran más en la plataforma, según los documentos. “Muchos partidos, incluidos los que se han vuelto negativos, se preocupan por los efectos a largo plazo en la democracia”, decía un informe interno de Facebook, que no nombraba a partidos específicos. Los empleados de Facebook también discutieron el otro motivo menos publicitado de la compañía para hacer el cambio: los usuarios habían comenzado a interactuar menos con la plataforma, una tendencia preocupante, según muestran los documentos. El correo electrónico y los memorandos son parte de una amplia gama de comunicaciones internas de la empresa revisadas por el Journal. Ofrecen una mirada inigualable de cuánto sabe Facebook sobre las fallas en su plataforma y cómo a menudo carece de la voluntad o la capacidad para abordarlas. Este es el tercero de una serie de artículos basados en esa información. En una entrevista, Lars Backstrom, vicepresidente de ingeniería de Facebook, dijo que cualquier algoritmo corre el riesgo de promover contenido que es objetable o dañino para algunos usuarios. “Al igual que cualquier optimización, habrá algunas formas en que se explote o se aproveche”, dijo. “Es por eso que tenemos un equipo de integridad que está tratando de rastrearlos y descubrir cómo mitigarlos de la manera más eficiente posible”. Los científicos de datos en ese equipo de integridad, cuyo trabajo es mejorar la calidad y la confiabilidad del contenido en la plataforma, trabajaron en una serie de cambios potenciales para frenar la tendencia del algoritmo revisado de recompensar la indignación y las mentiras. Zuckerberg se resistió a algunas de las soluciones propuestas, según muestran los documentos, porque le preocupaba que pudieran dañar el otro objetivo de la empresa: hacer que los usuarios interactúen más con Facebook. Anna Stepanov, quien dirigió un equipo que abordó esos problemas, le presentó a Zuckerberg varios cambios propuestos destinados a abordar la proliferación de contenido falso y divisivo en la plataforma, según un memorando interno de abril de 2020 que escribió sobre la sesión informativa. Uno de esos cambios habría quitado el impulso que el algoritmo le dio al contenido que probablemente sería compartido por largas cadenas de usuarios. “Mark no cree que podamos extendernos” con el cambio, escribió a sus colegas después de la reunión. Zuckerberg dijo que estaba abierto a probar el enfoque, dijo, pero "no lo lanzaríamos si hubiera una compensación material con el impacto de MSI". El mes pasado, casi un año y medio después de que Stepanov dijera que Zuckerberg rechazó la idea de incorporar ampliamente una solución similar, Facebook anunció que estaba “expandiendo gradualmente algunas pruebas para poner menos énfasis en señales como la probabilidad de que alguien comente o compartir contenido político”. La medida es parte de un impulso más amplio, impulsado por encuestas de usuarios, para reducir la cantidad de contenido político en Facebook después de que la compañía fuera criticada por la forma en que los manifestantes electorales usaron la plataforma para cuestionar los resultados y organizar protestas que llevaron al 1 de enero. 6 disturbios en el Capitolio en Washington. El Sr. Backstrom, que supervisa la clasificación de contenido en News Feed, dijo que Facebook hizo el cambio reciente porque sintió que las desventajas de confiar en métricas basadas en el compromiso para categorías de contenido sensible como la política superaban los beneficios. El cambio de algoritmo de 2018 afectó la característica central de Facebook, el News Feed, un desplazamiento personalizado y constantemente actualizado de fotos familiares de amigos y enlaces a noticias. Representa la mayor parte del tiempo que los casi tres mil millones de usuarios de Facebook pasan en la plataforma. La empresa vende la atención de los usuarios a los anunciantes, tanto en Facebook como en su plataforma hermana Instagram, lo que representa casi la totalidad de sus ingresos de 86.000 millones de dólares el año pasado. Un algoritmo patentado controla lo que aparece en el News Feed de cada usuario. Tiene en cuenta de quiénes son amigos los usuarios, a qué tipo de grupos se han unido, qué páginas les han gustado, qué anunciantes han pagado para dirigirse a ellos y qué tipos de historias son populares o generan conversación. Los cambios significativos en el algoritmo pueden tener importantes implicaciones para la empresa, los anunciantes y los editores. Facebook ha realizado muchos ajustes de algoritmo a lo largo de los años. El cambio para enfatizar MSI fue uno de los más grandes. “¿Es un cambio de clasificación la fuente de las divisiones del mundo? No”, dijo el portavoz de Facebook, Andy Stone, en una declaración escrita. “La investigación muestra que ciertas divisiones partidistas en nuestra sociedad han estado creciendo durante muchas décadas, mucho antes de que existieran plataformas como Facebook”. News Corp, propietaria de The Wall Street Journal, tiene un acuerdo comercial para suministrar noticias a través de Facebook. 'Lo correcto' En enero de 2018, Facebook venía de un año difícil. Estaba a la defensiva en Washington sobre lo que los funcionarios de inteligencia de EE. UU. dijeron que era el uso de la plataforma por parte de Rusia para entrometerse en las elecciones presidenciales de EE. UU. de 2016. Zuckerberg anunció que estaba cambiando el objetivo de los gerentes de producto de Facebook de ayudar a las personas a encontrar contenido relevante a ayudarlos a interactuar más con amigos y familiares. Dijo que el cambio fue impulsado por una investigación que mostraba que el consumo pasivo de medios en Facebook, en particular el video, que se había disparado en la plataforma, no era tan bueno para el bienestar como la interacción con otras personas. Enmarcó el cambio como un sacrificio. “Ahora, quiero ser claro: al hacer estos cambios, espero que el tiempo que la gente pasa en Facebook y algunas medidas de participación disminuyan”, escribió en Facebook. “Pero también espero que el tiempo que pases en Facebook sea más valioso. Y si hacemos lo correcto, creo que eso también será bueno para nuestra comunidad y nuestro negocio a largo plazo”. Los videos de capacitación y los memorandos internos de Facebook muestran otra razón para el cambio: la creciente preocupación de la empresa por una disminución en la participación de los usuarios, que generalmente se refiere a acciones como comentar o compartir publicaciones. El compromiso se considera dentro de la empresa como una señal importante para la salud del negocio. Los comentarios, los "me gusta" y las veces que se comparte disminuyeron durante 2017, mientras que las publicaciones de "transmisión original" (el párrafo y la foto que una persona podría publicar cuando muere un perro) continuaron un declive de un año que ninguna intervención parecía capaz de detener, según los memorandos internos. El temor era que eventualmente los usuarios dejaran de usar Facebook por completo. Un científico de datos dijo en un memorando de 2020 que los equipos de Facebook estudiaron el problema y "nunca descubrieron realmente por qué disminuyeron las métricas". Los miembros del equipo finalmente concluyeron que la prevalencia de videos y otro contenido producido profesionalmente, en lugar de publicaciones orgánicas de individuos, probablemente era parte del problema. El objetivo del cambio de algoritmo era revertir la disminución de los comentarios y otras formas de participación, y fomentar publicaciones más originales. Recompensaría las publicaciones que obtuvieran más comentarios y emojis de emociones, que se consideraron más significativos que los me gusta, según muestran los documentos. En un video de capacitación interna, un empleado de Facebook dijo que además del “deber ético” de la empresa de no convertir a los usuarios en zombis con demasiados videos, tenía razones comerciales para intervenir. “La gente probablemente dejará la aplicación si es mala para ellos”, dijo el empleado. Clasificación de recomparticiones La solución de Facebook fue crear una fórmula que medía cuánta interacción "significativa" generaba una publicación, y luego organizar el News Feed para fomentar la mayor cantidad posible de eso. Bajo un sistema de puntos interno utilizado para medir su éxito, un "me gusta" valía un punto; una reacción, compartir sin texto o responder a una invitación valía cinco puntos; y un comentario significativo, mensaje, compartir o RSVP, 30 puntos. Se agregaron multiplicadores adicionales dependiendo de si la interacción era entre miembros de un grupo, amigos o extraños. Desde una perspectiva comercial, funcionó. Como predijo Facebook, el tiempo dedicado a la plataforma disminuyó, pero el esfuerzo por maximizar las interacciones entre los usuarios ralentizó la caída libre de los comentarios y, en su mayoría, mejoró la importante métrica de "personas activas diariamente" que usan Facebook, según las pruebas realizadas en agosto de 2018. , muestran notas internas. El cambio tuvo algunos efectos positivos. El contenido compartido por conexiones cercanas era más confiable y los usuarios lo encontraron más significativo que el material de conocidos más distantes, según un memorando. Pero esos beneficios se vieron superados por el aspecto del cambio de algoritmo que favorecía las acciones de los usuarios, como compartir y comentar. Como Facebook había advertido que era probable, el cambio perjudicó a muchos editores en línea. En la primera mitad de 2018, BuzzFeed sufrió una disminución del 13 % en el tráfico en comparación con los seis meses anteriores, Breitbart perdió un 46 % y ABC News perdió un 12 %, según la firma de datos en línea Comscore. Topix, un sitio de noticias conocido por los foros de la comunidad local, perdió el 53% de su tráfico durante ese período. “Facebook era nuestro principal impulsor de tráfico en ese momento”, dijo Chris Tolles, exdirector ejecutivo de Topix. “Eso fue ciertamente un problema para nosotros”. Publishers Clearing House compró Topix en 2019. "La clasificación MSI en realidad no es contenido gratificante que impulsa interacciones sociales significativas". — El CEO de Buzzfeed, Jonah Peretti, en un correo electrónico al funcionario de Facebook En entrevistas, más de una docena de ejecutivos editoriales describieron el cambio de Facebook como la gota que colmó el vaso después de varios años de políticas en constante cambio que los convencieron de que no podían confiar en Facebook para el tráfico. BuzzFeed saltó a la fama en las confecciones de Internet como listas y cuestionarios, pero a lo largo de los años construyó una sólida operación de noticias y se expandió agresivamente al video. Históricamente, Facebook ha sido una fuente importante de tráfico para BuzzFeed, aunque el editor ha diversificado su distribución en los últimos años. El Sr. Peretti de Buzzfeed, en su correo electrónico, escribió que el nuevo algoritmo parecía estar recompensando desproporcionadamente la división, según lo que el editor vio en sus propios números y sus observaciones sobre el rendimiento de las publicaciones de otros editores. “La clasificación de MSI en realidad no es un contenido gratificante que genere interacciones sociales significativas”, escribió Peretti en su correo electrónico al funcionario de Facebook, y agregó que su personal sintió “presión para crear contenido deficiente o tener un rendimiento inferior”. No era solo material que explotaba las divisiones raciales, escribió, sino también "ciencia de moda/basura", "noticias extremadamente inquietantes" e imágenes groseras. Efecto político En Polonia, los cambios hicieron que el debate político en la plataforma fuera más desagradable, dijeron los partidos políticos polacos a la empresa, según los documentos. Los documentos no especifican qué partes. “El equipo de gestión de redes sociales de un partido estima que han cambiado la proporción de sus publicaciones de 50/50 positivas/negativas a 80 % negativas, explícitamente como una función del cambio en el algoritmo”, escribieron dos investigadores de Facebook en un informe interno de abril de 2019. reporte. La participación en publicaciones positivas y de políticas se ha reducido drásticamente, lo que ha dejado a los partidos cada vez más dependientes de publicaciones incendiarias y ataques directos a sus competidores. Nina Jankowicz, quien estudia las redes sociales y la democracia en Europa Central y del Este como becaria en el Centro Woodrow Wilson en Washington, dijo que escuchó quejas de muchos partidos políticos en esa región de que el cambio de algoritmo hizo que la comunicación directa con sus seguidores a través de las páginas de Facebook. más difícil. Ahora tienen un incentivo, dijo, para crear publicaciones que acumulen comentarios y se compartan, a menudo aprovechando la ira, para exponerse en las noticias de los usuarios. Los investigadores de Facebook escribieron en su informe que en España, los partidos políticos ejecutan operaciones sofisticadas para hacer que las publicaciones de Facebook viajen lo más lejos y rápido posible. “Han aprendido que los duros ataques a sus oponentes generan el mayor compromiso”, escribieron. “Afirman que 'intentan no hacerlo', pero al final 'usan lo que funciona'”. En los 15 meses posteriores a los enfrentamientos de otoño de 2017 en España por el separatismo catalán, el porcentaje de insultos y amenazas en las páginas públicas de Facebook relacionadas con temas sociales y políticos El debate en España aumentó un 43%, según una investigación realizada por Constella Intelligence, una firma de protección de riesgos digitales. Los investigadores de Facebook escribieron en su informe interno que escucharon quejas similares de partidos en Taiwán e India. Brad Parscale, quien fue el líder de estrategia digital para la campaña presidencial de Donald Trump en 2016 y se jactó de que Facebook es donde Trump ganó las elecciones, dijo que comenzó a notar cambios en el algoritmo a mediados de 2017, cuando el desempeño de los políticos los videos comenzaron a disminuir. "'Saludable' es una palabra de portada para 'Necesitamos reducir la difusión de videos conservadores y de Trump'", dijo en una entrevista para este artículo. La presidenta del Comité Nacional Republicano, Ronna McDaniel, el entonces líder de la mayoría en la Cámara de Representantes, Kevin McCarthy (R., California), y el Sr. Parscale se reunieron con ejecutivos de Facebook en junio de 2018 para registrar sus quejas. En esa reunión, en la que participó el jefe de políticas públicas globales de Facebook, Joel Kaplan, se les dijo a los republicanos que los cambios en el algoritmo estaban destinados a contrarrestar la propagación de lo que la empresa consideraba información errónea, según Parscale. Arreglos propuestos En abril de 2019, un científico de datos de Facebook propuso reducir la propagación de "compartir en profundidad", lo que significa que el espectador no es amigo ni seguidor del cartel original, según un memorando interno. “Si bien la plataforma FB ofrece a las personas la oportunidad de conectarse, compartir y participar, un efecto secundario desafortunado es que el contenido dañino y desinformativo puede volverse viral, a menudo antes de que podamos detectarlo y mitigar sus efectos”, escribió. “Los operadores políticos y los editores nos dicen que confían más en la negatividad y el sensacionalismo para la distribución debido a los cambios algorítmicos recientes que favorecen las acciones compartidas”. Más tarde, los científicos de datos de Facebook se concentraron en un aspecto del algoritmo renovado llamado "MSI descendente", que aumentaba la probabilidad de que una publicación apareciera en la sección de noticias de un usuario si el algoritmo calculaba que era probable que las personas la compartieran o la comentaran a medida que se transmitía. la cadena de acciones compartidas. Las primeras pruebas mostraron cómo la reducción de ese aspecto del algoritmo para la información cívica y de salud ayudó a reducir la proliferación de contenido falso. Facebook hizo el cambio para esas categorías en la primavera de 2020. Cuando la Sra. Stepanov le presentó al Sr. Zuckerberg la propuesta del equipo de integridad para expandir ese cambio más allá del contenido cívico y de salud, y algunos países como Etiopía y Myanmar donde ya se estaban realizando cambios hecho—Sr. Zuckerberg dijo que no quería seguir adelante si reducía la participación de los usuarios, según los documentos. James Barnes, un exempleado de Facebook que se fue en 2019, dijo que Facebook esperaba que dar prioridad a la participación de los usuarios en la sección de noticias acercaría a las personas. Pero la plataforma se había vuelto tan compleja que la compañía no entendía cómo el cambio podría ser contraproducente. “No hay balas de plata fáciles”, dijo.