Incidentes Asociados

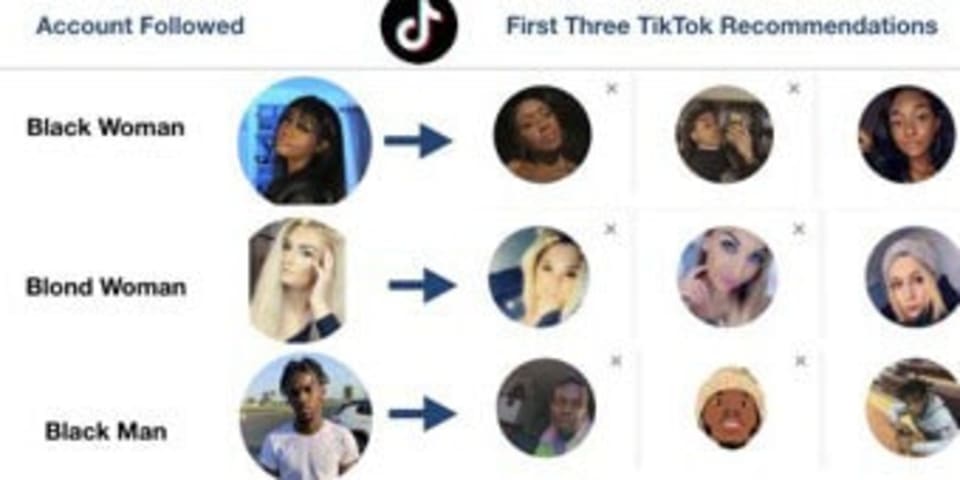

Según un experimento realizado por el investigador de inteligencia artificial Marc Faddoul, el algoritmo que utiliza TikTok para sugerir nuevos usuarios a seguir podría tener un sesgo racial.

Faddoul, un investigador de inteligencia artificial de la Universidad de California, Berkeley, que se especializa en equidad algorítmica, señaló por primera vez sus hallazgos en Twitter esta semana.

“Una novedad de TikTok: BURBUJAS FITLER BASADAS EN LA CARA”, escribió Faddoul. “El techlash del sesgo de la IA parece no haber tenido impacto en las plataformas más nuevas. Siga un perfil aleatorio y TikTok solo recomendará personas que se vean casi iguales”.

Faddoul explicó a BuzzFeed News que cuando un usuario en TikTok sigue una cuenta, se le sugiere una serie de otras cuentas que podría seguir. Faddoul dijo que notó similitudes en estas cuentas, ya que los usuarios eran de la misma raza, color de cabello y apariencias similares.

Faddoul dijo que repitió el experimento nuevamente con una nueva cuenta con resultados similares.

“Claramente, las recomendaciones son muy fisonómicas”, dijo Faddoul. “Pero no se trata solo de género y etnicidad, puedes obtener muchos más perfiles faciales de nicho. TikTok adapta la 'recomendabilidad' al estilo de cabello, perfil corporal, edad, qué tan (des) vestida está la persona e incluso si tiene discapacidades visibles”.

Un representante de TikTok le dijo a BuzzFeed que el algoritmo no se basa en la raza o la imagen de la cuenta, sino en el contenido de la cuenta. Según el representante, esto se llama filtrado colaborativo, un proceso similar que utilizan YouTube y Netflix.

“Nuestra recomendación de cuentas a seguir se basa en el comportamiento del usuario: los usuarios que siguen la cuenta A también siguen la cuenta B, por lo que si sigues a A es probable que también quieras seguir a B”, dijo un representante a BuzzFeed.

Pero según Faddoul, si este es el caso, aún podría generar un sesgo racial.

"Un riesgo es reforzar un 'sesgo de cobertura' con un circuito de retroalimentación", dijo Faddoul. “Si los influencers más populares son, digamos, rubios, será más fácil para un rubio conseguir seguidores que para un miembro de una minoría subrepresentada. Y el bucle continúa…”

Esta no es la primera vez que la compañía se encuentra en problemas, en diciembre, TikTok admitió que estaba enterrando contenido creado por usuarios queer, gordos y discapacitados.