Incidentes Asociados

Internet puede parecer un campo de juego nivelado, pero no lo es. Safiya Umoja Noble se encontró cara a cara con ese hecho un día cuando usó el motor de búsqueda de Google para buscar temas que sus sobrinas pudieran encontrar interesantes. Ingresó el término “chicas negras” y regresó con páginas dominadas por la pornografía.

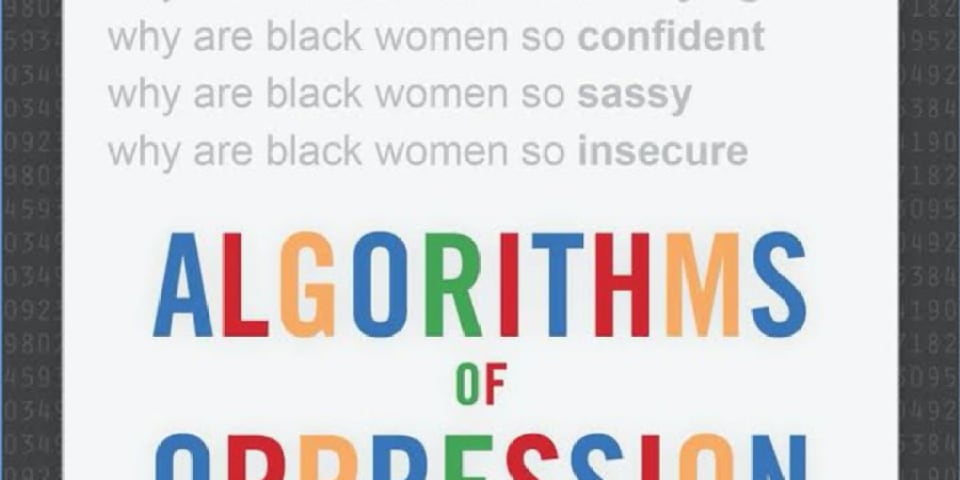

Noble, profesor de comunicaciones de USC Annenberg, estaba horrorizado pero no sorprendido. Durante años, ha argumentado que los valores de la web reflejan a sus constructores, en su mayoría hombres occidentales blancos, y no representan a las minorías y las mujeres. Su último libro, Algorithms of Oppression, detalla la investigación que inició después de esa fatídica búsqueda en Google, y explora las estructuras ocultas que dan forma a cómo obtenemos información a través de Internet.

El libro, publicado este mes, argumenta que los algoritmos de los motores de búsqueda no son tan neutrales como a Google le gustaría que pensaras. Los algoritmos promueven algunos resultados por encima de otros, e incluso un código aparentemente neutral puede reflejar los sesgos de la sociedad. Además, sin una idea de cómo funcionan los algoritmos o cuál es el contexto más amplio, las búsquedas pueden dar forma injusta a la discusión de un tema como las chicas negras.

Noble habló con MIT Technology Review sobre los problemas inherentes al sistema actual, cómo Google podría hacerlo mejor y cómo la inteligencia artificial podría empeorar las cosas.

Si estamos buscando el Starbucks más cercano, una cotización específica o algo muy limitado que se entienda fácilmente, funciona bien. Pero cuando empezamos a entrar en conceptos más complicados sobre la identidad, sobre el conocimiento, es ahí donde los motores de búsqueda empiezan a fallarnos. Esto no sería un gran problema, excepto que el público realmente confía en los motores de búsqueda para darles lo que creen que será la verdad, o algo investigado, o algo creíble. Aquí es donde, creo, tenemos el mayor malentendido en el público acerca de lo que son los motores de búsqueda.

Para abordar el sesgo, Google normalmente suprime ciertos resultados. ¿Hay un mejor enfoque?

Podríamos pensar en dar marcha atrás en un proyecto tan ambicioso de organizar todo el conocimiento del mundo, o podríamos replantearnos y decir: “Esta es una tecnología que es imperfecta. Es manipulable. Te mostraremos cómo se manipula. Vamos a hacer que ese tipo de dimensiones de nuestro producto sean más transparentes para que conozca la naturaleza profundamente subjetiva del resultado”. En cambio, la posición de muchas empresas, no solo de Google, es que [están] brindando algo en lo que puede confiar y con lo que puede contar, y aquí es donde se vuelve bastante difícil.

¿Cómo podría el aprendizaje automático perpetuar parte del racismo y el sexismo sobre los que escribes?

He estado argumentando que la inteligencia artificial, o los sistemas automatizados de toma de decisiones, se convertirán en un problema de derechos humanos en este siglo. Creo firmemente en eso, porque los algoritmos y proyectos de aprendizaje automático utilizan datos que ya están sesgados, incompletos, defectuosos y [estamos] enseñando a las máquinas cómo tomar decisiones basadas en esa información. Sabemos que [eso] conducirá a una variedad de resultados dispares. Permítanme agregar que la IA será cada vez más difícil de intervenir porque será menos claro qué datos se han utilizado para informar la creación de esa IA o la creación de esos sistemas. Hay muchos tipos diferentes de conjuntos de datos, por ejemplo, que no están estandarizados, que se unen para tomar decisiones.

Desde que buscó por primera vez "chicas negras" en 2010, ¿ha visto que las cosas mejoran o empeoran?

Desde que comencé a escribir y hablar públicamente sobre las niñas negras en particular asociadas con la pornografía, las cosas han cambiado. Ahora, la pornografía y el contenido hipersexualizado no están en la primera página, así que creo que fue una mejora discreta que no se produjo con mucha fanfarria. Pero otras comunidades, como las chicas latinas y asiáticas, todavía están muy sexualizadas en los resultados de búsqueda.