Incidentes Asociados

Lo que aprendí de la competencia de pesca de Kaggle

Gidi Shperber Bloqueado Desbloquear Seguir Siguiendo 1 de mayo de 2017

TLDR:

Mi socio de Kaggle y yo participamos recientemente en la competencia de Kaggle "The Nature Conservancy Fisheries Monitoring" (en adelante: "fisheries"). Esta competencia tuvo algunos resultados muy interesantes, en particular, el resultado de referencia superó a la mayoría de los competidores. Creo que hay algunas lecciones muy importantes que podemos aprender como científicos de datos. A continuación puede leer sobre la competencia y algunas de las cosas que hemos aprendido de ella.

La competencia

Recientemente, es posible que haya escuchado algunos rumores sobre la competencia de pesca de Kaggle, y es posible que se haya estado preguntando a qué se debe todo este alboroto.

En esta competencia, su objetivo (como en muchas competencias de Kaggle) era clasificar un objeto, en este caso, determinar la especie de un pez.

¿Por qué te gustaría hacer esto? Bueno, para acortar la historia, los barcos actualmente están equipados con cámaras automáticas, para asegurarse de que solo capturan peces legítimos como el atún, y no animales protegidos como los tiburones. La imagen se descifra manualmente más tarde.

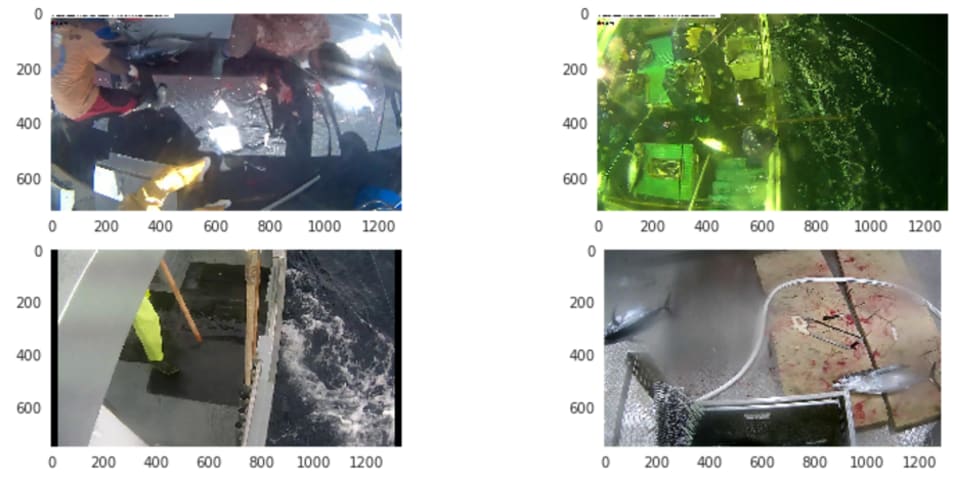

Sin embargo, los peces no se presentan en una foto de perfil clara, sino que se arrojan al azar alrededor de un bote. Aquí hay algunas imágenes de ejemplo:

también hay imágenes con más de un pez, o imágenes sin ningún pez.

Así que esta no es la competencia estándar de "reconocer la flor/la hoja/la cara", sino una más desafiante.

Y es por eso que me encanta Kaggle: a diferencia de muchos artículos de aprendizaje automático, que usan el conjunto de datos más fácil disponible (mnist, cifar-10, imagenet, por nombrar algunos), Kaggle te presenta problemas de la vida real, que siempre están sucios, mal etiquetados, borroso etc

Como en otras competencias, esta fue una competencia de dos etapas, en la que una pequeña parte de los datos de prueba (imágenes de 1K) está disponible, mientras que la mayoría del conjunto de prueba (otras imágenes de 12K) se publica 1 semana antes de la fecha límite de la competencia. Este método puede evitar algunas trampas, pero tiene muchos problemas y puede desalentar a muchos competidores: solo alrededor de 300 competidores del total de 2300 participantes se presentaron en la segunda etapa.

Nuestro camino a través de la competencia

De un vistazo rápido, es fácil ver que el enfoque requerido aquí es hacer dos pasos: primero detectar el pez y luego clasificarlo.

Sin embargo, durante la competencia, surgió algo extraño en los foros de la competencia: si ejecuta una red VGG previamente entrenada en el conjunto de entrenamiento (como se describe muy claramente aquí y se analiza más a fondo en este gran curso), puede alcanzar una precisión de alrededor 99%. Esto es extraño, porque el VGG fue entrenado en datos de red de imágenes, que no son muy similares a las imágenes de arriba. Enviar estos resultados a Kaggle mostró resultados que no estaban nada mal, pero estaban muy por debajo del 99 %.